Einfacher Video-Upscaler für Aufnahmen#

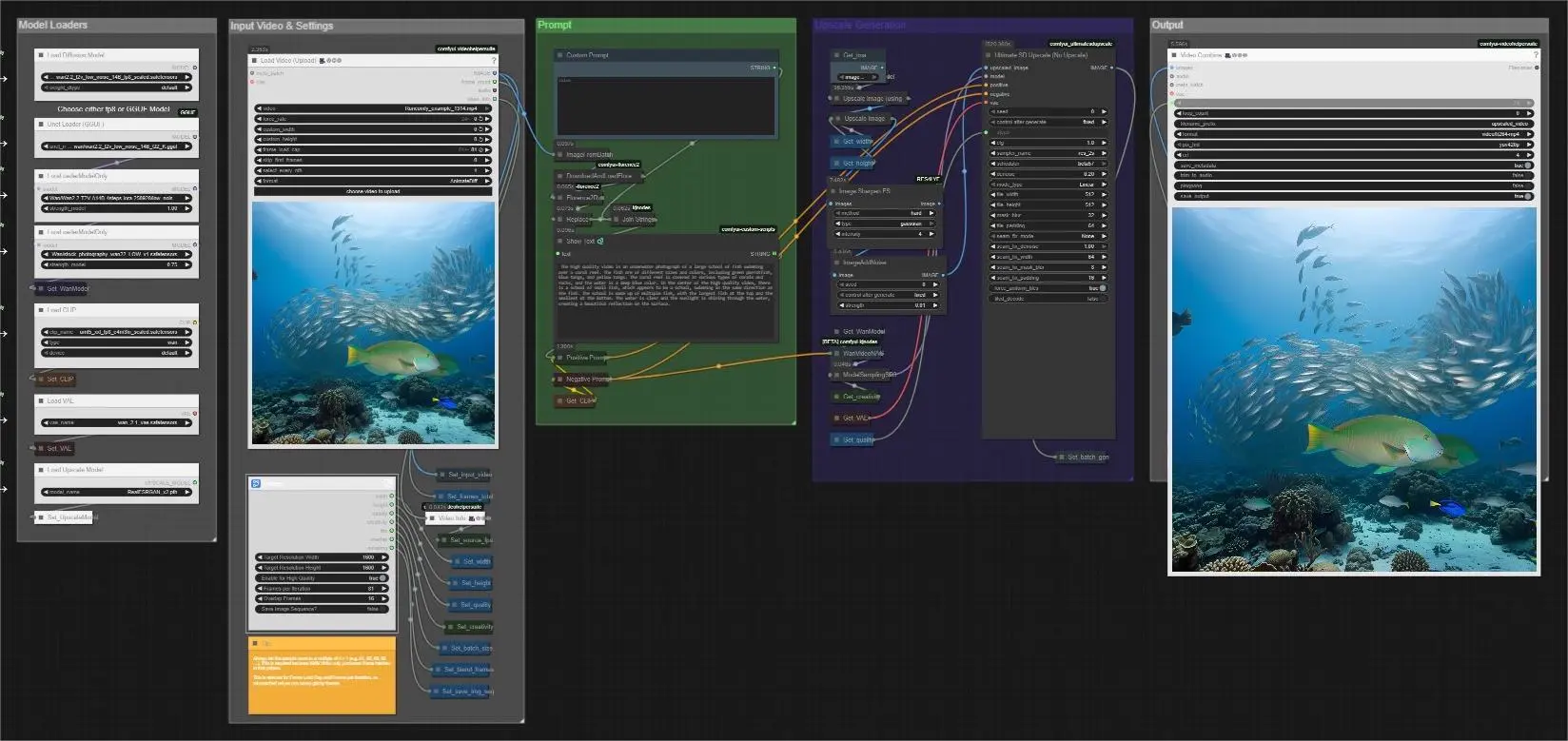

Der einfache Video-Upscaler für Aufnahmen ist ein optimierter ComfyUI-Pipeline von Mickmumpitz, die die Klarheit, Textur und wahrgenommene Auflösung bestehender Videos mit minimalem Setup verbessert. Er kombiniert schnelle Superauflösung, detailfreundliches Schärfen und Wan 2.x-Diffusionsverfeinerung, um feine Strukturen wiederherzustellen und gleichzeitig die Bewegung natürlich zu halten. Ob Sie Archivaufnahmen modernisieren, AI-generierte Clips verbessern oder Master zur Lieferung vorbereiten, der Easy Video Upscaler for Footage-Workflow betont Konsistenz über die Frames hinweg, sanfte Übergänge zwischen Chargen und zuverlässige Ausgaben.

Der Workflow akzeptiert ein einzelnes Eingabevideo, liest automatisch seine Bildrate, generiert oder akzeptiert ein Leitprompt und verarbeitet Frames in mischbaren Chargen, sodass lange Sequenzen nahtlos bleiben. Sie können ein leichtes GGUF-Modell für Systeme mit geringem VRAM oder ein FP8 UNet für maximale Treue wählen und dann die Verfeinerung mit einer einfachen Kreativitätskontrolle steuern. Die endgültigen Ergebnisse werden als hochskaliertes Video gespeichert, mit einem optionalen Bildsequenzpfad für große Projekte.

Wichtige Modelle im ComfyUI Easy Video Upscaler for Footage-Workflow#

- Wan 2.2 T2V Low Noise 14B UNet (FP8 oder GGUF). Kern-Generationsrückgrat, das für diffusionsbasierte Verfeinerung verwendet wird, die Details verbessert und gleichzeitig die Quell-Frames respektiert. Hugging Face: Comfy-Org/Wan_2.2_ComfyUI_Repackaged und Hugging Face: bullerwins/Wan2.2-T2V-A14B-GGUF

- Wan 2.1 VAE. Decoder, der Textur und Ton bewahrt, wenn zwischen latenten und Pixelraum während der Verfeinerung gewechselt wird. Hugging Face: Comfy-Org/Wan_2.1_ComfyUI_repackaged

- UMT5-XXL Text-Encoder (FP8). Text-Rückgrat, das für die Prompt-Konditionierung verwendet wird, um Anweisungen mit dem WAN-Modell auszurichten. In den Wan 2.1 neu verpackten Assets enthalten. Hugging Face: Comfy-Org/Wan_2.1_ComfyUI_repackaged

- RealESRGAN x2. Klassisches Superauflösungsmodell, das die Bildgröße sauber erhöht, bevor die diffusionsbasierte Detailwiederherstellung erfolgt. GitHub: xinntao/Real-ESRGAN

- Microsoft Florence-2 Large. Vision-Sprachmodell, das hier verwendet wird, um ein repräsentatives Frame automatisch zu beschriften und ein hochwertiges Prompt bereitzustellen, wenn Sie keines schreiben möchten. Hugging Face: microsoft/Florence-2-large

- Optionale LoRA-Add-Ons für WAN 2.2. Leichte Adapter, die die Verfeinerung in Richtung spezifischer Looks lenken können, ohne das Filmmaterial zu überlagern. Zum Beispiel die "Lightning" Low-Noise 4-Step LoRA. Hugging Face: lightx2v/Wan2.2-Lightning

Verwendung des ComfyUI Easy Video Upscaler for Footage-Workflows#

Die Pipeline folgt einem klaren Pfad von Eingabe zu Ausgabe und organisiert Steuerungen in Gruppen, sodass Sie immer wissen, wo Sie Qualität, Geschwindigkeit und Speicherverhalten anpassen können.

Modell-Loader#

Diese Gruppe initialisiert den Kernmodell-Stack und lässt Sie entweder den FP8 Safetensors UNet oder einen GGUF-quantisierten UNet für Wan 2.2 auswählen. Verwenden Sie den GGUF-Pfad, wenn VRAM knapp ist, oder den FP8 UNet, wenn Sie die höchste Treue wünschen. Der Wan 2.1 VAE und der UMT5-XXL Text-Encoder werden hier geladen, damit Prompts den späteren Diffusionsschritt leiten können. Wenn Sie vorhaben, eine LoRA zu verwenden, laden Sie sie in dieser Gruppe, bevor Sie starten.

Eingabevideo & Einstellungen#

Legen Sie Ihren Quellclip mit VHS_LoadVideo (#130) ab. Der Workflow liest die Quellbildrate über VHS_VideoInfo (#298), sodass das endgültige Rendering dem Bewegungsrhythmus entspricht. Legen Sie Ihre Zielbreite und -höhe fest, wählen Sie, ob der Hochqualitätsmodus aktiviert werden soll, und passen Sie die Kreativitätskontrolle an, um zu entscheiden, wie strikt die Verfeinerung Ihrer Eingabe folgen soll. Für lange Clips legen Sie die Frames pro Iteration und einen Überlappungswert fest, um Chargen sauber zu mischen, und aktivieren Sie die Bildsequenz-Speicheroption, wenn Sie maximale Stabilität wünschen oder in sehr hoher Auflösung arbeiten.

Prompt#

Sie können einen benutzerdefinierten Prompt eingeben oder den Workflow einen für Sie erstellen lassen. Ein einzelnes Frame wird von Florence2Run (#147) gesampelt und beschriftet, dann leicht von StringReplace (#408) umgeschrieben und mit einem benutzerdefinierten Text über JoinStrings (#339) kombiniert. Der kombinierte Prompt wird von ShowText|pysssss (#135) angezeigt und an Positive Prompt (#3) weitergeleitet, während Negative Prompt (#4) Artefakt-Reduktionsterms enthält. Dies hält Prompts konsistent und schnell zu verwalten, insbesondere für Batch-Jobs.

Hochskalierungsgenerierung#

Frames werden mit ImageUpscaleWithModel (#303) unter Verwendung von RealESRGAN vorab hochskaliert und dann mit ImageScale (#454) präzise auf Ihre Zielauflösung skaliert. Image Sharpen FS (#452) stellt bei Bedarf die Kantenschärfe wieder her und ImageAddNoise (#421) fügt ein kleines kontrolliertes Rauschen hinzu, das dem Diffusionsdurchgang hilft, realistische Mikrostrukturen wieder aufzubauen. Das WAN-Modell wird mit WanVideoNAG (#115) und ModelSamplingSD3 (#419) vorbereitet, dann führt UltimateSDUpscaleNoUpscale (#126) eine gekachelte, promptgesteuerte Verfeinerung durch, die die globale Struktur und Bewegungskontinuität respektiert.

Batch-Ersteller + Generierte Chargen mischen#

Lange Videos werden automatisch in mischbare Chargen aufgeteilt. Dieser Subgraph berechnet die Anzahl der Iterationen, zeigt sie in "Number of Iterations" an und stellt jede Bildcharge unter Berücksichtigung Ihrer Überlappungseinstellung zusammen. An den Grenzen zwischen Chargen mischt ImageBatchJoinWithTransition (#244) Frames, sodass die Naht unauffällig ist. Verwenden Sie mehr Überlappung, wenn Schnitte offensichtlich sind, und reduzieren Sie sie, um die Geschwindigkeit zu erhöhen, wenn Szenen stabil sind.

Ausgabe Gemischte gespeicherte Bildsequenz#

Wenn "Save Image Sequence" aktiviert ist, schreibt jede Iteration ihre Frames auf die Festplatte, was bei sehr hoher Auflösung oder begrenztem Speicher hilfreich ist. Der Workflow lädt diese Frames später mit VHS_LoadImagesPath (#396) erneut, mischt optional die Chargenenden erneut und fügt sie zu einer kontinuierlichen Sequenz zusammen. Dieser Pfad bietet eine robuste Wiederherstellungsroute, wenn Sie die Verarbeitung unterbrechen und fortsetzen.

Ausgabe#

Die endgültigen Frames werden von VHS_VideoCombine (#128) zu einem Video kompiliert, das die zuvor erfasste Quellbildrate verwendet, sodass die Bewegung glatt und dem Original treu bleibt. Sie können auch eine Zwischenvorschau ausgeben oder ein zweites Finale aus dem gespeicherten Sequenzpfad mit VHS_VideoCombine (#393) schreiben. Dateinamen und Unterordner werden automatisch inkrementiert, um jede Ausführung ordentlich zu halten.

Wichtige Knoten im ComfyUI Easy Video Upscaler for Footage-Workflow#

VHS_LoadVideo (#130)#

Lädt den Eingangsclip und zeigt Bilder, die Anzahl der Bilder und ein video_info-Blob an. Wenn Sie nur einen Teil verarbeiten möchten, beschränken Sie das Bilderladen im Knoten und richten Sie "Frames per Iteration" entsprechend aus. Das Synchronisieren der Loader- und Batch-Einstellungen verhindert Ruckeln oder Lücken, wenn Chargen zusammengenäht werden.

ImageUpscaleWithModel (#303)#

Wendet RealESRGAN für einen schnellen, artefaktresistenten Größenboost vor der Diffusion an. Nutzen Sie es, um Ihre Zielauflösung zu erreichen oder zu nähern, bevor die WAN-Passage sich auf Textur und feine Details anstatt auf großflächige Größenänderungen konzentrieren kann. Wenn Ihre Quelle bereits der Zielgröße entspricht, können Sie diese Stufe dennoch beibehalten, um Rauschen zu reduzieren und die Struktur zu verstärken.

UltimateSDUpscaleNoUpscale (#126)#

Führt die WAN-Diffusionsverfeinerung in Kacheln mit Nahtkorrektur und optionalem gekacheltem Dekodieren durch, um die globale Struktur zu bewahren. Die wenigen hier wichtigen Kontrollen sind die Abtastschritte, die Rauschstärke und nahtbezogene Optionen; höhere Schritte und Rauschen erzeugen einen durchsetzungsfähigeren Look, während niedrigere Einstellungen näher an Ihren Originalframes bleiben. Wenn Sie in der Gruppe Einstellungen hohe Qualität aktivieren, passt dieser Knoten automatisch die Schritttiefe an.

WanVideoNAG (#115) und ModelSamplingSD3 (#419)#

Dieses Paar verbindet das WAN-Modell mit dem Sampler und bietet eine Kreativitätsverschiebung. Niedrigere Kreativität hält die Ausgabe nahe an der Eingabe mit sanfter Verbesserung, während höhere Werte mehr generative Textur hinzufügen und Details erfinden können. Für Dokumentarfilme, Interviews oder Archivarbeiten bevorzugen Sie konservative Werte; für synthetische oder AI-ursprüngliche Clips können Sie weiter gehen.

ImageBatchJoinWithTransition (#244)#

Mischt das Ende einer Charge mit dem Anfang der nächsten, um Stichspuren zu verbergen. Erhöhen Sie die Anzahl der Übergangsframes, wenn Sie Helligkeits- oder Textursprünge bemerken, und reduzieren Sie sie für schnellere Läufe, wenn Szenen einheitlich sind. Dies ist der Haupthebel, der die Easy Video Upscaler for Footage-Pipeline nahtlos auf langen Zeitlinien hält.

VHS_VideoCombine (#128)#

Setzt das endgültige Video bei der stromaufwärts erfassten Quell-FPS zusammen. Wenn Sie Bildsequenzen gespeichert haben, können Sie zum alternativen Kombinationsknoten wechseln, um von der Festplatte aus zu rendern, ohne neu zu verarbeiten. In diesem Knoten legen Sie auch Container- und Pixelformat fest, wenn nötig.

Optionale Extras#

- Wählen Sie einen WAN-Pfad. Verwenden Sie FP8 UNet für beste Qualität auf starken GPUs oder den GGUF UNet für Systeme mit geringem VRAM auf Workstations und Laptops.

- Halten Sie die Bewegung natürlich. Beginnen Sie mit niedriger Kreativität für Live-Action- oder Dokumentarfilmmaterial und erhöhen Sie sie schrittweise, wenn Sie mehr Texturwiederherstellung benötigen.

- Planen Sie Chargen im Voraus. Bei langen Clips aktivieren Sie "Save Image Sequence", damit Sie die endgültige Ausgabe ohne erneute Berechnung der Diffusion fortsetzen oder neu rendern können.

- Stimmen Sie die Frame-Mathematik ab. Stellen Sie die Frames pro Iteration so ein, dass sie mit der Begrenzung Ihres Loaders und der Überlappung übereinstimmen; die Easy Video Upscaler for Footage-Chargenwerkzeuge berechnen Iterationen und mischen Kanten für Sie.

- Verwenden Sie LoRA sparsam. Fügen Sie eine WAN 2.2 LoRA hinzu, wenn Sie einen bestimmten Look benötigen, und senken Sie ihr Gewicht, wenn sie den ursprünglichen Charakter der Szene zu überlagern beginnt.

Danksagungen#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken Mickmumpitz für den Easy Video Upscaler for Footage-Workflow für ihre Beiträge und Wartung. Für autoritative Details konsultieren Sie bitte die Originaldokumentation und die unten verlinkten Repositories.

Ressourcen#

- YouTube/Easy Video Upscaler for Footage

- Docs / Release Notes: YouTube @ Mickmumpitz

Hinweis: Die Nutzung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen ihrer Autoren und Betreiber.