FLUX Kontext Face Swap 工作流程,用於乾淨、逼真的面部替換#

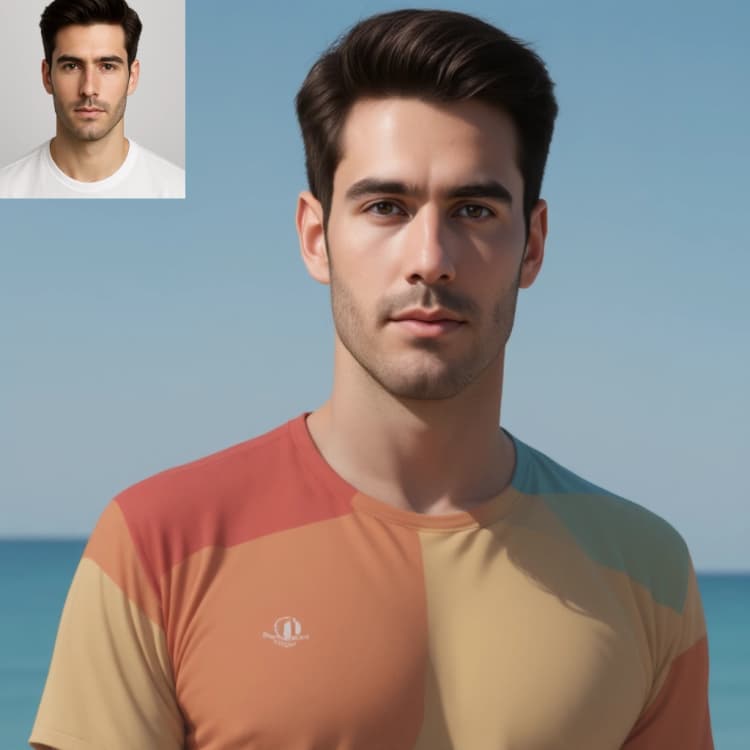

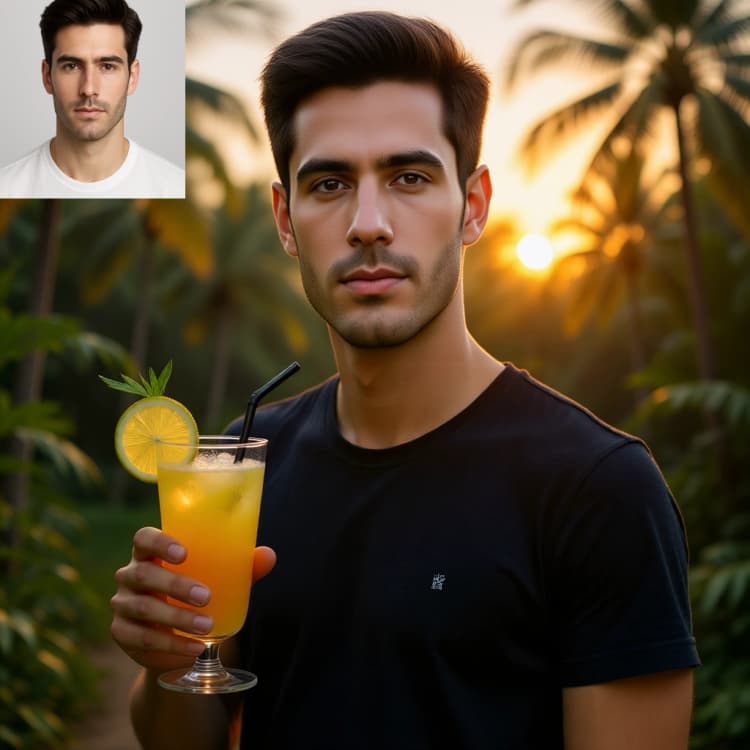

這個 ComfyUI 工作流程通過結合基於 InsightFace 的對齊和粘貼階段與 FLUX.1 的圖像到圖像生成,實現高質量的面部替換,並由 Kontext 引導。它專為希望快速、可靠地進行替換的創作者而設計,並且只需最少的遮罩,自然融合皮膚和頭髮。該管道加載一個準備好的 Kontext UNet,應用 Put it here LoRA,並重新生成局部區域以獲得無縫的結果。

FLUX Kontext Face Swap 工作流程採用基礎圖像和面部圖像,自動檢測和對齊面部,將其粘貼到基礎中,為 FLUX 調整合成比例,然後通過提示引導的採樣進行細化。結果預覽並保存,並有可選的旋鈕來緊縮裁剪或使替換更微妙或更強烈。

Comfyui FLUX Kontext Face Swap 工作流程中的關鍵模型#

- FLUX.1-dev: 使用 Kontext 上下文條件執行圖像到圖像精煉的擴散骨幹。請參見官方模型卡以了解架構和行為的詳細信息。 FLUX.1-dev

- FLUX autoencoder (AE): 用於將合成圖像編碼為潛在變量並將採樣器輸出解碼回像素的 VAE。包含在 FLUX 發行版中。 FLUX.1-dev

- Text encoders CLIP-L and T5-XXL: 提供豐富的文本條件以聚焦交換區域和期望的表情。論文: CLIP, T5

- InsightFace: 用於對齊和裁剪生成的面部檢測和地標分析。 InsightFace

- Put it here LoRA: 一個 Kontext 特定的 LoRA,強烈定位 FLUX 應重建的位置,幫助新面孔準確地"坐"在預定區域。

如何使用 Comfyui FLUX Kontext Face Swap 工作流程#

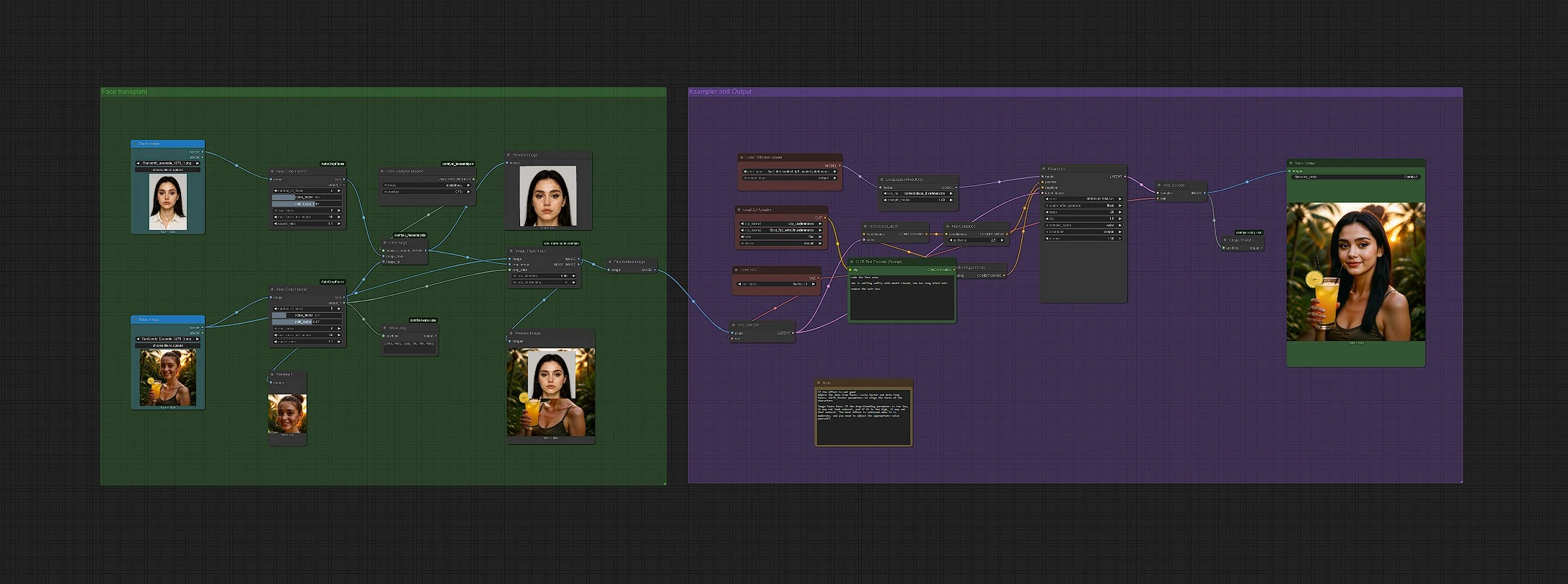

此圖有兩個主要組按順序運行:Face transplant 準備一個乾淨的合成補丁;Ksampler and Output 使用 FLUX 重新生成並拋光它。

Face transplant#

此組加載您的 Base Image (LoadImage (#108)) 和 Face Image (LoadImage (#110)),然後使用 AutoCropFaces (#119, #122) 找到面部區域。裁剪和地標提供給 FaceAlign (#121),它扭曲源面以匹配基礎姿勢和比例。Image Paste Face (#125) 使用裁剪元數據將對齊的面部合併到基礎中,實現緊密、逼真的疊加。FluxKontextImageScale (#134) 然後將合成重新調整為 Kontext 預期的精確尺寸,以便下游 VAE 編碼無損且穩定。

需要提供的內容:

- 一張高質量的基礎照片,目標面部清晰可見。

- 盡可能與基礎光照相似的面部圖像。

- 如果初始裁剪不準,調整自動裁剪靈敏度和框大小。畫布中的註釋提醒,通常通過放鬆或緊縮自動裁剪值可以改善不良結果。

Ksampler and Output#

DualCLIPLoader (#8) 加載 CLIP-L 和 T5-XXL 編碼器,CLIPTextEncode (#6) 將您的提示轉換為條件。提示旨在聚焦於恢復面部區域和控制表情;您可以編輯它以微調細節,如笑容、頭髮或化妝。ConditioningZeroOut (#4) 閉合文本影響,以便 Kontext 在交換區域外保留上下文,ReferenceLatent (#3) 錨定生成到編碼的合成。FluxGuidance (#5) 平衡採樣器應遵循參考的程度與您的提示。模型路徑運行 UNETLoader (#140) 與 Kontext,然後由 LoraLoaderModelOnly (#141) 應用 Put it here LoRA。合成由 VAEEncode (#10) 編碼,KSampler (#9) 採樣,VAEDecode (#7) 解碼,預覽,並由 SaveImage (#19) 保存。

需要更改的內容:

- 編輯

CLIPTextEncode中的提示以引導表情和局部細節。 - 如果替換過強或過弱,調整指導強度和採樣器步驟。

- 保持應用 LoRA;它在 FLUX Kontext Face Swap 中對於精確定位至關重要。

Comfyui FLUX Kontext Face Swap 工作流程中的關鍵節點#

AutoCropFaces (#119 and #122)#

檢測面部並生成裁剪元數據以進行對齊和粘貼。如果面部部分丟失或包括不想要的頭髮,稍微增加裁剪尺寸或降低檢測信心以獲取更多上下文。

FaceAlign (#121)#

使用 InsightFace 地標將源面部扭曲到基礎面部幾何結構上,然後合併。在 FaceAnalysisModels (#120) 中將分析設備切換為 GPU,如果可用,以加快對齊速度。

Image Paste Face (#125)#

使用裁剪數據將對齊的面部融合到基礎圖像中。如果邊緣看起來鋒利或顏色不對,嘗試稍微大一點的裁剪框或減少任何後提示的侵略性,以便 FLUX 在邊界周圍的過度繪製減少。

FluxKontextImageScale (#134)#

將合成重新調整為 Kontext 預期的本地形狀,以便 VAE 能夠無失真地編碼。保持這一點,以防止精細輸出中的拉伸或漂移。

UNETLoader (#140)#

加載 Kontext 調整的 FLUX UNet。與 LoRA 一起使用以實現 FLUX Kontext Face Swap 的預期行為。更改檢查點將明顯改變皮膚紋理和整體保真度。

LoraLoaderModelOnly (#141)#

應用 Put it here LoRA 以本地化重建。如果替換漂移或編輯溢出面部區域,稍微增加 LoRA 影響。如果外觀感覺被鎖定,減少它以獲得更多創作自由。

DualCLIPLoader (#8) 和 CLIPTextEncode (#6)#

提供文本條件。保持提示簡短,聚焦於面部區域和表情。如果想保留基礎圖像背景和服裝,避免全局風格提示。

FluxGuidance (#5)#

平衡採樣器信任參考合成的程度。提高它以更緊密地保留基礎構圖,降低它以在面部區域內進行更強的提示驅動編輯。

可選擴展#

- 對於頑固的髮際線或遮擋,明確提示瀏海、鬢角或“去除髮髻”以讓 Kontext 重建乾淨的邊緣。

- 盡量匹配面部和基礎之間的光照。如有需要,添加簡短的提示暗示暖色或冷色調。

- 如果裁剪錯過小或旋轉的面部,從更大、更高分辨率的基礎圖像開始,以便檢測有更多像素可用。

- 在迭代時保持預覽啟用。一旦滿意,略微提高分辨率或步驟以進行最終渲染。

致謝#

- 感謝 FLUX 團隊發布 FLUX.1 模型和文檔。 FLUX.1-dev

- 感謝 InsightFace 貢獻者提供穩健的面部檢測和對齊。 InsightFace

- 感謝 Put it here LoRA 的創作者,提供精確的本地指導,使得 FLUX Kontext Face Swap 管道中的準確定位成為可能。