⚠️ 重要提示:此 ComfyUI MultiTalk 实现目前仅支持单人生成。多人对话功能即将推出。

1. 什么是 MultiTalk?#

MultiTalk 是由 MeiGen-AI 开发的革命性音频驱动多人对话视频生成框架。与仅对面部动作进行动画处理的传统说话头像生成方法不同,MultiTalk 技术可以生成人们说话、唱歌和互动的逼真视频,同时与音频输入保持完美的唇形同步。MultiTalk 将静态照片转换为动态说话视频,让人物按照您的要求说话或唱歌。

2. MultiTalk 工作原理#

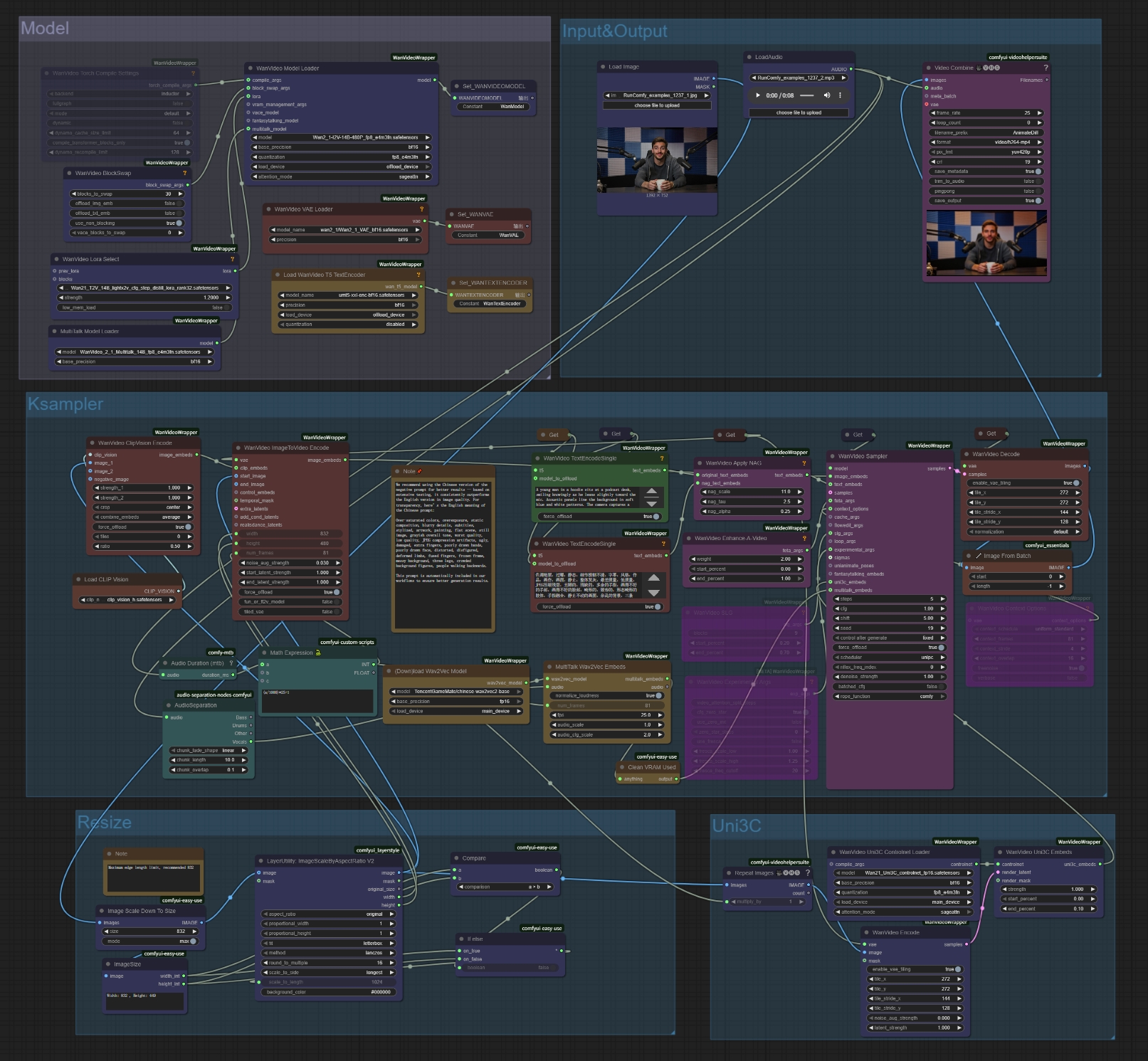

MultiTalk 利用先进的 AI 技术来理解音频信号和视觉信息。ComfyUI MultiTalk 实现结合了 MultiTalk + Wan2.1 + Uni3C 以获得最佳效果:

音频分析: MultiTalk 使用强大的音频编码器(Wav2Vec)来理解语音的细微差别,包括节奏、音调和发音模式。

视觉理解: MultiTalk 建立在强大的 Wan2.1 视频扩散模型之上,能够理解人体解剖学、面部表情和身体动作(您可以访问我们的 Wan2.1 工作流程 进行 t2v/i2v 生成)。

摄像头控制: 搭配 Uni3C controlnet 的 MultiTalk 可实现微妙的摄像头移动和场景控制,使视频更加动态和专业。查看我们的 Uni3C 工作流程 来创建精美的摄像头运动转移。

完美同步: 通过精密的注意力机制,MultiTalk 学会在保持自然面部表情和肢体语言的同时,将唇部动作与音频完美对齐。

指令跟随: 与更简单的方法不同,MultiTalk 可以在保持音频同步的同时,通过文本提示来控制场景、姿势和整体行为。

3. ComfyUI MultiTalk 的优势#

- 高质量唇形同步: MultiTalk 实现毫秒级唇形同步精度,在唱歌场景中尤为出色

- 多样化内容创作: MultiTalk 支持各种角色类型(包括卡通角色)的说话和唱歌生成

- 灵活分辨率: MultiTalk 以任意宽高比生成 480P 或 720P 视频

- 长视频支持: MultiTalk 可创建长达 15 秒的视频

- 指令跟随: MultiTalk 通过文本提示控制角色动作和场景设置

4. 如何使用 ComfyUI MultiTalk 工作流程#

MultiTalk 分步使用指南#

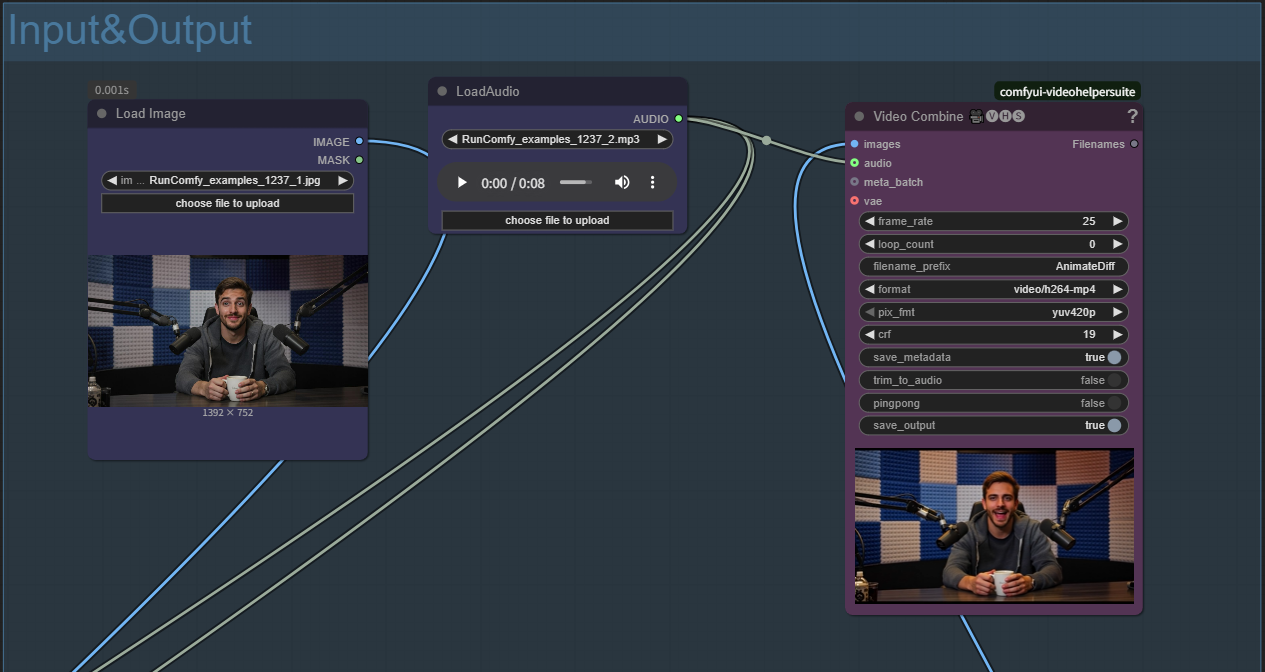

步骤 1:准备 MultiTalk 输入

- 上传参考图像: 在 Load Image 节点中点击 "choose file to upload"

- 使用清晰的正面照片以获得最佳 MultiTalk 效果

- 图像将自动调整为最佳尺寸(推荐 832px)

- 上传音频文件: 在 LoadAudio 节点中点击 "choose file to upload"

- MultiTalk 支持多种音频格式(WAV、MP3 等)

- 清晰的语音/歌声在 MultiTalk 中效果最佳

- 对于自定义歌曲制作,可以考虑使用我们的 Ace-Step 音乐生成工作流程,它可以生成带有同步歌词的高质量音乐。

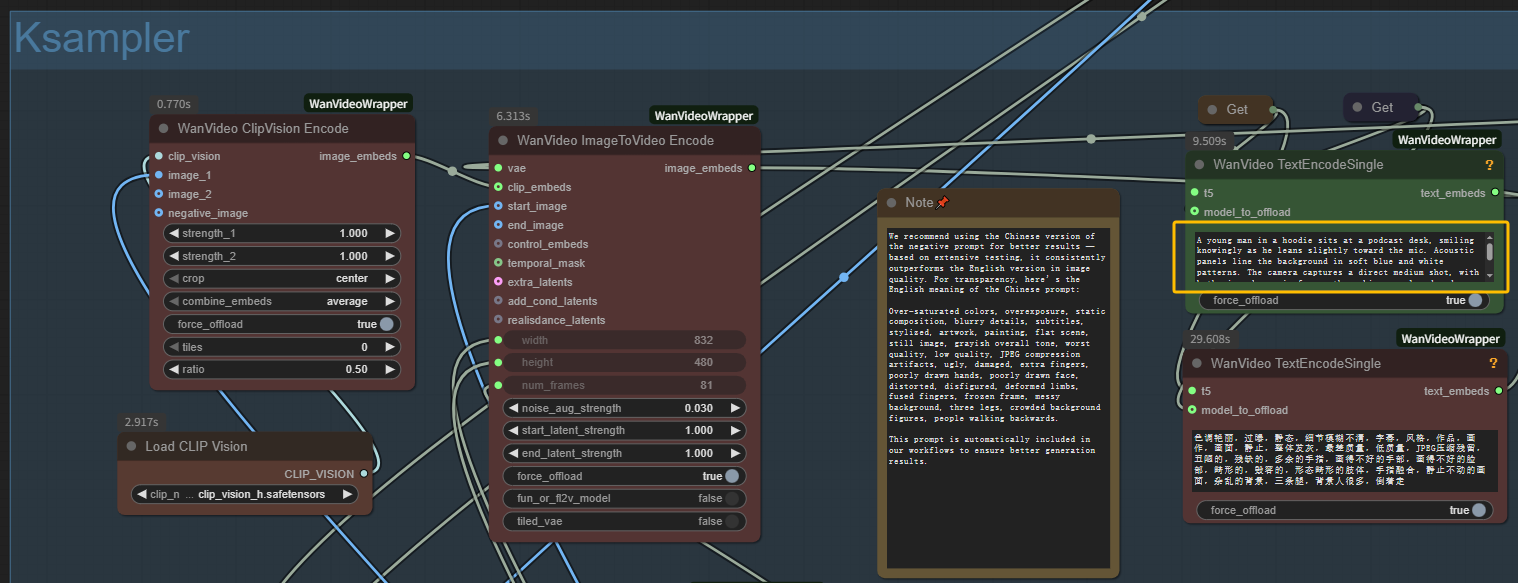

- 编写文本提示: 在文本编码节点中描述您想要的 MultiTalk 生成场景

步骤 2:配置 MultiTalk 生成设置

- 采样步数: 20-40 步(越高 = MultiTalk 质量越好,生成越慢)

- 音频缩放: 保持 1.0 以获得最佳 MultiTalk 唇形同步

- Embed Cond Scale: 2.0 用于平衡的 MultiTalk 音频调节

- 摄像头控制: 启用 Uni3C 以实现微妙的运动,或禁用以获得静态 MultiTalk 镜头

步骤 3:可选 MultiTalk 增强

- LoRA 加速: 启用以在最小质量损失下加快 MultiTalk 生成速度

- 视频增强: 使用增强节点进行 MultiTalk 后处理改进

- 负面提示: 添加 MultiTalk 输出中要避免的元素(模糊、扭曲等)

步骤 4:使用 MultiTalk 生成

- 将提示加入队列并等待 MultiTalk 生成

- 监控 VRAM 使用量(MultiTalk 推荐 48GB)

- MultiTalk 生成时间:根据设置和硬件,7-15 分钟

5. 致谢#

原始研究: MultiTalk 由 MeiGen-AI 与该领域领先研究者合作开发。原始论文 "Let Them Talk: Audio-Driven Multi-Person Conversational Video Generation" 展示了这项突破性技术背后的研究。

ComfyUI 集成: ComfyUI 实现由 Kijai 通过 ComfyUI-WanVideoWrapper 仓库提供,使这项先进技术对更广泛的创意社区可用。

基础技术: 建立在 Wan2.1 视频扩散模型之上,并融合了 Wav2Vec 的音频处理技术,代表了前沿 AI 研究的综合成果。

6. 链接和资源#

- 原始研究: MeiGen-AI MultiTalk Repository

- 项目页面: https://meigen-ai.github.io/multi-talk/

- ComfyUI 集成: ComfyUI-WanVideoWrapper