UNO ByteDance | 一貫した主題とオブジェクト生成

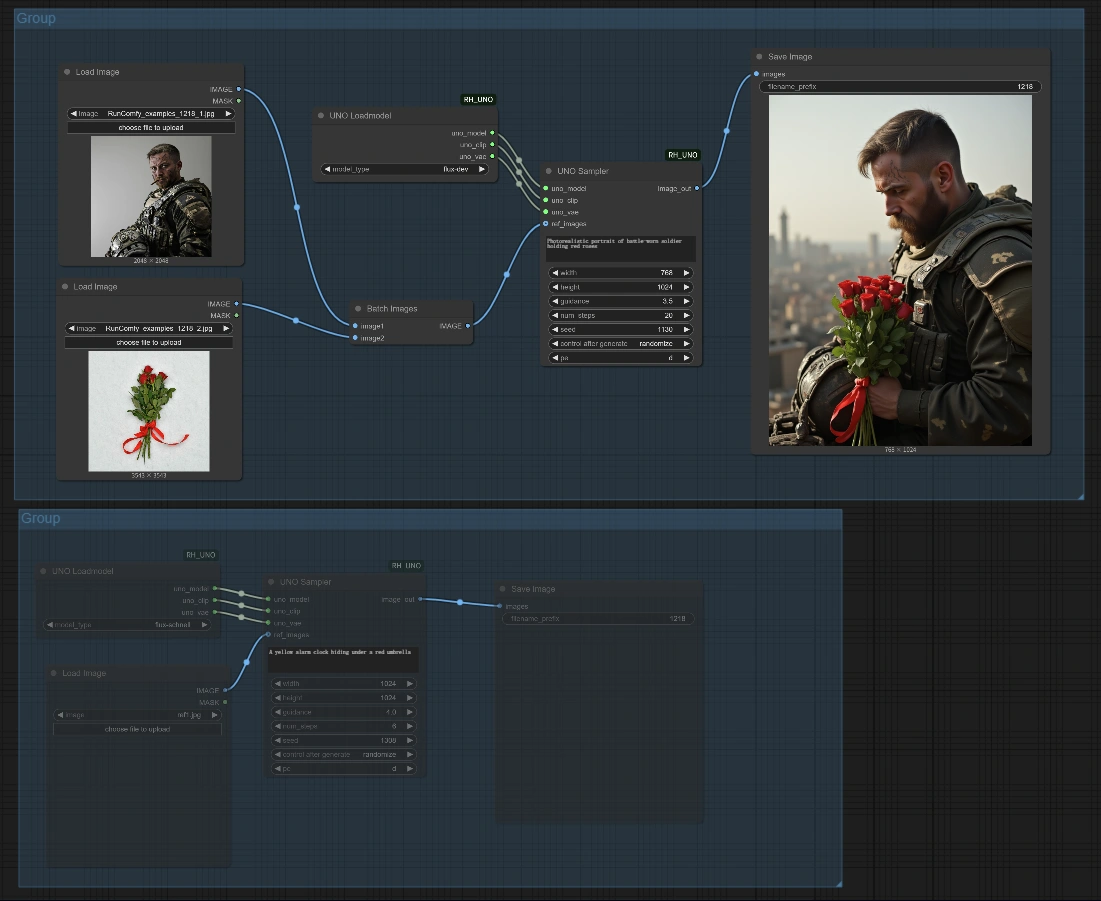

ComfyUI の UNO ワークフローは、ByteDance の高度な画像生成技術を RunComfy にもたらします。この強力なモデルは、参照主題が提供されるときに非常に一貫した画像を作成することに優れています。単一の主題生成(異なるシーン内のキャラクター)または主題-オブジェクト構成(1 つの画像内で特定のオブジェクトと主題を組み合わせる)のいずれが必要であっても、UNO ByteDance は卓越した忠実度と品質を提供します。このモデルは、小規模なクラウドマシンでも効果的に動作し、ByteDance の UNO 画像カスタマイズを誰でも利用できるようにします。製品ビジュアライゼーション、キャラクターイラスト、クリエイティブな構成などに最適です。ComfyUI UNO ByteDance Subject-Object Generation ワークフロー

ComfyUI UNO ByteDance Subject-Object Generation 例

ComfyUI UNO ByteDance Subject-Object Generation 説明

ComfyUI UNO 説明

1. ByteDance の ComfyUI UNO とは?

ComfyUI UNO ワークフローは、ByteDance の Universal aNd cOntrollable (UNO) モデルを ComfyUI 環境に統合します。ByteDance のインテリジェントクリエーションチームによって開発された UNO は、「Less-to-More」一般化パラダイムに基づく主題駆動型画像生成技術における重要な進歩を表しています。UNO は、さまざまなコンテキストとシナリオにわたって参照主題のアイデンティティ機能を維持しながら、柔軟で高忠実度な画像生成を可能にします。

2. ByteDance の ComfyUI UNO の利点:

- 優れた主題一貫性: UNO は、異なるコンテキストにわたって卓越した主題の類似性を維持します。

- 主題-オブジェクト制御: 多くの代替手段とは異なり、UNO はアイデンティティの混乱なく主題参照とオブジェクト参照の両方を同時に処理することに優れています。

- ユニバーサル互換性: UNO は、人、物体、玩具、ロゴなどの多様な主題タイプに対応します。

- リソース効率: UNO は、限られた VRAM リソース(24GB でうまく動作)でもプロフェッショナルな品質の結果を提供します。

- 柔軟な実装: UNO は、単一の主題生成と主題-オブジェクト生成の両方のワークフローを含みます。

3. ByteDance の ComfyUI UNO の使い方

3.1 ワークフロー設定

UNO ワークフローには 2 つの主要な構成があります:

トップグループ - 主題-オブジェクト生成:

- この構成では、参照主題画像と参照オブジェクト画像を入力し、それに従ってテキストプロンプトに応じて生成されたシーンで組み合わせます。

ボトムグループ - 単一の主題生成:

- この構成では、単一の参照画像を使用し、その主題の異なるコンテキストで新しい画像を生成します。

3.2 ByteDance の UNO を使用した生成プロセス

基本設定:

- 参照画像をロード:

- 主題-オブジェクトワークフロー(トップグループ)用:1 つの主題参照画像と 1 つのオブジェクト参照画像をアップロード

- 単一の主題ワークフロー(ボトムグループ)用:1 つの参照画像をアップロード

- ByteDance の UNO 用テキストプロンプトを設定:

- 望むシーンの説明的なプロンプトを書き、参照主題/オブジェクトがどのように見えるべきかを含めます

- ByteDance の UNO パラメーターを調整:

Width/Height: 出力解像度を決定(768×1024 または 1024×1024 が推奨)Guidance: ByteDance の UNO 生成がテキストプロンプトにどれだけ密接に従うかを制御(3.5-4.0 が推奨)Num_steps: 高い値(20 以上)は、特に人間の顔において ByteDance の UNO を使用したより一貫した結果を生成Seed: 再現性のために特定のシードを設定するか、ByteDance の UNO 出力にバリエーションを加えるためにランダム化

- ByteDance の UNO で画像を生成:

- 「Queue Prompt」をクリックして ByteDance UNO ワークフローを実行

- 「Save Image」ノードで結果を確認

3.3 ByteDance の UNO 用パラメータリファレンス

UNO Loadmodel ノード:

model_type: 使用する ByteDance UNO モデルのバリアントを決定flux-dev: 質とパフォーマンスのバランスが良い標準的な ByteDance UNO モデルflux-schnell: やや低品質で高速な ByteDance UNO モデルバリアント

3.4 ByteDance の UNO で最良の結果を得るためのヒント

UNO 用主題選択:

- 主題が際立っている明るい参照画像を選択

- 顔/人の場合、ByteDance の UNO では前向きで中立的な表情の画像が最適

- オブジェクトの場合、背景の干渉が最小の明確な画像が ByteDance の UNO 処理に理想的

UNO 用プロンプトエンジニアリング:

- 参照画像に合う主題の説明を具体的にする

- ByteDance の UNO が生成する望むシーン、照明、構成を説明

- 特定の主題への参照を含める(例:「若い男性」、「ビンテージ自転車」)

- ByteDance UNO の最適な結果のためにプロンプトを簡潔だが詳細にする

4. ByteDance の UNO に関する技術情報

ByteDance UNO 技術は FLUX モデルに基づいており、いくつかの主要な強化を伴った DiT (Diffusion Transformer) アーキテクチャを活用しています:

- Universal Rotary Position Embedding (UnoPE): ByteDance の UNO における参照主題とオブジェクトを区別するための特別なメカニズムで、属性の混乱を大幅に減少させます。

- Progressive Cross-Modal Alignment: ByteDance の UNO がますます複雑なマルチコンディション制御を処理できるようにするトレーニング手法。

- ユニバーサルカスタマイゼーション: ByteDance の UNO は、特化したトレーニングなしで多様な主題タイプを処理することが可能です。

5. 謝辞

このワークフローは、ByteDance の インテリジェントクリエーションチーム(Shaojin Wu、Mengqi Huang、Wenxu Wu、Yufeng Cheng、Fei Ding、および Qian He)によって開発された UNO によって駆動されています。ByteDance の革新的な研究をアクセス可能なワークフローに適応させた ComfyUI 統合は、コミュニティの貢献者によって提供されています。

ByteDance の UNO に関する追加情報については、 をご覧ください。