Tutoriel de Workflow#

Wan 2.2 Animate : Échange de Personnages & Synchronisation Labiale#

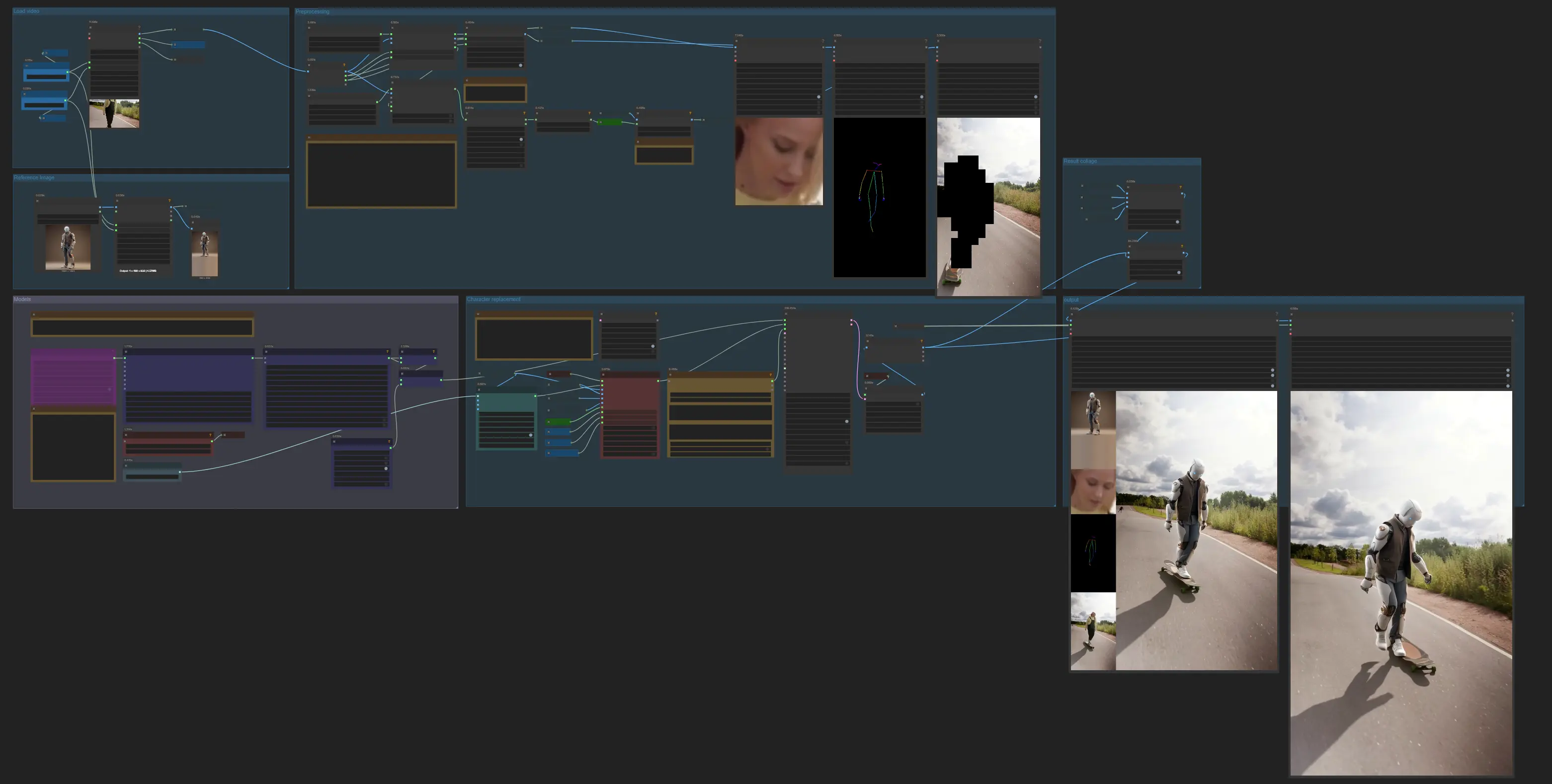

Échangez n'importe quel intervenant à l'écran par votre propre personnage tout en gardant les mouvements, expressions et formes de bouche alignés avec l'audio original. Ce workflow ComfyUI, construit autour de Wan 2.2 Animate : Échange de Personnages & Synchronisation Labiale, détecte la pose corporelle et les cadres faciaux à partir d'une vidéo d'entrée, les réoriente vers une image de référence unique et rend un résultat cohérent, synchrone avec le discours.

Le workflow convient aux éditeurs, créateurs et chercheurs qui souhaitent un remplacement de personnage fiable pour des interviews, bandes démo, VTubing, diaporamas ou courts métrages doublés. Fournissez un clip source et une image de référence propre ; le pipeline recrée la pose et l'articulation labiale sur le nouveau personnage et mélange la bande sonore originale dans l'export final.

Modèles clés dans le workflow Comfyui Wan 2.2 Animate : Échange de Personnages & Synchronisation Labiale#

- Wan 2.2 Animate 14B (FP8 scaled) : le générateur vidéo principal qui synthétise le personnage réorienté à travers les cadres en utilisant les signaux de pose, de visage et de contexte. Model hub

- Wan 2.1 VAE (bf16) : encode/décode les latents vidéo utilisés par Wan lors de l'échantillonnage et de la sortie. Weights

- UMT5‑XXL Text Encoder (bf16) : construit des embeddings de texte pour un léger guidage ou des descripteurs de plans. Weights

- CLIP Vision H : extrait des caractéristiques d'image robustes du portrait de référence pour préserver l'identité. Weights

- Lightx2v I2V 14B LoRA : améliore la stabilité et la fidélité image-à-vidéo lors de l'utilisation de cadres de référence. LoRA

- Wan22 Relight LoRA : aide à maintenir un éclairage et une ombre uniformes tout au long du plan. LoRA

- YOLOv10m (ONNX) : détection rapide de personnes/visages utilisée avant l'estimation de pose. Model

- ViTPose WholeBody Large (ONNX) : points clés squelettiques de haute qualité pour le transfert de mouvement du corps entier. Model

- Segment Anything 2.1 : segmentation pour des masques de premier plan propres qui guident le remplacement. Repo

Comment utiliser le workflow Comfyui Wan 2.2 Animate : Échange de Personnages & Synchronisation Labiale#

Le graphique se déplace à travers sept groupes : charger les entrées, construire une référence, prétraiter la pose/visage et les masques, charger les modèles de génération, exécuter le remplacement de personnage, prévisualiser les diagnostics, puis exporter avec l'audio.

Charger la vidéo#

Importez votre clip source avec VHS_LoadVideo (#63). Le nœud expose une largeur/hauteur optionnelle pour le redimensionnement et sort les cadres vidéo, l'audio et le nombre de cadres pour une utilisation en aval. Gardez le clip coupé près de la partie parlée si vous voulez un traitement plus rapide. L'audio est transmis à l'exportateur pour que la vidéo finale reste alignée avec la bande sonore originale.

Image de référence#

Fournissez un portrait propre et unique du personnage cible. L'image est redimensionnée avec ImageResizeKJv2 (#64) pour correspondre à votre résolution de travail et est stockée comme référence canonique utilisée par CLIP Vision et le générateur. Privilégiez une image nette, orientée vers l'avant sous un éclairage similaire à votre plan source pour réduire la dérive de couleur et d'éclairage.

Prétraitement#

OnnxDetectionModelLoader (#178) charge YOLO et ViTPose, puis PoseAndFaceDetection (#172) analyse chaque cadre pour produire des points clés du corps entier et des recadrages de visage par cadre. Sam2Segmentation (#104) crée un masque de premier plan en utilisant soit des boîtes de délimitation détectées soit des points de cadre clé ; si un indice échoue, passez à l'autre pour une meilleure séparation. Le masque est affiné avec GrowMaskWithBlur (#182) et bloqué avec BlockifyMask (#108) pour donner au générateur une région de sujet stable et sans ambiguïté. Des superpositions optionnelles (DrawViTPose (#173) et DrawMaskOnImage (#99)) vous aident à vérifier visuellement la couverture de pose et la qualité du masque avant la génération.

Modèles#

WanVideoModelLoader (#22) charge Wan 2.2 Animate 14B, et WanVideoVAELoader (#38) fournit le VAE. Les caractéristiques d'identité du portrait de référence sont encodées par CLIPVisionLoader (#71) et WanVideoClipVisionEncode (#70). Le style et la stabilité sont ajustés avec WanVideoLoraSelectMulti (#171), tandis que WanVideoSetLoRAs (#48) et WanVideoSetBlockSwap (#50) appliquent les LoRAs et les paramètres de blocage au modèle ; ces outils proviennent de la bibliothèque wrapper Wan. Voir ComfyUI‑WanVideoWrapper pour les détails de l'implémentation.

Remplacement de personnage#

WanVideoTextEncodeCached (#65) accepte une invite descriptive courte si vous souhaitez influencer l'apparence ou l'ambiance du plan. WanVideoAnimateEmbeds (#62) fusionne l'image de référence, la pose par cadre, les recadrages de visage, l'arrière-plan et le masque en embeddings d'image qui préservent l'identité tout en correspondant au mouvement et aux formes de bouche. WanVideoSampler (#27) rend ensuite les cadres ; son planificateur et ses étapes contrôlent le compromis netteté-mouvement. Les cadres décodés de WanVideoDecode (#28) sont remis aux inspecteurs de taille/compte pour que vous puissiez confirmer les dimensions avant l'exportation.

Collage de résultats#

Pour un contrôle qualité rapide, le workflow concatène les entrées clés avec ImageConcatMulti (#77, #66) pour former une simple bande de comparaison de la référence, des recadrages de visage, de la visualisation de pose et d'un cadre brut. Utilisez-le pour vérifier la cohérence des indices d'identité et des formes de bouche juste après un test.

Sortie#

VHS_VideoCombine (#30) produit la vidéo finale et mélange l'audio original pour un timing parfait. Des exportateurs supplémentaires sont inclus pour que vous puissiez enregistrer des diagnostics intermédiaires ou des coupes alternatives si nécessaire. Pour de meilleurs résultats sur des clips plus longs, exportez d'abord un test court, puis itérez sur les mélanges LoRA et les masques avant de vous engager dans un rendu complet.

Nœuds clés dans le workflow Comfyui Wan 2.2 Animate : Échange de Personnages & Synchronisation Labiale#

VHS_LoadVideo (#63) Charge les cadres et l'audio original en une seule étape. Utilisez-le pour définir une résolution de travail qui correspond à votre budget GPU et pour confirmer le nombre de cadres que les nœuds en aval consommeront. De ComfyUI‑VideoHelperSuite.

PoseAndFaceDetection (#172) Exécute YOLO et ViTPose pour extraire les boîtes de personnes, les points clés du corps entier et les recadrages de visage par cadre. De bons points clés sont la colonne vertébrale d'un transfert de mouvement crédible et sont directement réutilisés pour l'articulation labiale. De ComfyUI‑WanAnimatePreprocess.

Sam2Segmentation (#104) Construit un masque de premier plan autour du sujet en utilisant soit des boîtes de délimitation soit des indices de points de cadre clé. Si les cheveux ou les mains sont manqués, changez le type d'indice ou étendez les paramètres de flou/croissance avant de bloquer. De ComfyUI‑segment‑anything‑2.

WanVideoLoraSelectMulti (#171) Vous permet de mélanger des LoRAs tels que Lightx2v et Wan22 Relight pour équilibrer la stabilité du mouvement, la cohérence de l'éclairage et la force d'identité. Augmentez le poids d'un LoRA pour plus d'influence, mais surveillez la sur-stylisation des visages. De ComfyUI‑WanVideoWrapper.

WanVideoAnimateEmbeds (#62) Combine le portrait de référence, les images de pose, les recadrages de visage, les cadres d'arrière-plan et le masque en une représentation compacte qui conditionne Wan 2.2 Animate. Assurez-vous que width, height et num_frames correspondent à votre exportation prévue pour éviter les artefacts de rééchantillonnage. De ComfyUI‑WanVideoWrapper.

WanVideoSampler (#27) Génère les cadres finaux. Utilisez des étapes plus élevées et un planificateur plus stable lorsque vous avez besoin de détails plus nets, ou un plan plus léger pour des aperçus rapides. Pour les clips très longs, vous pouvez éventuellement introduire des contrôles de fenêtre de contexte en connectant WanVideoContextOptions (#110) pour maintenir la cohérence temporelle à travers les fenêtres.

VHS_VideoCombine (#30) Exporte la vidéo finie et mélange l'audio original pour que les mouvements labiaux restent synchronisés. L'option de découpage à l'audio garde la durée alignée avec la bande sonore. De ComfyUI‑VideoHelperSuite.

Extras optionnels#

- Utilisez une référence nette et orientée vers l'avant avec des lèvres neutres pour le transfert d'identité le plus propre ; évitez le maquillage lourd ou les occlusions.

- Si la segmentation manque les cheveux ou les accessoires, essayez de changer les indices

Sam2Segmentationentre les boîtes de délimitation et les points de cadre clé, puis augmentez légèrement le masque avant de le bloquer. - Lightx2v LoRA améliore la stabilité I2V ; Wan22 Relight LoRA aide à faire correspondre l'éclairage incohérent. De petits changements de poids peuvent résoudre le scintillement sans trop cuire un look.

- Le changement de bloc peut réduire la dérive d'identité sur les longs plans ; si les visages s'adoucissent avec le temps, activez-le dans

WanVideoSetBlockSwap(#50) et retestez. - Gardez la résolution de travail proportionnelle à la source pour éviter la distorsion de l'aspect ; augmentez seulement lorsque l'image de référence est suffisamment détaillée pour le supporter.

- Pour des exécutions capables, l'activation de la compilation torch et de l'attention efficace dans les nœuds de wrapper peut accélérer l'échantillonnage ; voir ComfyUI‑WanVideoWrapper pour des conseils.

Ce workflow Wan 2.2 Animate : Échange de Personnages & Synchronisation Labiale offre un transfert de mouvement cohérent et des formes de bouche synchrones avec le discours avec un minimum de configuration, rendant les échanges de personnages de haute qualité rapides et reproductibles à l'intérieur de ComfyUI.

Remerciements#

Ce workflow implémente et s'appuie sur les travaux et ressources suivants. Nous remercions chaleureusement @MDMZ pour avoir construit l'ensemble du workflow, Kijai pour WAN 2.2 Animate et les nœuds ComfyUI associés, Wan-AI pour les actifs Wan2.2-Animate y compris la détection YOLOv10m, et Comfy-Org pour le modèle Wan 2.1 Clip Vision pour leurs contributions et leur maintenance. Pour des détails autoritaires, veuillez vous référer à la documentation originale et aux référentiels liés ci-dessous.

Ressources#

- Tutoriel de Workflow

- Youtube : ComfyUI-Tutorial de @MDMZ

Remarque : L'utilisation des modèles, ensembles de données et code référencés est soumise aux licences et conditions respectives fournies par leurs auteurs et mainteneurs.