Workflow de mise à l'échelle vidéo SeedVR2 V2.5 pour ComfyUI#

SeedVR2 V2.5 est un upscaler vidéo et image haute-fidélité qui restaure les détails, affine les textures et améliore la cohérence temporelle tout en gardant le mouvement fluide. Ce workflow ComfyUI enveloppe le transformateur de diffusion SeedVR2 et son VAE pour que vous puissiez mettre à l'échelle des clips générés par IA, des séquences d'archives ou post-traiter des rendus en résultats plus propres et cinématographiques.

Conçu pour les artistes et les éditeurs, le workflow SeedVR2 V2.5 gère à la fois les images uniques et les vidéos complètes, y compris le contenu RGBA, et préserve l'audio original et la fréquence d'images lors du réassemblage de la vidéo mise à l'échelle. Il inclut des options d'accélération à la compilation et des choix de modèles qui équilibrent qualité, VRAM et vitesse.

Modèles clés dans le workflow SeedVR2 V2.5 ComfyUI#

- SeedVR2 Diffusion Transformer 3B et 7B. Modèles de restauration en une étape qui améliorent la résolution et la qualité perceptuelle tout en maintenant la cohérence temporelle. Utilisez 3B pour un VRAM inférieur ou un délai d'exécution plus rapide et 7B lorsque vous souhaitez la fidélité la plus élevée. Voir les fiches modèles officielles et le document pour plus de détails : ByteDance-Seed/SeedVR2-3B, ByteDance-Seed/SeedVR2-7B, et le document SeedVR2 sur la restauration vidéo en une étape arXiv:2506.05301.

- SeedVR2 VAE (ema_vae_fp16). Autoencodeur Variationnel utilisé pour encoder les cadres en espace latent et décoder les résultats restaurés en RGB avec support de tuilage pour les grandes résolutions. Distribué avec l'intégration ComfyUI : numz/SeedVR2_comfyUI.

- Variantes quantifiées optionnelles. L'intégration communautaire expose les options FP8 et GGUF pour réduire la mémoire à certains compromis de qualité ou de vitesse. Voir le dépôt de nœuds ComfyUI SeedVR2 pour les options actuelles : ComfyUI-SeedVR2_VideoUpscaler.

Comment utiliser le workflow SeedVR2 V2.5 ComfyUI#

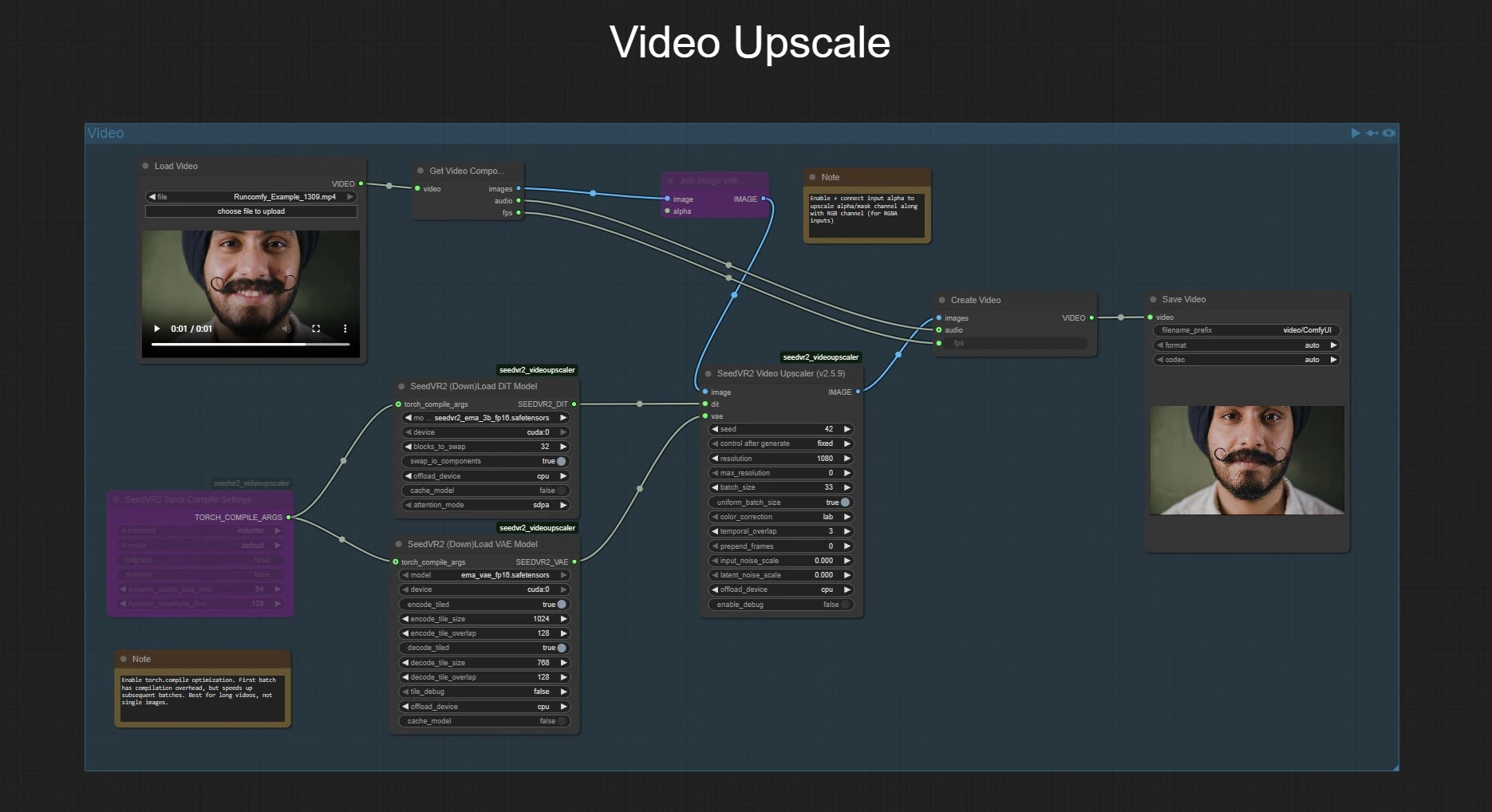

Ce graphique a deux groupes indépendants qui partagent les mêmes chargeurs de modèles et logique d'upscaler. Utilisez le groupe Image pour les images fixes uniques. Utilisez le groupe Vidéo pour diviser une vidéo en images et audio, mettre à l'échelle les images avec SeedVR2 V2.5, puis réassembler le clip avec l'audio et la fréquence d'images originaux.

Groupe Image#

Chargez une image fixe avec LoadImage (#27). Si votre image a de la transparence, passez-la par JoinImageWithAlpha (#31) afin que le canal alpha soit préservé lors de la mise à l'échelle. Choisissez et chargez un point de contrôle DiT avec SeedVR2LoadDiTModel (#28) et un VAE avec SeedVR2LoadVAEModel (#29); les modèles se téléchargent automatiquement à la première utilisation. Alimentez l'image dans SeedVR2VideoUpscaler (#30) pour mettre à l'échelle et restaurer; le nœud se concentre sur la récupération des détails et un affûtage contrôlé qui correspond à l'apparence de SeedVR2 V2.5. Enregistrez les résultats avec SaveImage (#32). Pour les exécutions par lots, vous pouvez activer SeedVR2TorchCompileSettings (#25) pour compiler le graphique une fois et accélérer les lots suivants.

Groupe Vidéo#

Importez un clip avec LoadVideo (#21), puis GetVideoComponents (#22) extrait les images, l'audio et la fréquence d'images. Si vos images contiennent de l'alpha, fusionnez-le via JoinImageWithAlpha (#17) avant la mise à l'échelle. Chargez votre DiT et VAE choisis avec SeedVR2LoadDiTModel (#14) et SeedVR2LoadVAEModel (#13), puis mettez à l'échelle le flux d'images avec SeedVR2VideoUpscaler (#10). Reconstruisez la vidéo en utilisant CreateVideo (#24), qui passe par l'audio et la fréquence d'images originaux, et écrivez le fichier avec SaveVideo (#23). Pour les clips longs, SeedVR2TorchCompileSettings (#19) réduit le temps par itération après une étape de compilation initiale.

Nœuds clés dans le workflow SeedVR2 V2.5 ComfyUI#

SeedVR2VideoUpscaler (#10 et #30) Nœud central de restauration et de mise à l'échelle alimenté par SeedVR2. Définissez votre objectif de mise à l'échelle soit par échelle soit par dimensions cibles, et choisissez une taille de lot qui correspond à votre GPU. La cohérence temporelle est assurée par le traitement de plusieurs images voisines ensemble; les conseils officiels notent qu'un lot d'au moins 5 images active la cohérence temporelle pour les vidéos, avec des lots plus grands améliorant la stabilité si le VRAM le permet ComfyUI-SeedVR2_VideoUpscaler. Pour RGBA, assurez-vous que le chemin alpha est connecté en amont. Si vous voyez une pression sur la mémoire à haute résolution, réduisez la résolution cible ou passez à une variante de modèle plus légère.

SeedVR2LoadDiTModel (#14 et #28) Charge le point de contrôle du transformateur SeedVR2 et configure l'appareil d'inférence. Choisissez entre 3B et 7B en fonction de votre budget qualité et VRAM; FP16 offre la meilleure fidélité, tandis que FP8 ou GGUF peuvent aider sur des GPU contraints comme exposé par l'intégration communautaire numz/SeedVR2_comfyUI et le dépôt officiel de nœuds ComfyUI ComfyUI-SeedVR2_VideoUpscaler. Gardez le DiT sur votre GPU le plus rapide sauf si vous déchargez explicitement pour la mémoire.

SeedVR2LoadVAEModel (#13 et #29) Charge le VAE EMA utilisé pour encoder et décoder. Lors du ciblage de grandes sorties, activez l'encodage ou le décodage en tuiles pour réduire le pic de VRAM à un petit coût en vitesse; ajustez la taille des tuiles et le chevauchement uniquement si vous rencontrez des OOM ou des artefacts de bord. Le déchargement du VAE vers le CPU ou un autre GPU peut libérer de la place pour le DiT sans changer les résultats numz/SeedVR2_comfyUI.

SeedVR2TorchCompileSettings (#19 et #25) Accélération optionnelle qui compile des parties du chemin SeedVR2 en un plan de noyau fusionné. La première exécution paie un coût de compilation, puis les lots suivants sont plus rapides, ce qui est idéal pour les vidéos plus longues ou les itérations répétées ComfyUI-SeedVR2_VideoUpscaler.

Extras optionnels#

- Choisissez le modèle adapté à votre travail : 3B pour la vitesse ou un VRAM limité, 7B lorsque le détail absolu est important SeedVR2-3B, SeedVR2-7B.

- Préservez l'audio et le timing en gardant les sorties

audioetfpsdeGetVideoComponents(#22) connectées àCreateVideo(#24). - Pour le contenu lourd avec transparence, assurez-vous que l'alpha est fusionné via

JoinImageWithAlphaavant l'upscaler pour garder les bords nets en composition. - Si vous atteignez OOM, essayez une résolution de sortie plus basse, passez au modèle 3B, activez le tuilage VAE, ou utilisez un point de contrôle quantifié où disponible numz/SeedVR2_comfyUI.

- Pour un aperçu plus approfondi sur la façon dont SeedVR2 réalise la restauration en une étape avec une attention à fenêtre adaptative et un post-entraînement adversarial, consultez le document arXiv:2506.05301 et l'implémentation de référence IceClear/SeedVR2.

Remerciements#

Ce workflow met en œuvre et s'appuie sur les travaux et ressources suivants. Nous remercions chaleureusement numz pour le ComfyUI-SeedVR2_VideoUpscaler (nœuds/workflow SeedVR2 v2.5), et AInVFX pour le tutoriel vidéo officiel SeedVR2 v2.5, pour leurs contributions et leur entretien. Pour des détails autoritaires, veuillez vous référer à la documentation originale et aux dépôts ci-dessous.

Ressources#

- Source SeedVR2 V2.5 : https://www.reddit.com/r/comfyui/comments/1ordkfc/seedvr2_v25_released_complete_redesign_with_gguf

- GitHub : numz/ComfyUI-SeedVR2_VideoUpscaler

- Docs / Notes de Rélease : Post Reddit

- Démo Youtube SeedVR2 V2.5 : https://www.youtube.com/watch?v=MBtWYXq_r60

- Docs / Notes de Rélease @AInVFX : Vidéo YouTube

Note : L'utilisation des modèles, jeux de données et code référencés est soumise aux licences et termes respectifs fournis par leurs auteurs et mainteneurs.