Qwen Edit 2509 LoRA Inférence: modifications Qwen Image Edit Plus 2509 correspondant à l'entraînement dans ComfyUI#

L'inférence Qwen Edit 2509 LoRA est un workflow RunComfy prêt pour la production qui vous permet d'appliquer un LoRA formé par AI Toolkit sur Qwen Image Edit Plus 2509 dans ComfyUI avec des résultats correspondant à l'entraînement. Il est construit autour de RC Qwen Image Edit Plus (RCQwenImageEditPlus)—un nœud personnalisé open-source construit par RunComfy (source) qui exécute un pipeline d'édition Qwen spécifique au modèle (pas un graphe d'échantillonnage générique), injecte votre adaptateur via lora_path / lora_scale, et maintient le prétraitement d'image de contrôle requis aligné avec la façon dont le modèle d'édition encode les invites.

Pourquoi l'inférence Qwen Edit 2509 LoRA semble souvent différente dans ComfyUI#

Les images échantillons d'AI Toolkit sont produites par un pipeline de style Qwen Image Edit Plus 2509 qui couple l'invite de texte avec l'image d'entrée lors de l'encodage de l'invite, puis applique le guidage en utilisant le comportement “true CFG” de Qwen. Si vous recréez le travail comme un graphe d'édition ComfyUI standard, de petites différences dans le conditionnement, les sémantiques de guidage et l'endroit où le LoRA est appliqué peuvent se cumuler—donc même en correspondant invite/étapes/graine, cela ne reproduira pas de manière fiable l'aperçu. En d'autres termes, l'écart est généralement un désaccord de pipeline, pas un “mauvais réglage”.

Ce que fait le nœud personnalisé RCQwenImageEditPlus#

RCQwenImageEditPlus dirige l'édition Qwen Image Edit Plus 2509 à travers le même type de pipeline d'inférence aligné sur l'aperçu et applique votre LoRA AI Toolkit de manière cohérente à l'intérieur de ce pipeline en utilisant lora_path et lora_scale. Il gère également l'image de contrôle de la manière attendue par cette famille pour les invites conditionnées à l'édition (y compris le redimensionnement pour l'encodage de l'invite), de sorte que le comportement de base se rapproche de ce que vous avez vu lors des échantillons d'entraînement. Implémentation de pipeline de référence : `src/pipelines/qwen_image.py`.

Comment utiliser le workflow Qwen Edit 2509 LoRA Inférence#

Étape 1 : Importez votre LoRA (2 options)#

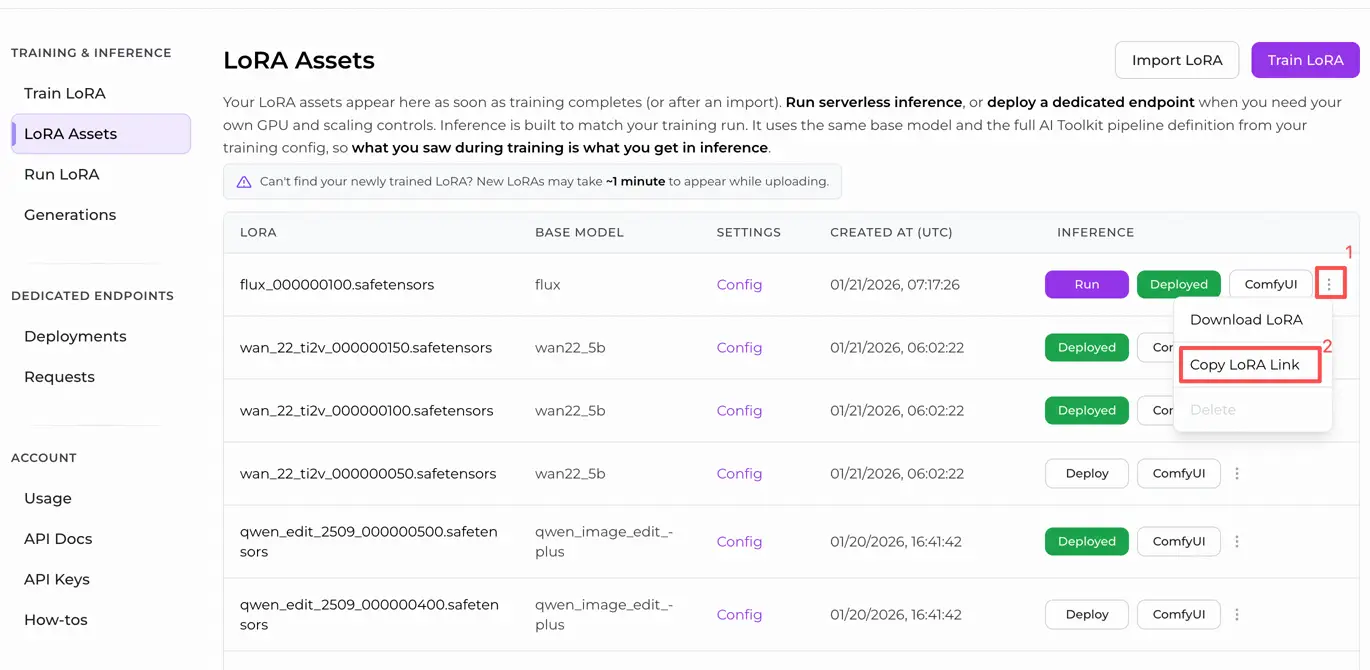

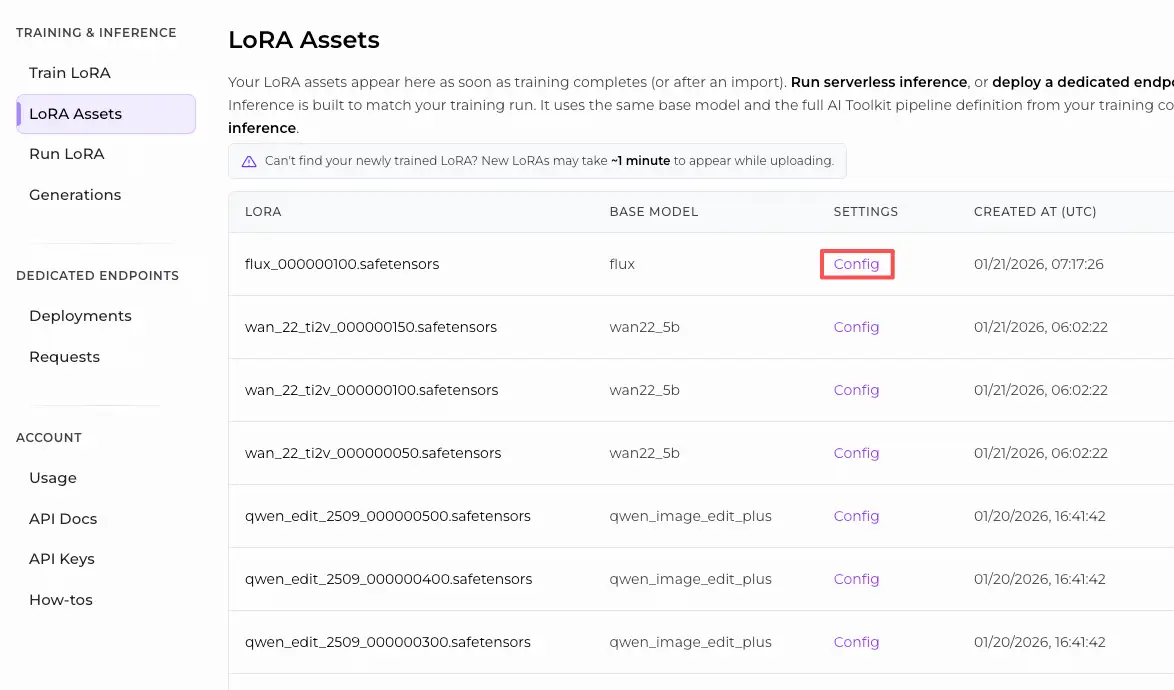

- Option A (résultat d'entraînement RunComfy): RunComfy → Trainer → LoRA Assets → trouvez votre LoRA → ⋮ → Copier le lien LoRA

- Option B (LoRA AI Toolkit formé en dehors de RunComfy): Copiez un lien de téléchargement direct

.safetensorspour votre LoRA et collez cette URL danslora_path(pas besoin de télécharger dansComfyUI/models/loras)

Étape 2 : Configurez le nœud personnalisé RCQwenImageEditPlus pour Qwen Edit 2509 LoRA Inférence#

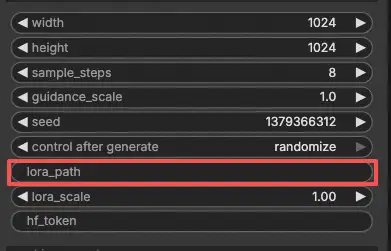

Collez votre lien LoRA dans lora_path sur RCQwenImageEditPlus (utilisez le lien RunComfy de l'option A, ou une URL directe .safetensors de l'option B).

Ensuite, définissez le reste des paramètres du nœud (commencez par refléter vos valeurs d'aperçu/échantillon AI Toolkit pendant que vous validez l'alignement) :

prompt: votre instruction d'édition (incluez les mêmes jetons déclencheurs avec lesquels vous vous êtes entraîné, le cas échéant)negative_prompt: facultatif; laissez-le vide si vous n'avez pas utilisé de négatifs dans vos échantillons d'entraînementwidth/height: taille de sortie (des multiples de 32 sont recommandés pour cette famille de pipelines)sample_steps: nombre d'étapes d'inférence; correspond au nombre d'étapes d'aperçu avant l'ajustementguidance_scale: force du guidage (Qwen utilise une échelle “true CFG”, donc réutilisez d'abord votre valeur d'aperçu)seed: verrouillez la graine tout en comparant l'aperçu d'entraînement et l'inférence ComfyUI en définissant control_after_generate sur 'fixed'lora_scale: force du LoRA; commencez à votre force d'aperçu, puis ajustez progressivement

Il s'agit d'un workflow d'édition d'image, vous devez donc également fournir une image d'entrée :

control_image(entrée requise): connectez un nœud LoadImage àcontrol_image, puis remplacez l'image d'échantillon par la photo que vous souhaitez éditer.

Note sur l'alignement de l'entraînement : si vous avez personnalisé l'échantillonnage lors de l'entraînement, ouvrez votre YAML d'entraînement AI Toolkit et reflétez width, height, sample_steps, guidance_scale, seed, et lora_scale. Si vous vous êtes entraîné sur RunComfy, allez à Trainer → LoRA Assets → Config et copiez les valeurs d'aperçu/échantillon dans RCQwenImageEditPlus.

Étape 3 : Exécutez l'inférence Qwen Edit 2509 LoRA#

Mettez en file d'attente/exécutez le workflow. Le nœud SaveImage écrit la sortie éditée dans votre dossier de sortie ComfyUI habituel.

Dépannage de l'inférence Qwen Edit 2509 LoRA#

La plupart des problèmes rencontrés par les gens après avoir formé un Qwen Image Edit Plus 2509 LoRA dans AI Toolkit puis tenté de l'exécuter dans ComfyUI proviennent d'un désaccord de pipeline / chargeur—surtout lors du mélange de chargeurs Qwen Edit 2509 quantifiés Nunchaku, de graphes d'échantillonnage génériques, et de chargeurs LoRA qui patchent les poids à un endroit différent de celui du pipeline d'aperçu AI Toolkit.

Le nœud personnalisé RC Qwen Image Edit Plus (RCQwenImageEditPlus) de RunComfy est conçu pour vous ramener à une référence correspondant à l'entraînement en :

- exécutant un pipeline d'édition spécifique à Qwen Image Edit Plus 2509 (pas un graphe d'échantillonnage générique), et

- injectant votre LoRA AI Toolkit à l'intérieur de ce pipeline via

lora_path/lora_scale,

ainsi le conditionnement de l'édition + le comportement de guidage est plus proche de ce que vous avez vu lors de l'échantillonnage d'aperçu AI Toolkit.

(1) Comfy génère du bruit après l'annulation de la génération Qwen Image Edit Nunchaku#

Pourquoi cela arrive

Il s'agit d'un mode d'échec réel signalé spécifiquement autour de Qwen Image Edit dans un workflow ComfyUI basé sur Nunchaku : annuler une exécution peut laisser le modèle/graphe dans un mauvais état, et les exécutions suivantes ne produisent que du bruit même avec des invites et des paramètres valides.

Comment résoudre (corrections fonctionnelles signalées par les utilisateurs)

- Récupération en utilisant le “Clear Models and Node Cache” de ComfyUI (ou une réinitialisation équivalente du cache modèle/nœud) puis en relançant.

- revenir à ComfyUI 0.3.65 a aidé si la régression persistait.

- Si votre objectif est la validation de LoRA correspondant à l'entraînement (parité d'aperçu), exécutez la même édition via RCQwenImageEditPlus d'abord. Cela maintient l'inférence alignée sur le pipeline avec l'échantillonnage d'aperçu de style AI Toolkit et évite le débogage des effets secondaires de “bruit après annulation” dans un chemin d'échantillonnage générique / Nunchaku.

(2) l'édition d'image qwen ne supporte pas le chargement de Lora#

Pourquoi cela arrive

Cela a été signalé comme une limitation du chemin ComfyUI-nunchaku Qwen Image Edit : le chargement de LoRA échoue / avertit parce que cette route d'inférence ne patch pas les mêmes modules contre lesquels le LoRA a été formé (ou ne prend tout simplement pas en charge l'injection de LoRA pour Qwen Edit dans cette implémentation).

Comment résoudre (résolution pratique et fiable)

- Dans ce chemin Nunchaku, le problème a été clos comme non prévu—donc la solution pratique est de basculer l'inférence vers un pipeline qui prend en charge l'injection Qwen Edit 2509 LoRA.

- Dans RunComfy, cela signifie utiliser RCQwenImageEditPlus et charger l'adaptateur uniquement via :

lora_path(votre URL AI Toolkit.safetensors)lora_scale(force) Cela maintient l'application LoRA à l'intérieur du pipeline Qwen Edit 2509, ce qui est exactement ce que vous voulez pour des comparaisons correspondant à l'entraînement.

- Si vous devez rester sur la quantification Nunchaku pour la vitesse, utilisez un chargeur LoRA spécifique à Qwen/Nunchaku (pas le chargeur d'édition de base s'attendant à un “comportement LoRA générique”).

(3) le workflow multi-étapes ne réinitialise pas le cache#

Pourquoi cela arrive

Dans les workflows multi-étapes (différents LoRAs par étape), les utilisateurs ont signalé que l'état LoRA peut “coller” à travers les réexécutions—donc l'étape 1 peut accidentellement réutiliser les LoRAs de l'étape 2 à moins que le cache ne soit réinitialisé.

Comment résoudre (solution de contournement vérifiée par les utilisateurs)

- Les utilisateurs ont signalé que le workflow se réinitialise correctement uniquement lorsque le modèle est manuellement déchargé / purgé entre les réexécutions.

- Si vous validez la correspondance d'aperçu AI Toolkit, gardez votre workflow de référence à une seule étape et exécutez-le d'abord via RCQwenImageEditPlus (aligné sur le pipeline). Ajoutez la logique multi-étapes uniquement après que votre référence est stable.

(4) TypeError : plusieurs valeurs pour l'argument 'guidance' (v2.0+)#

Pourquoi cela arrive

Dans certains environnements, les utilisateurs rencontrent TypeError: got multiple values for argument 'guidance' lorsque les chargeurs LoRA et les piles scheduler/patch interagissent avec la signature forward de QwenImageTransformer2DModel (une duplication d'argument peut se produire selon l'ordre de patch et les modifications externes du scheduler).

Comment résoudre (solution documentée par le mainteneur pour les utilisateurs concernés)

- La section de dépannage du chargeur recommande : si vous rencontrez toujours cela sur v2.0+ même après les mises à jour, utilisez v1.72 (la dernière version v1.x avant l'ajout du support diffsynth ControlNet), car elle évite la complexité de passage d'arguments qui déclenche la duplication de

guidance. - Après avoir restauré la stabilité, effectuez des vérifications de parité d'entraînement dans RCQwenImageEditPlus afin que votre débogage d'alignement d'aperçu ne soit pas confondu par des cas limites de signature chargeur/scheduler.

(5) Images de contrôle manquantes pour QwenImageEditPlusModel#

Pourquoi cela arrive

Qwen Image Edit Plus 2509 est une famille de modèles conditionnés à l'édition. Dans l'entraînement AI Toolkit et dans l'inférence ComfyUI, le pipeline s'attend à une entrée d'image de contrôle pour coupler l'instruction d'édition avec le chemin d'encodage conditionné par l'image. Si les images de contrôle sont manquantes/mal câblées, les travaux d'entraînement ou l'inférence d'édition échoueront ou se comporteront de manière inattendue.

Comment résoudre (approche correcte pour le modèle, cohérente avec l'entraînement)

- Dans ComfyUI, connectez toujours LoadImage →

control_imagesur RCQwenImageEditPlus, et gardez l'image de contrôle fixe lors de la validation de votre LoRA par rapport à la sortie d'aperçu. - Utilisez RCQwenImageEditPlus pour l'inférence afin que le prétraitement de l'image de contrôle + l'encodage de l'invite suivent les attentes du pipeline Qwen Edit 2509 (aligné sur le pipeline avec les aperçus de style AI Toolkit), et votre LoRA est appliqué au bon point de patch via

lora_path/lora_scale.

Exécutez maintenant l'inférence Qwen Edit 2509 LoRA#

Ouvrez le workflow, définissez lora_path, connectez votre control_image, et exécutez RCQwenImageEditPlus pour ramener les résultats ComfyUI en ligne avec vos aperçus AI Toolkit.