ComfyUI MultiTalk : vidéo parlante multi-personnes et mono-personne#

Note : Ceci est la version multi-personnes améliorée de notre workflow ComfyUI MultiTalk Single Person. Il prend désormais en charge la génération de vidéo conversationnelle multi-personnes tout en incluant toujours le mode mono-personne de notre version précédente.

Le workflow est idéal pour le contenu social, les explications produit, les dialogues de personnages et la pré-visualisation rapide. Il associe les embeddings audio MultiTalk à la diffusion vidéo pour que les lèvres, la mâchoire et les signaux faciaux subtils suivent la parole. Utilisez-le comme chemin direct pour les scènes multi-interlocuteurs Meigen MultiTalk ou les clips légers mono-interlocuteur.

Modèles clés du workflow ComfyUI MultiTalk#

Modèle de diffusion vidéo Wan 2.1

Pilote la génération vidéo principale conditionnée par le texte et l'image. Il gère l'apparence de la scène, la caméra et le mouvement tout en acceptant des guidages supplémentaires pour la dynamique conversationnelle.

Wav2Vec 2.0

Extrait des représentations vocales robustes que MultiTalk convertit en embeddings spécifiques à la parole. Référence : facebook/wav2vec2-base-960h.

MultiTalk (MeiGen-AI)

Méthode de recherche pour la vidéo conversationnelle multi-personnes pilotée par l'audio. Implémentation de référence : MeiGen-AI/MultiTalk.

ComfyUI Wan Video Wrapper

Intégration ComfyUI qui expose le chargement de Wan 2.1, les encodeurs et le sampler vidéo, plus le nœud d'embedding MultiTalk. Référence : kijai/ComfyUI-WanVideoWrapper.

Index-TTS (optionnel)

Synthèse vocale avec référence vocale pour générer des pistes de dialogue propres au sein du workflow. Référence : chenpipi0807/ComfyUI-Index-TTS.

Comment utiliser le workflow ComfyUI MultiTalk#

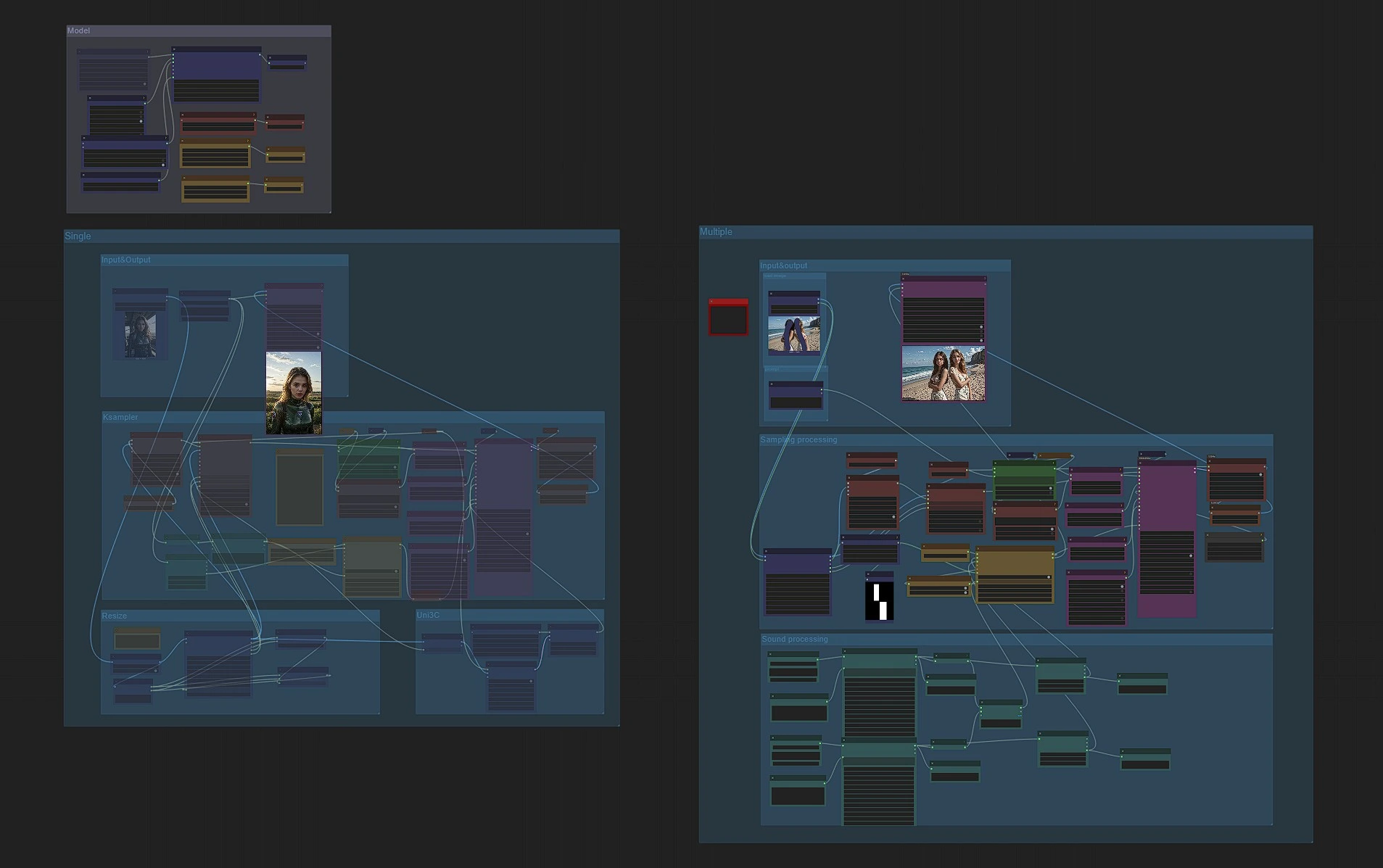

Ce workflow s'exécute de bout en bout : vous préparez les interlocuteurs et l'audio, définissez un court prompt de scène, puis lancez le rendu. Il prend en charge les configurations multi-personnes et mono-personne. Les groupes dans le graphe maintiennent l'organisation ; les plus importants sont décrits ci-dessous.

Input & Output#

Chargez les images d'identité pour vos visages d'interlocuteurs et prévisualisez les masques, puis assemblez les frames finales avec l'audio. Les nœuds LoadImage acceptent vos portraits, tandis que VHS_VideoCombine assemble les frames rendues avec la piste audio sélectionnée en MP4. Vous pouvez parcourir l'audio avec PreviewAudio pendant la configuration pour confirmer les niveaux et la durée.

Model#

Get_WanModel, Get_WanTextEncoder et WanVideoModelLoader initialisent Wan 2.1 avec les composants texte et VAE. Considérez ceci comme la salle des machines : une fois chargé, le sampler vidéo peut accepter les embeddings d'image, de texte et de conversation. Vous n'avez rarement besoin de changer quoi que ce soit ici au-delà de vous assurer que les bons poids Wan sont sélectionnés.

Audio des interlocuteurs (deux méthodes)#

Vous pouvez apporter vos propres pistes de dialogue ou les synthétiser :

- Apporter l'audio : Utilisez

LoadAudiopour importer la ligne de chaque interlocuteur. Si un clip est mélangé avec de la musique ou du bruit, passez-le parAudioSeparationet routez la sortieVocalspropre. - Générer l'audio : Utilisez

Speaker 1 - TextetSpeaker 2 - TextavecIndexTTSNodepour synthétiser les voix à partir de lignes tapées, en donnant optionnellement unreference_audiopour le timbre souhaité.

Embeddings audio MultiTalk#

MultiTalkWav2VecEmbeds convertit la parole en embeddings MultiTalk qui capturent le timing et les nuances d'articulation pour chaque interlocuteur. Alimentez-le avec un flux audio pour une personne seule, ou deux flux pour un dialogue multi-personnes. Si votre scène nécessite un ciblage spécifique au visage, fournissez des masques de visage propres comme ref_target_masks pour que chaque voix pilote la bonne personne.

Prompt et contexte textuel#

Un court prompt de scène via Prompt et WanVideoTextEncodeSingle définit l'ambiance visuelle et l'environnement. Gardez les prompts concis et descriptifs (lieu, ton, éclairage). L'encodeur de texte génère un guidage sémantique que Wan utilise en complément des signaux d'identité et de conversation.

Uni3C et Resize#

Le groupe Uni3C prépare des embeddings de contexte global qui aident à stabiliser l'identité, le cadrage et la composition dans le temps. Le groupe Resize assure que les images et masques source sont redimensionnés aux dimensions compatibles avec le modèle pour que le sampler reçoive des entrées cohérentes.

KSampler et traitement du sampling#

WanVideoSampler est le point de convergence : les embeddings d'image d'identité, les embeddings de texte et les embeddings audio MultiTalk se combinent pour produire les frames finales. Le groupe de traitement du sampling en aval applique toutes les étapes nécessaires pour la fluidité et la cohérence avant le transfert au combineur vidéo.

Masques pour multi-personnes#

Pour les clips multi-personnes, dessinez un masque par visage dans l'éditeur de masques de ComfyUI. Gardez les masques séparés pour qu'ils ne se touchent jamais. Si vous ne fournissez qu'un seul masque et une seule piste audio, le workflow se comporte automatiquement comme une configuration MultiTalk mono-personne.

Nœuds clés du workflow ComfyUI MultiTalk#

MultiTalkWav2VecEmbeds (#79/#162)#

Convertit une ou plusieurs pistes de dialogue en embeddings conversationnels MultiTalk. Commencez avec une entrée audio pour une personne seule ou deux pour multi-personnes ; ajoutez des masques quand vous avez besoin d'un routage par visage. Ajustez uniquement ce qui compte : le nombre de frames pour correspondre à la durée de clip prévue, et s'il faut fournir des ref_target_masks pour un alignement précis interlocuteur-visage.

AudioSeparation (#88/#160/#161)#

Nettoyage optionnel pour les entrées bruitées. Routez votre clip bruité dans ce nœud et transmettez la sortie Vocals. Utilisez-le quand les enregistrements de terrain incluent de la musique de fond ou des bavardages ; ignorez-le si vous avez déjà des pistes vocales propres.

IndexTTSNode (#163/#164)#

Transforme Speaker 1 - Text et Speaker 2 - Text en audio de dialogue. Fournissez un court reference_audio pour cloner le ton et le rythme, puis fournissez les lignes de texte. Gardez les phrases brèves et naturelles pour un meilleur timing labial dans MultiTalk.

WanVideoTextEncodeSingle (#18)#

Encode votre prompt de scène pour Wan 2.1. Privilégiez des descriptions simples et concrètes de lieu, d'éclairage et de style. Évitez les longues listes ; une ou deux phrases suffisent pour que le sampler guide la génération.

Remerciements#

Recherche originale : MultiTalk est développé par MeiGen-AI en collaboration avec des chercheurs de premier plan dans le domaine. L'article original « Let Them Talk: Audio-Driven Multi-Person Conversational Video Generation » présente la recherche révolutionnaire derrière cette technologie. Intégration ComfyUI : L'implémentation ComfyUI est fournie par Kijai via le dépôt ComfyUI-WanVideoWrapper, rendant cette technologie avancée accessible à la communauté créative élargie.

Technologie de base : Construit sur le modèle de diffusion vidéo Wan2.1 et intègre des techniques de traitement audio de Wav2Vec, représentant une synthèse de recherches IA de pointe.

Liens et ressources#

- Recherche originale : MeiGen-AI MultiTalk Repository

- Page du projet : https://meigen-ai.github.io/multi-talk/

- Intégration ComfyUI : ComfyUI-WanVideoWrapper