¡Bienvenido! En esta guía, exploremos las fascinantes características de ComfyUI IPAdapter Plus, también conocido como ComfyUI IPAdapter V2.

Los modelos IPAdapter son muy poderosos para el condicionamiento de imagen a imagen, permitiendo la fácil transferencia del sujeto o estilo de imágenes de referencia a nuevas creaciones. Piensa en ello como un LoRA de 1 imagen.

La introducción de IPAdapter Plus (IPAdapter V2) ha traído una gran cantidad de nuevas características destinadas a optimizar el proceso de integración del modelo, mejorar la usabilidad y expandir las posibilidades creativas.

Es importante tener en cuenta que actualizar a ComfyUI IPAdapter Plus (IPAdapter V2) hará que tus flujos de trabajo anteriores, que dependen del nodo ComfyUI IPAdapter V1, dejen de funcionar. En consecuencia, necesitarás reconstruir tus proyectos utilizando ComfyUI IPAdapter Plus.

Cubriremos:

- 1.1. El flujo de trabajo más simple de ComfyUI IPAdapter

- 1.2. Entradas del nodo "IPAdapter" de ComfyUI

- 1.3. Parámetros en el nodo "IPAdapter" de ComfyUI

- 1.4. La diferencia en el uso de ComfyUI IPAdapter Plus con los modelos de checkpoint SD1.5 y SDXL

- 2.1. El flujo de trabajo avanzado de ComfyUI IPAdapter

- 2.2. Parámetros expandidos en el nodo "IPAdapter Advanced" de ComfyUI

- 3.1. Flujo de trabajo de ComfyUI IPAdapter FaceID

- 4.1. Método 1: Utilizando el nodo "Batch Image" de ComfyUI

- 4.2. Método 2: Control preciso sobre los pesos de referencia utilizando el nodo "IPAdapter Encoder" de ComfyUI

- 5. ComfyUI IPAdapter Plus - IPAdapter Tile para imágenes altas

- 5.1 Flujo de trabajo de ComfyUI IPAdapter Tile

- 6.1. ComfyUI IPAdapter Plus para transferencia de estilo

- 6.2. ComfyUI IPAdapter Plus para mantener la composición

- 6.3. ComfyUI IPAdapter Plus para mantener la composición y transferencia de estilo

🌟🌟🌟 ComfyUI Online - Experimenta el flujo de trabajo IPAdapter Plus ahora 🌟🌟🌟#

Si estás interesado en explorar el flujo de trabajo de ComfyUI IPAdapter Plus (IPAdapter V2), utiliza el siguiente ComfyUI web. Viene completamente equipado con todos los nodos y modelos esenciales del cliente, permitiendo una creatividad sin problemas sin necesidad de configuraciones manuales. Comienza a obtener experiencia práctica de inmediato, o continúa con este tutorial para aprender a usar IPAdapter Plus de manera efectiva.

Para flujos de trabajo más avanzados y premium de ComfyUI, visita nuestra 🌟Lista de flujos de trabajo de ComfyUI🌟#

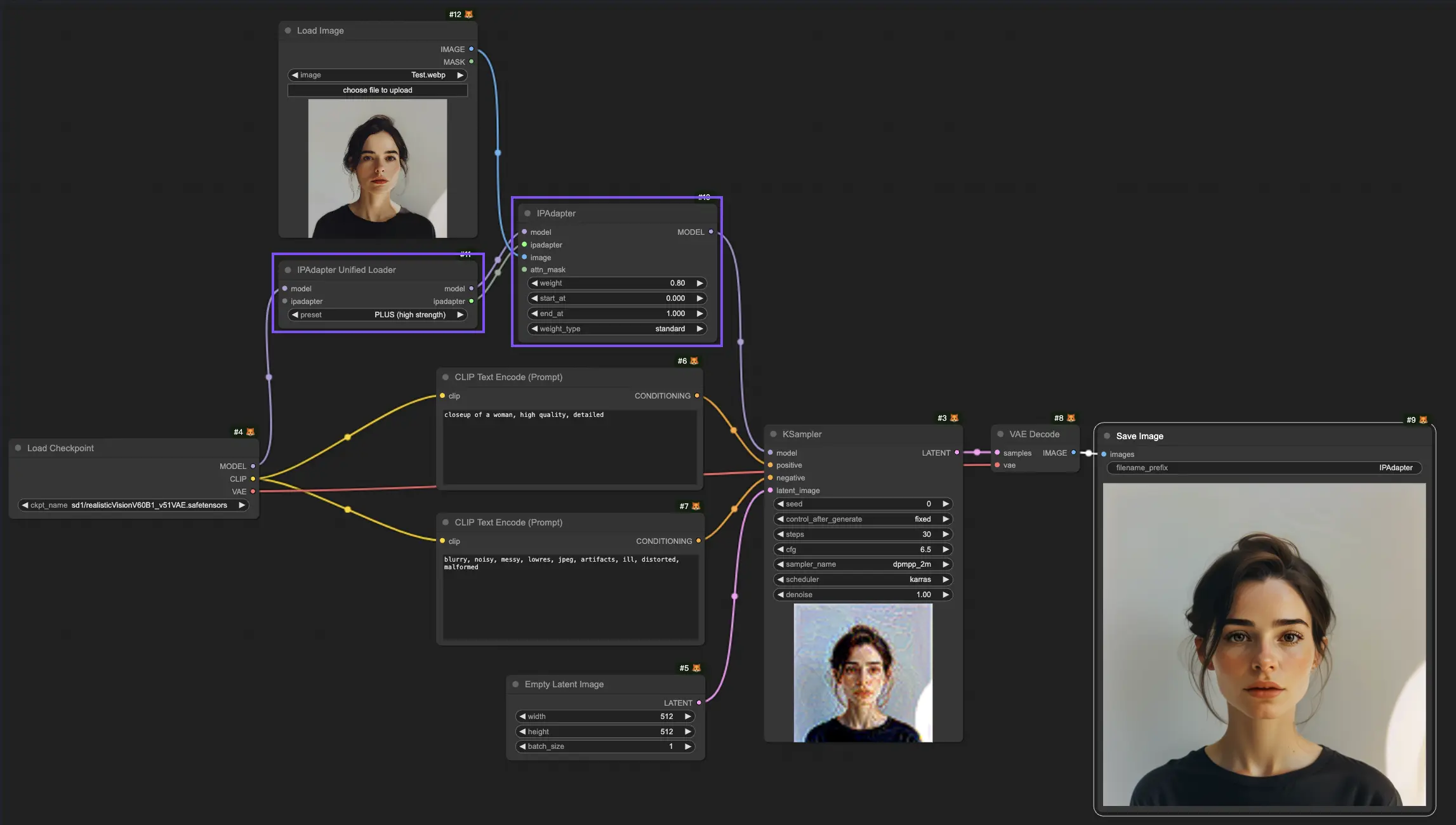

1. ComfyUI IPAdapter Plus - Nodo IPAdapter Basic#

1.1. El flujo de trabajo más simple de ComfyUI IPAdapter#

1.2. Entradas del nodo "IPAdapter" de ComfyUI#

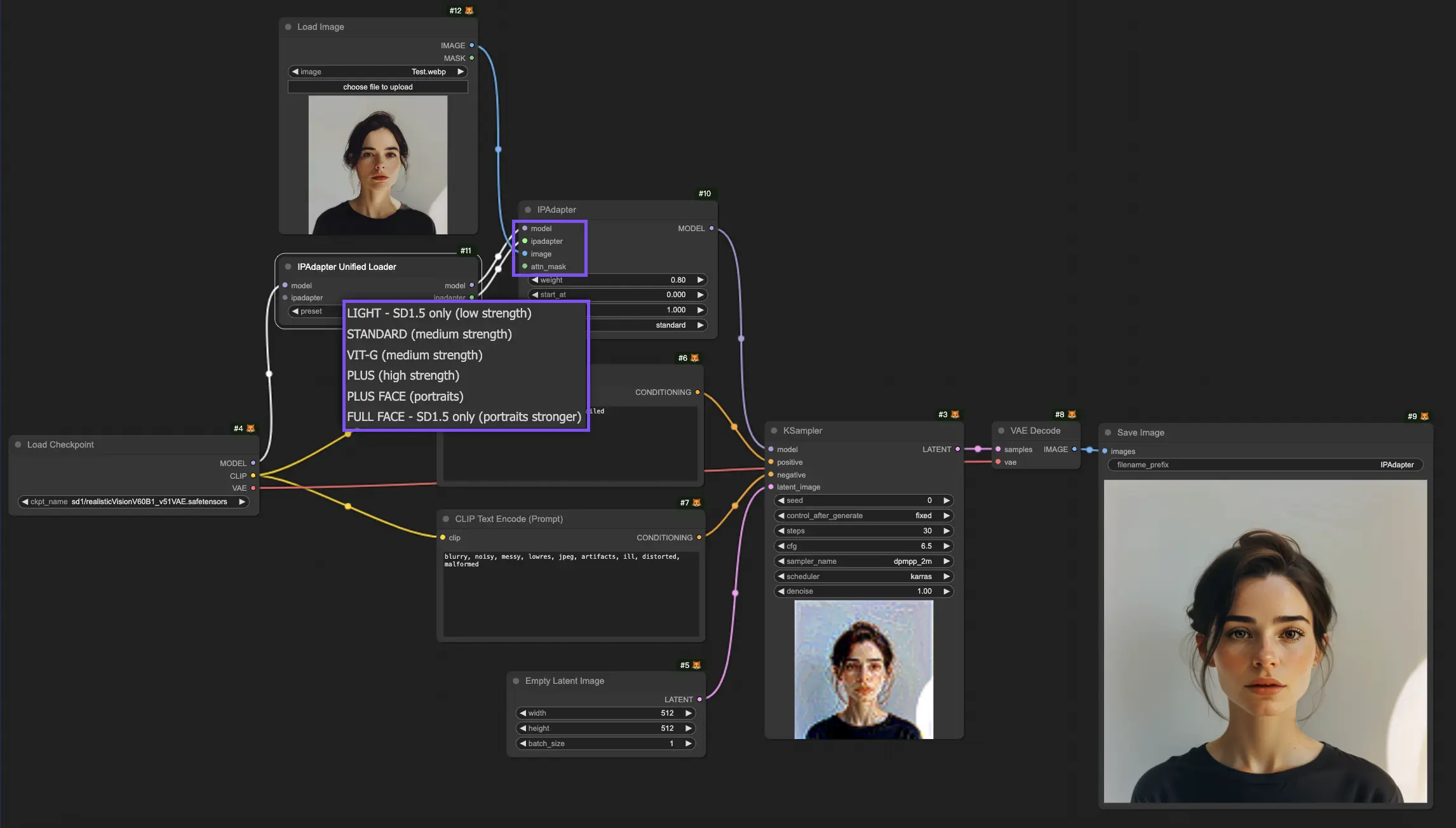

1.2.1. Entradas del nodo "IPAdapter": Model e IPAdapter#

Las entradas "Model" e "IPAdapter" del nodo "IPAdapter" están conectadas a la salida del nodo "IPAdapter Unified Loader". Aquí, puedes seleccionar entre varios modelos IPAdapter, cada uno adaptado a diferentes requisitos:

- Light - SD1.5 Only (baja intensidad): Este modelo es ideal para ajustes mínimos y es exclusivamente compatible con el modelo SD1.5.

- Standard (intensidad media): Este modelo logra modificaciones de intensidad media, adecuado para una amplia gama de aplicaciones, equilibrando alteraciones sutiles y notables.

- VIT-G (intensidad media): Si bien ofrece ajustes medios como el Standard, el modelo VIT-G está adaptado para datos de imágenes más intrincados o variados, potencialmente mejorando el rendimiento en escenarios específicos.

- PLUS (alta intensidad): Para aquellos que requieren modificaciones sustanciales, el modelo PLUS ofrece poderosas capacidades creativas, permitiendo alteraciones significativas.

- PLUS FACE (retratos): Diseñado específicamente para mejorar retratos, PLUS FACE se enfoca en mejorar las características faciales, ideal para fotografía de retratos y obras de arte.

- Full FACE - SD1.5 Only (retratos más fuertes): Una versión más intensa de PLUS FACE, el modelo Full FACE está diseñado para transformaciones dramáticas en retratos, pero solo es compatible con el modelo SD1.5.

1.2.2. Entradas del nodo "IPAdapter": Image#

La entrada "Image" del nodo "IPAdapter" es la imagen de referencia utilizada para el condicionamiento de imagen a imagen. Aquí es donde el nodo "IPAdapter" aplica sus capacidades transformadoras, alterando la imagen de referencia basándose en los parámetros definidos y las funcionalidades del modelo. A través de este proceso, se generan nuevas imágenes, heredando atributos de la imagen de referencia y combinándolos con el potencial creativo del modelo IPAdapter.

1.2.3. Entradas del nodo "IPAdapter": Attn Mask (Máscara de atención)#

Con la "Attn Mask", puedes resaltar áreas específicas de la imagen para un procesamiento enfocado o para guiar la atención del modelo, mejorando o preservando ciertas características de la imagen mientras diriges el enfoque del modelo.

1.3. Parámetros en el nodo "IPAdapter" de ComfyUI#

1.3.1. Parámetros en el nodo "IPAdapter": Weight#

El parámetro "Weight" ajusta la intensidad de las modificaciones aplicadas; valores más altos conducen a efectos más pronunciados, mientras que valores más bajos resultan en cambios más sutiles.

1.3.2. Parámetros en el nodo "IPAdapter": Start At y End At#

Los parámetros "Start At" y "End At" dictan los pasos inicial y final en los que se aplican los efectos de IPAdapter, ofreciendo control sobre el procesamiento.

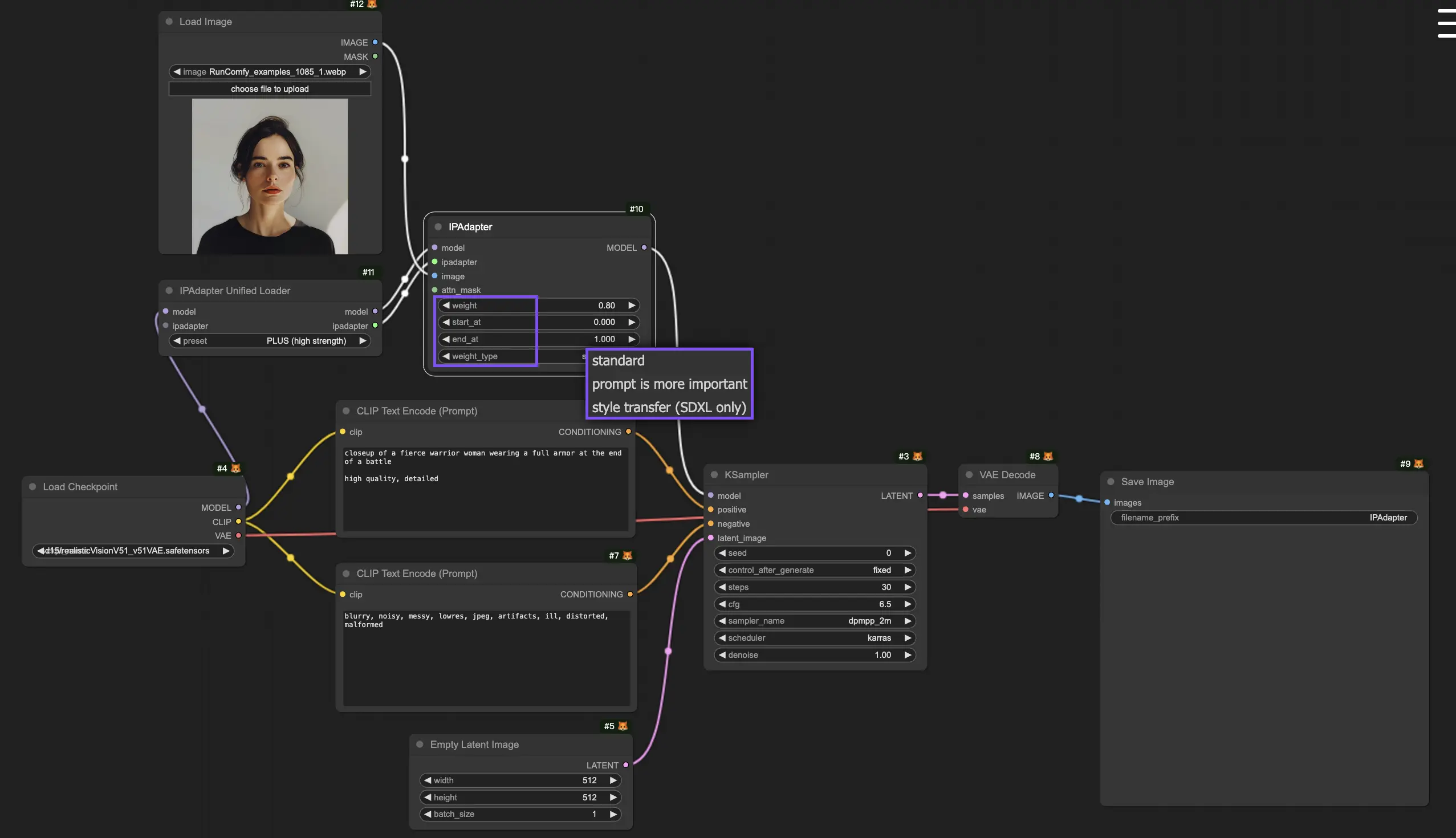

1.3.3. Parámetros en el nodo "IPAdapter": Weight Type#

El "Weight Type" para aplicar peso a través de las etapas de procesamiento varía, cada uno afectando la salida de una manera distintiva:

- Standard

- Prompt is more important

- Style Transfer (SDXL only)

1.4. La diferencia en el uso de ComfyUI IPAdapter Plus con los modelos de checkpoint SD1.5 y SDXL#

Al trabajar con modelos SDXL, el modelo IPAdapter Plus se integra a la perfección y se adapta automáticamente a las características del modelo SDXL. Sin embargo, es esencial ajustar adecuadamente el tamaño latente para alinearlo con los requisitos del modelo SDXL.

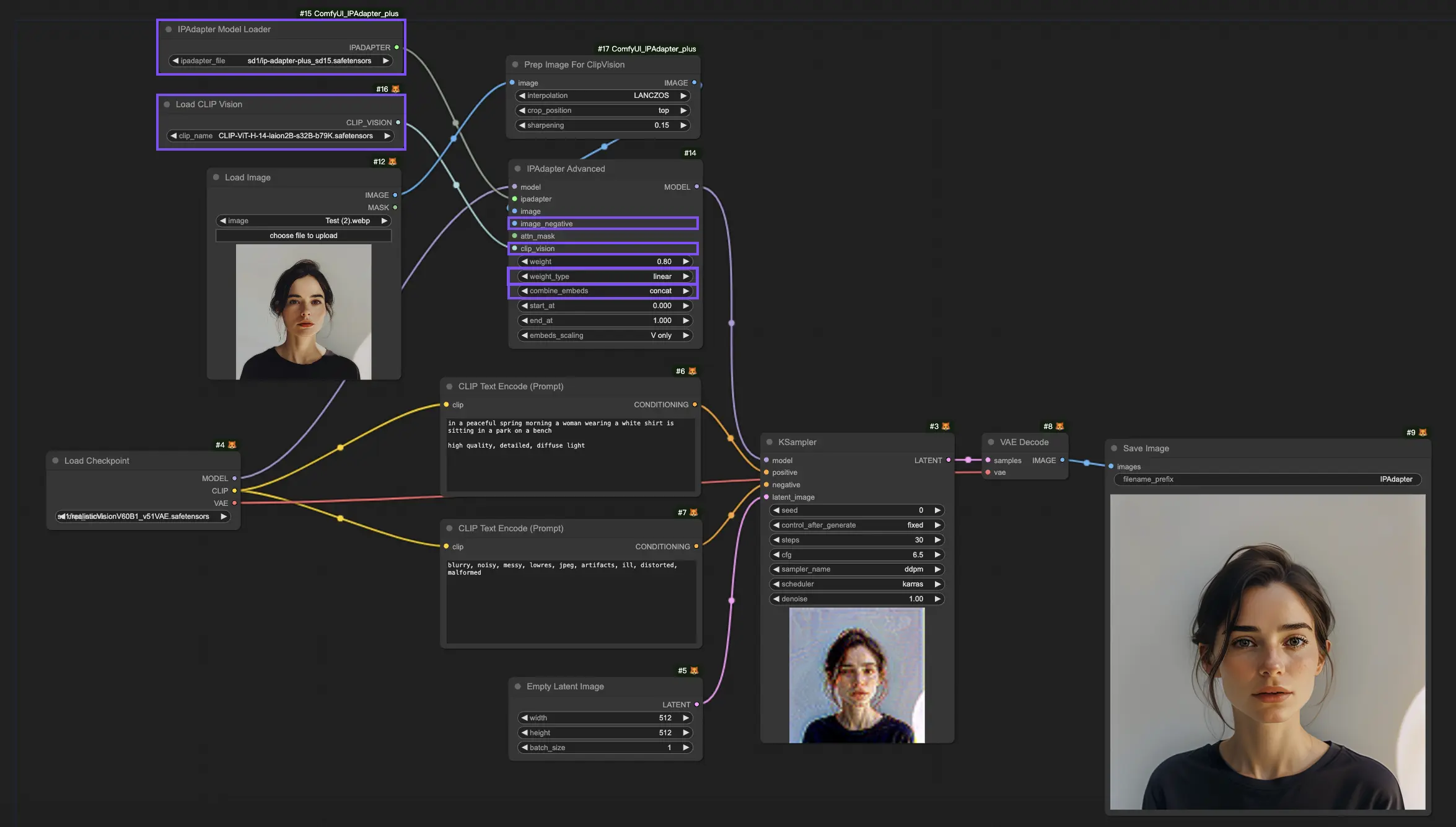

2. ComfyUI IPAdapter Plus - Nodo IPAdapter Advanced#

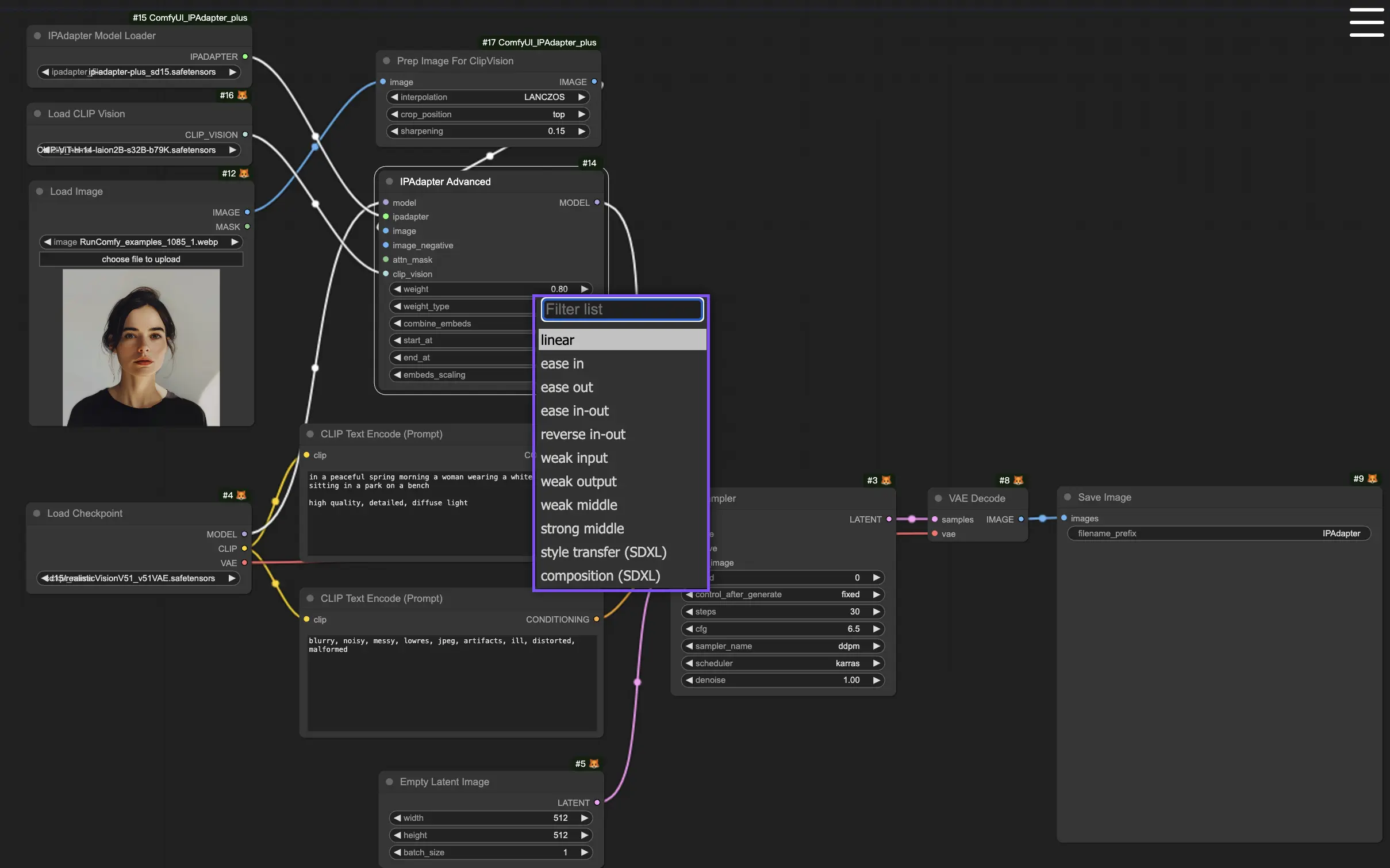

2.1. El flujo de trabajo avanzado de ComfyUI IPAdapter#

Ofreciendo un conjunto más completo de características, el nodo ComfyUI IPAdapter Advanced mejora el control sobre el proceso de generación a través de parámetros como "Image Negative", "CLIP Vision", "Combine Embeds" y más opciones de "Weight Type", alineando las imágenes más cerca de tu visión creativa.

2.2. Parámetros expandidos en el nodo "IPAdapter Advanced" de ComfyUI#

2.2.1. Parámetros expandidos en el nodo "IPAdapter Advanced": Image Negative#

El parámetro "Image Negative" te permite definir lo que no quieres que aparezca en la imagen final. Al especificar ejemplos negativos, se guía al modelo para alejarse de elementos no deseados, dirigiéndose hacia un resultado más deseable. Esta característica es fundamental para evitar temas, objetos o patrones específicos en la imagen generada, asegurando que la salida se adhiera a tus preferencias.

2.2.2. Parámetros expandidos en el nodo "IPAdapter Advanced": CLIP Vision#

En el nodo "IPAdapter Advanced", encontrarás la entrada "CLIP Vision". Esta se conecta a la salida del nodo "Load CLIP Vision", donde puedes seleccionar entre diferentes modelos CLIP-ViT.

- CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors: Esta variante del modelo es parte de la familia CLIP (Contrastive Language–Image Pre-training), específicamente diseñada para entender e interpretar contenido visual en relación a información textual. Está entrenada en un gran conjunto de datos (laion2B), con un tamaño de modelo de 32 mil millones de parámetros (s32B), y ha sido optimizada para equilibrar rendimiento y seguridad en la generación de contenido (b79K indica un benchmark o versión específica). Este modelo es experto en manejar una amplia gama de tareas de reconocimiento visual, haciéndolo adecuado para generar imágenes de alta calidad y contextualmente precisas.

- CLIP-ViT-bigG-14-laion2B-39B-b160k.safetensors: Similar a su contraparte, este modelo también está entrenado en el conjunto de datos laion2B pero cuenta con un tamaño mayor de 39 mil millones de parámetros, lo que lo hace capaz de entender relaciones aún más matizadas entre texto e imágenes. El "bigG" posiblemente denota una versión más grande o avanzada dentro de la serie CLIP-ViT, con "b160k" significando su benchmark o versión. Este modelo sobresale en crear imágenes detalladas y complejas que se alinean estrechamente con descripciones textuales, adecuado para aplicaciones que requieren alta fidelidad y comprensión semántica profunda.

La principal diferencia entre CLIP-ViT-H-14-laion2B-s32B-b79K.safetensors y CLIP-ViT-bigG-14-laion2B-39B-b160k.safetensors radica en su tamaño y manejo potencial de complejidad, siendo el último más grande con 39 mil millones de parámetros, sugiriendo que puede interpretar relaciones texto-imagen más matizadas que los 32 mil millones de parámetros del primero.

2.2.3. Parámetros expandidos en el nodo "IPAdapter Advanced": Weight Type#

En comparación con el nodo "IPAdapter", el nodo "IPAdapter Advanced" abre más opciones para "weight type", cada una afectando la salida de una manera distintiva:

- Linear: Aplica peso uniformemente desde el inicio hasta el final del pipeline de procesamiento, asegurando una influencia consistente en todo momento sin modulación en intensidad.

- Ease In: Aumenta gradualmente el peso desde el principio, permitiendo una introducción suave del efecto a medida que avanza por el pipeline.

- Ease Out: Inicia con una fuerte influencia que disminuye gradualmente, efectivamente reduciendo el efecto hacia el final del procesamiento.

- Ease In-Out: Una combinación de los efectos "Ease In" y "Ease Out"; comienza y termina con una influencia más suave, alcanzando su punto máximo en el medio para un impacto máximo.

- Weak Input: Reduce específicamente la influencia del efecto al inicio de la cadena de procesamiento, haciendo que los elementos iniciales sean menos pronunciados.

- Weak Output: Disminuye la influencia hacia el final de la cadena de procesamiento, suavizando los aspectos finales de la imagen.

- Weak Middle: Minimiza la influencia del efecto en el punto medio de la cadena de procesamiento, a menudo para mantener la claridad o el enfoque en los aspectos inicial y final.

- Strong Middle: Amplifica el efecto en la parte central de la cadena de procesamiento, intensificando el impacto en los elementos centrales de la imagen.

- Style Transfer (SDXL): Diseñado exclusivamente para modelos SDXL, esta opción se enfoca en adaptar el estilo de la imagen de referencia a la imagen objetivo, aprovechando las capacidades de SDXL para una transformación estilística matizada.

- Composition (SDXL): Adaptado para modelos SDXL, su objetivo es fusionar los elementos compositivos de las imágenes de referencia y objetivo, enfatizando la disposición e interacción de los elementos dentro del espacio.

2.2.4. Parámetros expandidos en el nodo "IPAdapter Advanced": Combine Embeds#

La característica "Combine Embeds" es esencial para aquellos que buscan fusionar entradas de múltiples fuentes en una única salida visual coherente. Al utilizar "Combine Embeds", tienes la flexibilidad de crear imágenes que incorporen una amplia gama de influencias e inspiraciones artísticas, resultando en creaciones verdaderamente personalizadas e innovadoras. Los métodos proporcionados para combinar embeds, como Concat, Add, Subtract, Average y Norm Average, ofrecen diversos enfoques para fusionar estas influencias. Estos se explorarán en detalle en la Sección 4, "Característica de combinación de imágenes de ComfyUI IPAdapter".

3. ComfyUI IPAdapter Plus - FaceID#

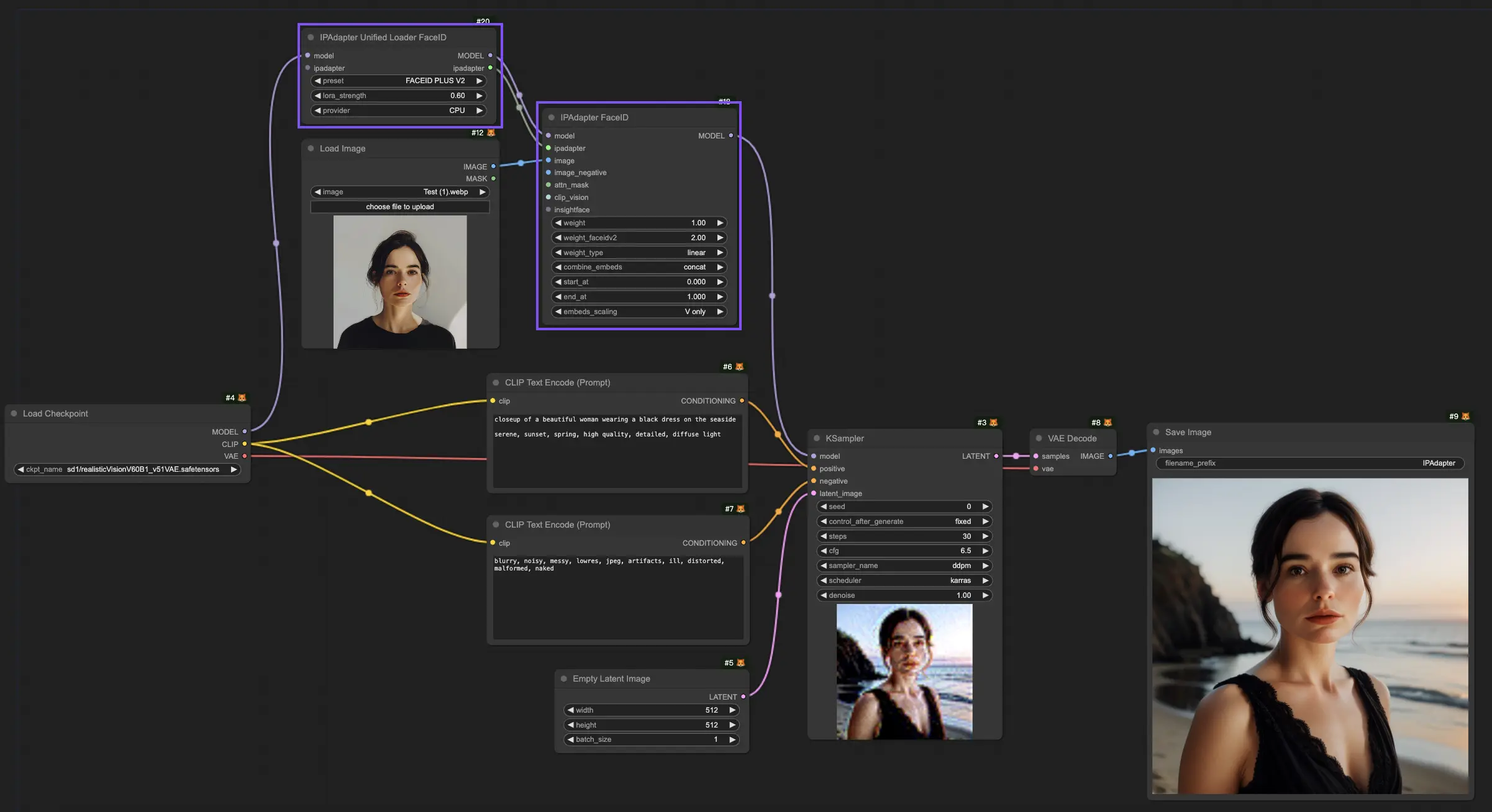

En la configuración mencionada anteriormente, es posible que hayas notado la ausencia del modelo FaceID. Para integrar el modelo Face ID en tu flujo de trabajo, se requieren dos nodos específicos: el nodo "IPAdapter Unified Loader FaceID" y el nodo "IPAdapter FaceID".

3.1. Flujo de trabajo de ComfyUI IPAdapter FaceID#

Al trabajar dentro del nodo "IPAdapter Unified Loader FaceID", puedes seleccionar el último "Face ID Plus V2" en el menú desplegable de modelos disponibles. Esta acción instruye al cargador para que recopile y prepare automáticamente todas las dependencias únicas del modelo Face ID Plus V2.

Opta por la CPU como proveedor. A pesar de la posible disponibilidad de una GPU de alto rendimiento, es recomendable configurar el modelo Face ID para que utilice la CPU como su proveedor. Esta recomendación se deriva del beneficio de preservar la valiosa memoria de video (VRAM), una estrategia que resulta ventajosa y ayuda a optimizar la eficiencia y efectividad general de la asignación de recursos de tu proyecto.

4. ComfyUI IPAdapter Plus - Característica de combinación de imágenes#

¿Cómo usar múltiples imágenes de referencia para generar una nueva? Aquí hay dos métodos para lograrlo con ComfyUI IPAdapter Plus, brindándote la flexibilidad y el control necesarios para la generación creativa de imágenes.

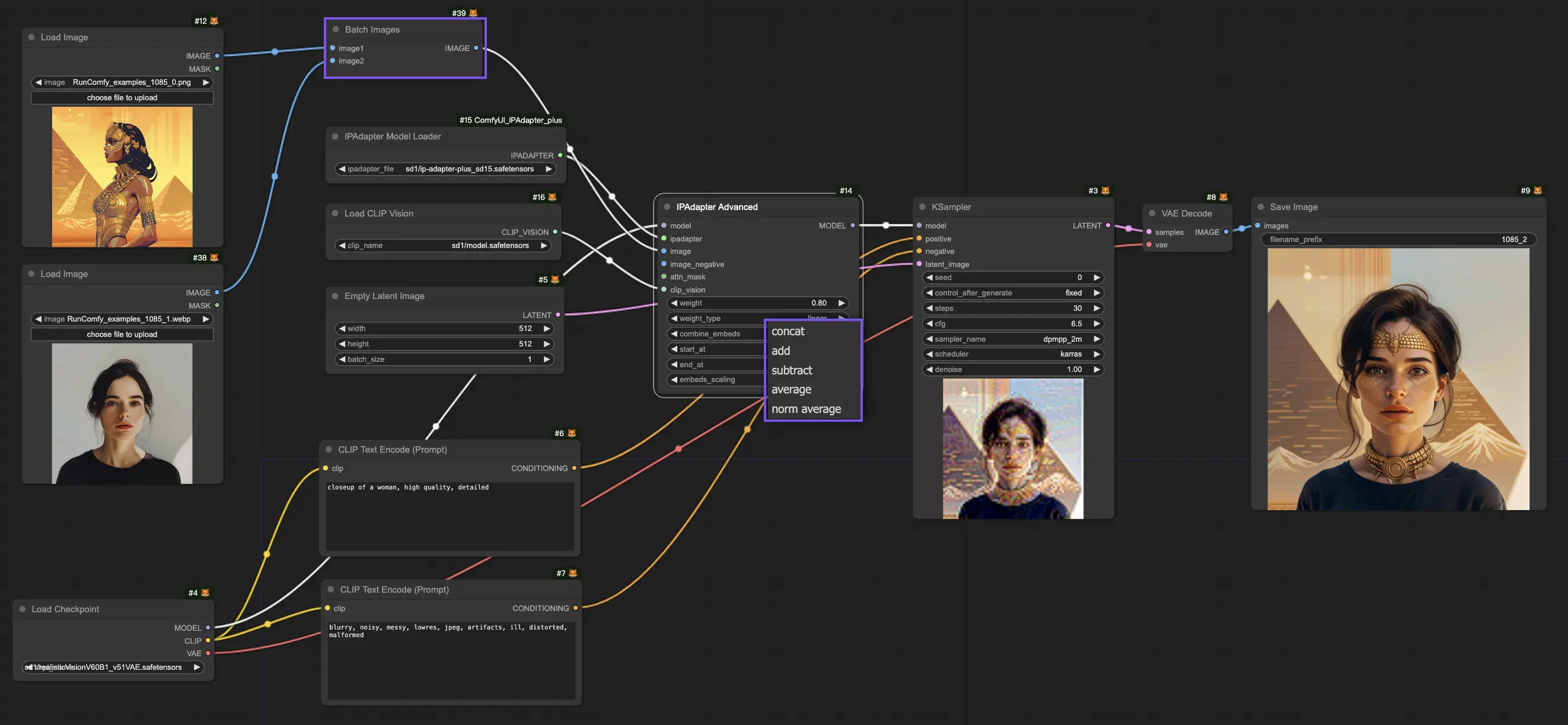

4.1. Método 1: Utilizando el nodo "Batch Image" de ComfyUI#

Para comenzar con el nodo "Batch Image", primero debes seleccionar las imágenes que deseas combinar. Estas imágenes se ingresan en el nodo, creando un lote unificado. Este lote se introduce posteriormente en el pipeline de IPAdapter, aplicando cada imagen secuencialmente al proceso generativo.

El nodo "IPAdapter Advanced" introduce las opciones de "Combine Embeds", otorgándote un control sofisticado sobre cómo múltiples imágenes influyen en la generación. Estas opciones—Concat, Add, Subtract, Average y Norm Average—dictan cómo se fusionan los embeddings de diferentes imágenes, cada una conduciendo a resultados únicos:

- Concat: Esta opción concatena los embeddings de cada imagen, efectivamente preservando y combinando la información de todas las imágenes de entrada en un único formato extendido. Este enfoque es beneficioso para incorporar un amplio espectro de características de cada imagen, pero puede conducir a complejidad debido a la mayor cantidad de información que se procesa.

- Add: Sumando los embeddings de las imágenes, el método "Add" sinergiza sus influencias, realzando los rasgos que son comunes entre las imágenes. Esto puede ser particularmente útil para enfatizar características o temas compartidos, potencialmente conduciendo a una salida más unificada y coherente.

- Subtract: Contrario a sumar, el método "Subtract" diferencia los embeddings restándolos, resaltando los aspectos únicos de cada imagen. Este enfoque permite la exploración creativa de contrastes y puede ser usado para disminuir ciertos elementos presentes en las imágenes de referencia, ofreciendo una nueva vía para la expresión artística.

- Average: Al promediar los embeddings, este método logra una amalgama equilibrada de las características de las imágenes, asegurando que la influencia de cualquier imagen individual no sea demasiado dominante. Esta técnica es ideal para lograr una integración armoniosa de múltiples imágenes, proporcionando una salida cohesiva que representa equitativamente las imágenes de entrada.

- Norm Average (Promedio normalizado): Esta opción ajusta la influencia de cada imagen basándose en su peso relativo dentro del lote, permitiendo un control preciso sobre cómo cada imagen de referencia contribuye a la composición final. Permite el ajuste fino de la apariencia de la imagen generada, asegurando que el resultado final se alinee estrechamente con la visión del usuario.

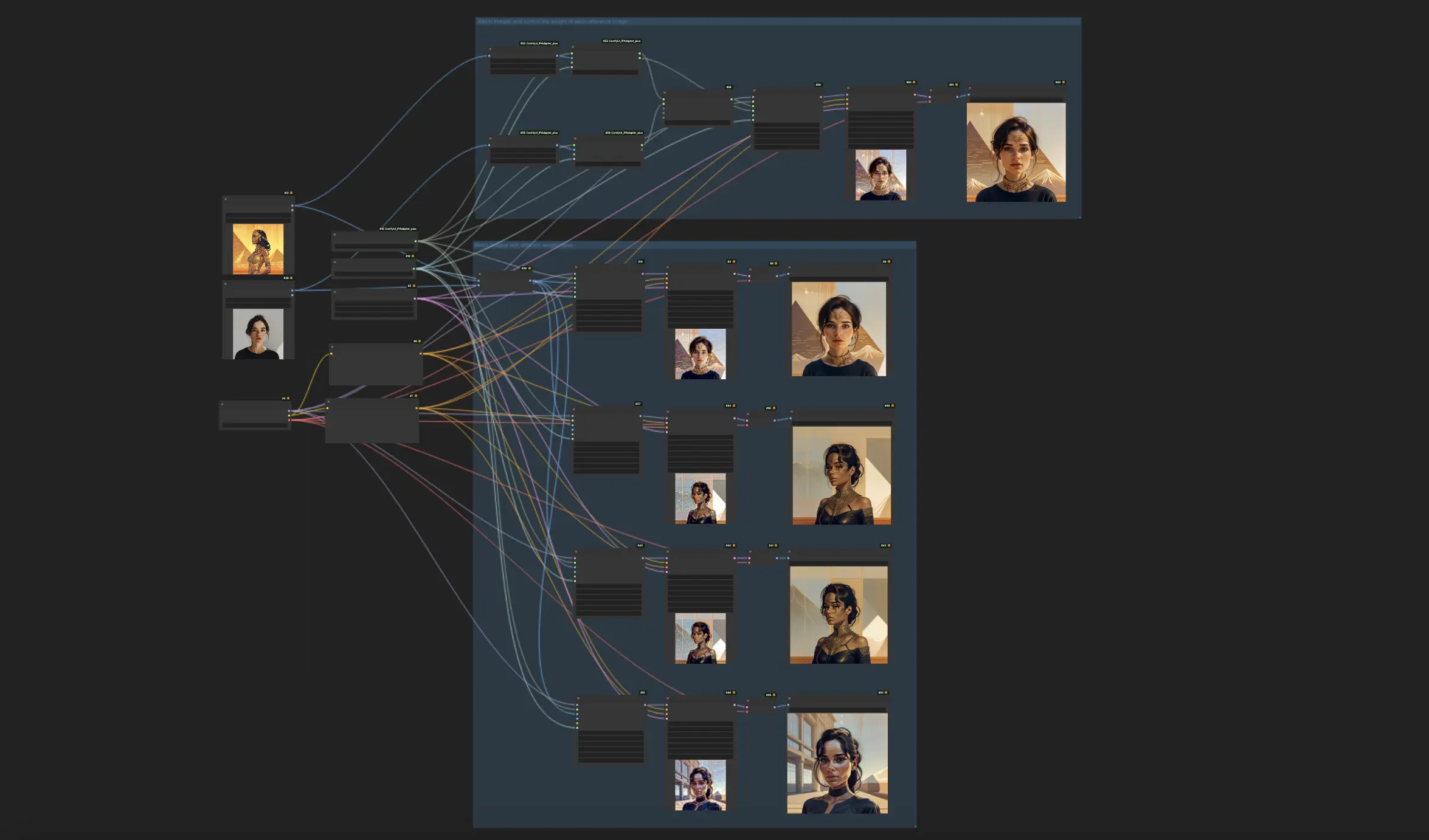

En la siguiente imagen, al usar diferentes "Combine Embeds", obtendrás diferentes resultados.

4.2. Método 2: Control preciso sobre los pesos de referencia utilizando el nodo "IPAdapter Encoder" de ComfyUI#

Para aquellos que buscan un control más fino sobre cómo las imágenes de referencia son ponderadas en la imagen final, IPAdapter proporciona una solución mediante el uso de nodos "IPAdapter Encoder" y un nodo "IPAdapter Combine Embeds".

4.2.1. Utilizando nodos "IPAdapter Encoder"#

Cada imagen en el proceso de combinación se procesa a través de un nodo codificador IPAdapter, que codifica las imágenes para compatibilidad con IPAdapter. Dentro de los nodos "IPAdapter Encoder", los usuarios pueden asignar pesos específicos a cada imagen, dictando su influencia en la salida combinada. Ajustar estos pesos permite un control matizado sobre el dominio o la sutileza de cada imagen en la composición.

4.2.2. Combinando con el nodo "IPAdapter Combine Embeds"#

Después de codificar las imágenes y establecer sus pesos, el nodo "IPAdapter Combine Embeds" fusiona sus representaciones codificadas. Combina los embeds positivos de los nodos codificadores, reflejando la influencia prevista de cada imagen en la salida combinada. Este embedding equilibrado está entonces listo para la síntesis.

4.2.3. Conexión al nodo "IPAdapter"#

El embedding sintetizado finalmente se procesa por el IP Adapter para producir la nueva imagen. Aunque conectar embeds negativos es opcional, hacerlo es recomendado para conservar recursos computacionales. Al seleccionar cualquiera de los dos embeds negativos de los nodos codificadores y vincularlo al nodo IPAdapter, el proceso se optimiza, minimizando cálculos innecesarios y agilizando el proceso de combinación.

¡Al seguir estos métodos, puedes combinar efectivamente múltiples imágenes para generar nuevas composiciones creativas, aprovechando al máximo las capacidades de ComfyUI IPAdapter Plus!

5. ComfyUI IPAdapter Plus - IPAdapter Tile para imágenes altas#

Al procesar imágenes altas, podrías encontrar un desafío único: el codificador CLIP Vision, un componente central del framework IPAdapter, prefiere inherentemente imágenes cuadradas. Esta preferencia puede llevar a problemas de recorte cuando se conecta directamente una imagen alta a un nodo IPAdapter, típicamente resultando en que solo la porción central de la imagen influya en la salida. En consecuencia, las secciones superior e inferior de tu imagen podrían ser ignoradas, afectando la calidad general del contenido generado.

Para abordar este problema, el nodo "IPAdapter Tiled" ofrece una solución a medida. Permite la conexión directa de imágenes altas al segmentar la imagen en mosaicos más pequeños y manejables. Este método asegura que cada parte de tu imagen de referencia se tenga en cuenta durante el proceso de generación, evitando el problema del descuido parcial de la imagen.

5.1 Flujo de trabajo de ComfyUI IPAdapter Tile#

Una característica adicional del nodo "IPAdapter Tiled" es la salida de mosaicos y máscaras, que proporciona una representación visual de cómo se procesa tu imagen. Esta característica muestra los mosaicos específicos utilizados y sus máscaras correspondientes, ofreciéndote una visión del funcionamiento interno del proceso generativo. Comprender cómo se segmenta y procesa tu imagen puede ayudarte a realizar ajustes informados para lograr tus resultados deseados.

Además, el nodo "IPAdapter Tiled" permite ajustes de máscara personalizados, ofreciendo flexibilidad para resaltar o concentrarse en secciones particulares de tu imagen. Al adaptar estas máscaras, puedes dirigir más atención a elementos específicos de tu imagen alta, otorgando un control mejorado sobre el resultado. Esta característica resulta invaluable para enfatizar o minimizar ciertos aspectos dentro de tu imagen, asegurando que el contenido generado se alinee precisamente con tu visión.

Por lo tanto, la incorporación del nodo "IPAdapter Tiled" en ComfyUI IPAdapter Plus mejora notablemente tu capacidad para manejar proyectos de condicionamiento de imagen a imagen que involucran imágenes altas.

6. ComfyUI IPAdapter Plus - Estilo y composición#

Cómo usar ComfyUI IPAdapter Plus para manipular y combinar los estilos y composiciones de imágenes de referencia para crear nuevos y cautivadores elementos visuales. ComfyUI IPAdapter Plus ofrece un potente conjunto de herramientas para que artistas y diseñadores experimenten, incluyendo la capacidad de transferir el estilo de una imagen, mantener la composición de otra, o incluso fusionar tanto el estilo como la composición de diferentes referencias en una sola imagen.

6.1. ComfyUI IPAdapter Plus para transferencia de estilo#

Para transferir el estilo de una imagen de referencia, como un LoRA de 1 imagen, a tu contenido objetivo utilizando el nodo ComfyUI IPAdapter Advanced, sigue estos pasos:

Configurar el nodo "IPAdapter Advanced": Comienza incorporando un nodo "IPAdapter Advanced" en tu flujo de trabajo.

Configurar el nodo: Dentro de la configuración del nodo ComfyUI IPAdapter Advanced, ubica la opción "Weight Type". Usa el menú desplegable para seleccionar "Style Transfer (SDXL)". Esta configuración dirige al adaptador a priorizar la transferencia del estilo visual de tu imagen de referencia al objetivo.

Ajustar el "Weight" de transferencia de estilo: La configuración "weight" determina la fuerza de la transferencia de estilo. Aumentar este valor amplifica la influencia del estilo de referencia en tu imagen objetivo, haciendo el efecto más distinto.

6.2. ComfyUI IPAdapter Plus para mantener la composición#

Para retener la composición de una imagen de referencia mientras generas una nueva, también usarás el nodo ComfyUI IPAdapter Advanced pero con una configuración diferente:

Configurar el nodo "IPAdapter Advanced": Como antes, agrega un nodo IPAdapter Advanced a tu flujo de trabajo.

Configurar el nodo: Elige "Composition (SDXL)" en el menú desplegable "Weight Type". Esto instruye al adaptador a mantener los elementos compositivos de la imagen de referencia en la nueva generación.

Ajustar el "Weight" de composición: Modifica la configuración "weight" para influir en qué tan estrechamente la nueva imagen se adhiere a la composición de la referencia. Un peso mayor hará que se aplique más estrictamente la composición de la referencia.

6.3. ComfyUI IPAdapter Plus para mantener la composición y transferencia de estilo#

Para proyectos que requieren tanto el estilo de una imagen como la composición de otra para ser transferidos, el nodo "IPAdapter style & composition SDXL" ofrece una solución optimizada:

Elegir el nodo "IPAdapter Style & Composition SDXL": Agrega este nodo especializado a tu proyecto para manejar simultáneamente transferencias de estilo y composición.

Cargar referencias de estilo y composición: El nodo "IPAdapter Style & Composition SDXL" permite dos entradas, una para la imagen cuyo estilo quieres transferir y otra para la imagen cuya composición deseas retener. Carga ambas referencias en consecuencia.

Configurar "Weights" tanto para estilo como para composición: El nodo "IPAdapter Style & Composition SDXL" proporciona configuraciones de peso separadas para estilo y composición. Ajusta estos pesos para equilibrar la influencia de cada referencia en la imagen final. Establecer un peso mayor para estilo o composición priorizará ese aspecto en la imagen generada.

Al seguir estos pasos y experimentar con las configuraciones, puedes aprovechar ComfyUI IPAdapter Plus para crear imágenes visualmente impresionantes que fusionen lo mejor de ambos mundos: el estilo distintivo de una obra de arte con la composición reflexiva de otra.

🌟🌟🌟 ComfyUI Online - Experimenta el flujo de trabajo IPAdapter Plus ahora 🌟🌟🌟#

Si estás interesado en explorar el flujo de trabajo de ComfyUI IPAdapter Plus (IPAdapter V2), utiliza el siguiente ComfyUI web. Viene completamente equipado con todos los nodos y modelos esenciales del cliente, permitiendo una creatividad sin problemas sin necesidad de configuraciones manuales. ¡Comienza a obtener experiencia práctica de inmediato!