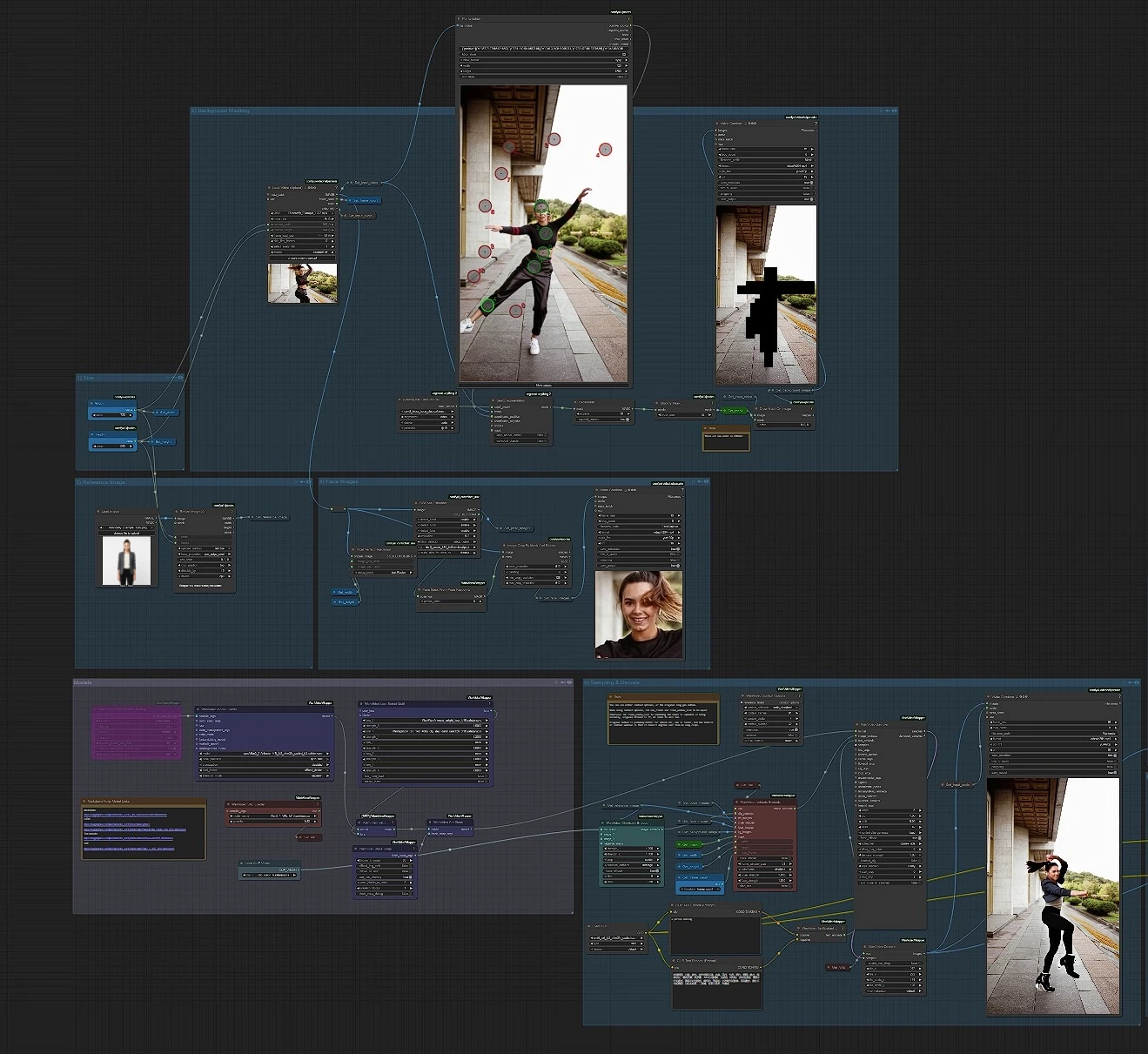

Wan2.2 Animate: Vollbewegungs-Referenz-zu-Video-Animation in ComfyUI#

Wan2.2 Animate verwandelt ein einzelnes Referenzbild in eine lebensechte Darbietung, die den Vollkörperbewegungen und Gesichtsausdrücken eines Treibervideos folgt. Dieser ComfyUI Wan2.2 Animate-Workflow verbindet Haltungsübertragung, Gesichtsmocap, Hintergrundkontrolle und LoRA-Add-ons, sodass sich Charaktere natürlich bewegen, während die Identität erhalten bleibt.

Entwickelt für Avatare, Aufführungs-Rekreationen, Musikvideos und Story-Beats, produziert Wan2.2 Animate saubere, zeitlich stabile Clips mit optionaler Audio-Durchleitung, Qualitäts-Scaling und Interpolation. Es wird als geführtes Diagramm mit sinnvollen Standardeinstellungen geliefert, sodass Sie sich auf kreative Entscheidungen anstatt auf die Technik konzentrieren können.

Wichtige Modelle im ComfyUI Wan2.2 Animate-Workflow#

- Wan 2.2 Animate 14B (I2V) fp8 skaliert. Das Kernvideomodell, das Haltung, Gesicht, Bild und Textanleitung interpretiert, um die Bewegungsspur mit Identitätserhaltung zu synthetisieren. Model set

- Wan 2.1 VAE bf16. Das passende VAE, das verwendet wird, um Latentbilder für die Wan-Familie zu kodieren/decodieren und Farbtreue und Schärfe sicherzustellen. VAE

- UMT5-XXL Text-Encoder. Bietet robuste mehrsprachige Textkonditionierung für positive und negative Eingaben. Encoder

- CLIP ViT-H/14 Vision-Encoder. Extrahiert visuelle Einbettungen aus dem Referenzbild, um Identität und Stil zu bewahren. Paper

- Optionale Wan LoRAs. Leichte Adapter für Beleuchtungs- und I2V-Verhaltenssteuerung, wie Lightx2v I2V 14B und Relight. Lightx2v • Relight

- Segment Anything 2 (SAM 2). Hochwertige Bild-/Video-Segmentierung zur Isolierung des Subjekts oder Hintergrunds. Paper

- DWPose. Genaues 2D-Haltungsabschätzung zur Erstellung von gesichts-/haltungsbewussten Ausschnitten und Masken. Repo

- RIFE. Schnelle Videobild-Interpolation zur Erhöhung der Wiedergabeglätte. Paper

So verwenden Sie den ComfyUI Wan2.2 Animate-Workflow#

Gesamtfluss. Das Diagramm nimmt ein Treibervideo und ein einzelnes Referenzbild auf, bereitet ein sauberes Subjekt/Hintergrund und einen gesichtsbezogenen Ausschnitt vor, und speist dann Haltung, Gesicht, Bild und Texteingaben in Wan2.2 Animate zur Abtastung und Decodierung ein. Eine endgültige Phase skaliert Details hoch und interpoliert optional Bilder vor dem Export.

- Modelle

- Diese Gruppe lädt die Wan2.2 Animate-Basis, das passende VAE, Text-/Vision-Encoder und alle ausgewählten LoRAs. Der

WanVideoModelLoader(#22) undWanVideoSetLoRAs(#48) verdrahten das Modell und die Adapter, währendWanVideoVAELoader(#38) undCLIPLoader(#175) VAE und Textgerüste bereitstellen. - Wenn Sie planen, LoRAs anzupassen (z.B. Relight oder I2V-Stil), halten Sie nur ein oder zwei gleichzeitig aktiv, um Konflikte zu vermeiden, und testen Sie mit den bereitgestellten Collage-Knoten.

- Diese Gruppe lädt die Wan2.2 Animate-Basis, das passende VAE, Text-/Vision-Encoder und alle ausgewählten LoRAs. Der

Größe

- Setzen Sie Ihre Ziel-

widthundheightin der Größen-Gruppe und bestätigen Sie, dass derframe_countmit den Bildern übereinstimmt, die Sie aus dem Treibervideo laden möchten.VHS_LoadVideo(#63) meldet die Anzahl; halten Sie dienum_framesdes Samplers konsistent, um einen Beschnitt am Ende zu vermeiden. - Der

PixelPerfectResolution(#152) Helfer liest den Treiberclip, um stabile Generierungsgrößen vorzuschlagen.

Hintergrundmaskierung

- Laden Sie Ihr Treibervideo in

VHS_LoadVideo(#63); Audio wird automatisch für die spätere Durchleitung extrahiert. Verwenden SiePointsEditor(#107), um ein paar positive Punkte auf das Subjekt zu setzen, und führen SieSam2Segmentation(#104) aus, um eine saubere Maske zu erzeugen. GrowMask(#100) undBlockifyMask(#108) stabilisieren und erweitern die Kanten, undDrawMaskOnImage(#99) bietet einen schnellen Überprüfungstest. Diese Maske lässt Wan2.2 Animate sich auf den Darsteller konzentrieren und respektiert dabei den ursprünglichen Hintergrund.

Referenzbild

- Fügen Sie ein einzelnes, gut beleuchtetes Porträt oder Ganzkörperbild ein.

ImageResizeKJv2(#64) passt es an Ihre Arbeitsauflösung an, und das Ergebnis wird für die Animationsphase gespeichert. - Für die beste Identitätsbewahrung wählen Sie ein Referenzbild mit einem klaren Gesicht und minimalen Verdeckungen.

Gesichtsbilder

- Die Pipeline erstellt einen gesichtsbezogenen Ausschnitt, um Mikroausdrücke anzutreiben.

DWPreprocessor(#177) findet Haltungsschlüsselpunkte,FaceMaskFromPoseKeypoints(#120) isoliert den Gesichtsbereich, undImageCropByMaskAndResize(#96) produziert ausgerichtete Gesichtsausschnitte. Ein kleiner Vorschau-Exporter ist für eine schnelle Qualitätskontrolle enthalten (VHS_VideoCombine(#112)).

Abtastung & Decodierung

- Das Referenzbild wird über

WanVideoClipVisionEncode(#70) eingebettet, Eingaben werden mitCLIPTextEncode(#172, #182, #183) kodiert, und alles wird vonWanVideoAnimateEmbeds(#62) zusammengeführt. WanVideoSampler(#27) führt die Kern-Wan2.2 Animate-Diffusion aus. Sie können im "Kontextfenster"-Modus für sehr lange Clips arbeiten oder den ursprünglichen langen Pfad verwenden; die enthaltene Notiz erklärt, wann das Kontextfenster an die Bildanzahl angepasst werden soll, um Stabilität zu gewährleisten. Das Ergebnis des Samplers wird vonWanVideoDecode(#28) decodiert und mit optionaler Audio-Durchleitung gespeichert (VHS_VideoCombine(#30)).

Ergebnis-Collage

ImageConcatMulti(#77, #66) undGetImageSizeAndCount(#42) erstellen ein nebeneinander liegendes Panel von Referenz-, Gesichts-, Haltungs- und Ausgabe-Bildern. Verwenden Sie es, um Identitäts- und Bewegungsabgleich vor dem endgültigen Export zu überprüfen.

Upscaling und Interpolation

UltimateSDUpscaleNoUpscale(#180) verfeinert Kanten und Texturen mit dem bereitgestellten UNet (UNETLoader(#181)) und VAE (VAELoader(#184)); positive/negative Eingaben können sanft Details lenken.RIFEInterpolation(#188) verdoppelt optional die Bewegungsglätte, undVHS_VideoCombine(#189) schreibt den endgültigen Wan2.2 Animate-Clip.

Wichtige Knoten im Comfyui Wan2.2 Animate-Workflow#

VHS_LoadVideo(#63)- Rolle. Lädt das Treibervideo, gibt Bilder aus, extrahiert Audio und meldet die Bildanzahl für nachgelagerte Konsistenz.

- Tipp. Halten Sie die gemeldete Gesamtbildzahl mit der Generierungslänge des Samplers abgestimmt, um frühe Abschneidungen oder schwarze Bilder zu vermeiden.

Sam2Segmentation(#104) +PointsEditor(#107)- Rolle. Interaktive Subjektmaskierung, die hilft, dass sich Wan2.2 Animate auf den Darsteller konzentriert und Hintergrundverwicklungen vermeidet.

- Tipp. Einige gut platzierte positive Punkte plus ein bescheidenes

GrowMaskstabilisieren komplexe Hintergründe ohne Halo-Effekte. Siehe SAM 2 für video-bewusste Segmentierungsanleitungen. Paper

DWPreprocessor(#177) +FaceMaskFromPoseKeypoints(#120)- Rolle. Robuste Gesichtsmasken und ausgerichtete Ausschnitte aus erkannten Schlüsselpunkten ableiten, um Lippen-, Augen- und Kiefer-Fidelität zu verbessern.

- Tipp. Wenn Ausdrücke gedämpft aussehen, überprüfen Sie, ob die Gesichtsmaske den gesamten Kiefer- und Wangenbereich abdeckt; führen Sie den Ausschnitt nach Anpassung der Punkte erneut aus. Repo

WanVideoModelLoader(#22) undWanVideoSetLoRAs(#48)WanVideoAnimateEmbeds(#62) undWanVideoSampler(#27)- Rolle. Bild, Gesicht, Haltung und Textkonditionierung in Video-Latents verschmelzen und die Sequenz mit Wan2.2 Animate abtasten.

- Tipp. Für sehr lange Clips wechseln Sie in den Kontextfenstermodus und halten dessen Länge mit der beabsichtigten Bildanzahl synchronisiert, um zeitliche Kohärenz zu bewahren. Wrapper repo

UltimateSDUpscaleNoUpscale(#180)- Rolle. Leichter Detaildurchlauf nach dem Decodieren mit Kachelunterstützung, um den Speicher stabil zu halten.

- Tipp. Wenn Sie Kachelnahtstellen sehen, erhöhen Sie den Überlappungswert leicht und halten Sie die Eingabesteuerung sehr sanft, um Off-Model-Texturen zu vermeiden. KJNodes

RIFEInterpolation(#188)- Rolle. Glättet Bewegungen, indem Zwischenbilder eingefügt werden, ohne den Clip neu zu rendern.

- Tipp. Wenden Sie die Interpolation nach dem Upscaling an, damit der optische Fluss das endgültige Detailprofil sieht. Paper

Optionale Extras#

- Für die sauberste Identität wählen Sie ein scharfes, frontal ausgerichtetes Referenzbild und halten Sie Accessoires konsistent mit dem Treibervideo.

- Wenn Hintergrundflackern auftritt, verfeinern Sie die SAM 2-Maske und führen Sie es erneut aus; die Maskierung ist oft die schnellste Lösung für Szenenlecks.

- Halten Sie Breite und Höhe mit Ihrer Zielplattform und dem Seitenverhältnis des Eingangs ausgerichtet; quadratische Pixel, Vielfache von 16 funktionieren gut in Wan2.2 Animate.

- Audio aus dem Treibervideo kann beim Export durchgeleitet werden; wenn Sie Stille bevorzugen, deaktivieren Sie Audio im Speicherknoten.

- Beginnen Sie mit einem LoRA; wenn Sie Relight und I2V zusammen hinzufügen, testen Sie jedes separat, um ihren Einfluss zu verstehen.

Nützliche Links:

- Wan2.2 Animate Modell und Assets von Kijai: WanAnimate models, Wan 2.1 VAE, UMT5 encoder, Lightx2v

- ComfyUI Wrapper und Knoten: ComfyUI-WanVideoWrapper, ComfyUI-KJNodes

Danksagungen#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken Wan2.2 und @ArtOfficialLabs für Wan2.2 Animate Demo für ihre Beiträge und Wartung. Für autoritative Details verweisen wir auf die Originaldokumentation und -repositories, die unten verlinkt sind.

Ressourcen#

- Wan2.2/Wan2.2 Animate Demo

- Docs / Release Notes: Wan2.2 Animate Demo @ArtOfficialLabs

Hinweis: Die Nutzung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen der Autoren und Ersteller.