Workflow-Tutorial#

Wan 2.2 Animate: Charaktere austauschen & Lip-Sync#

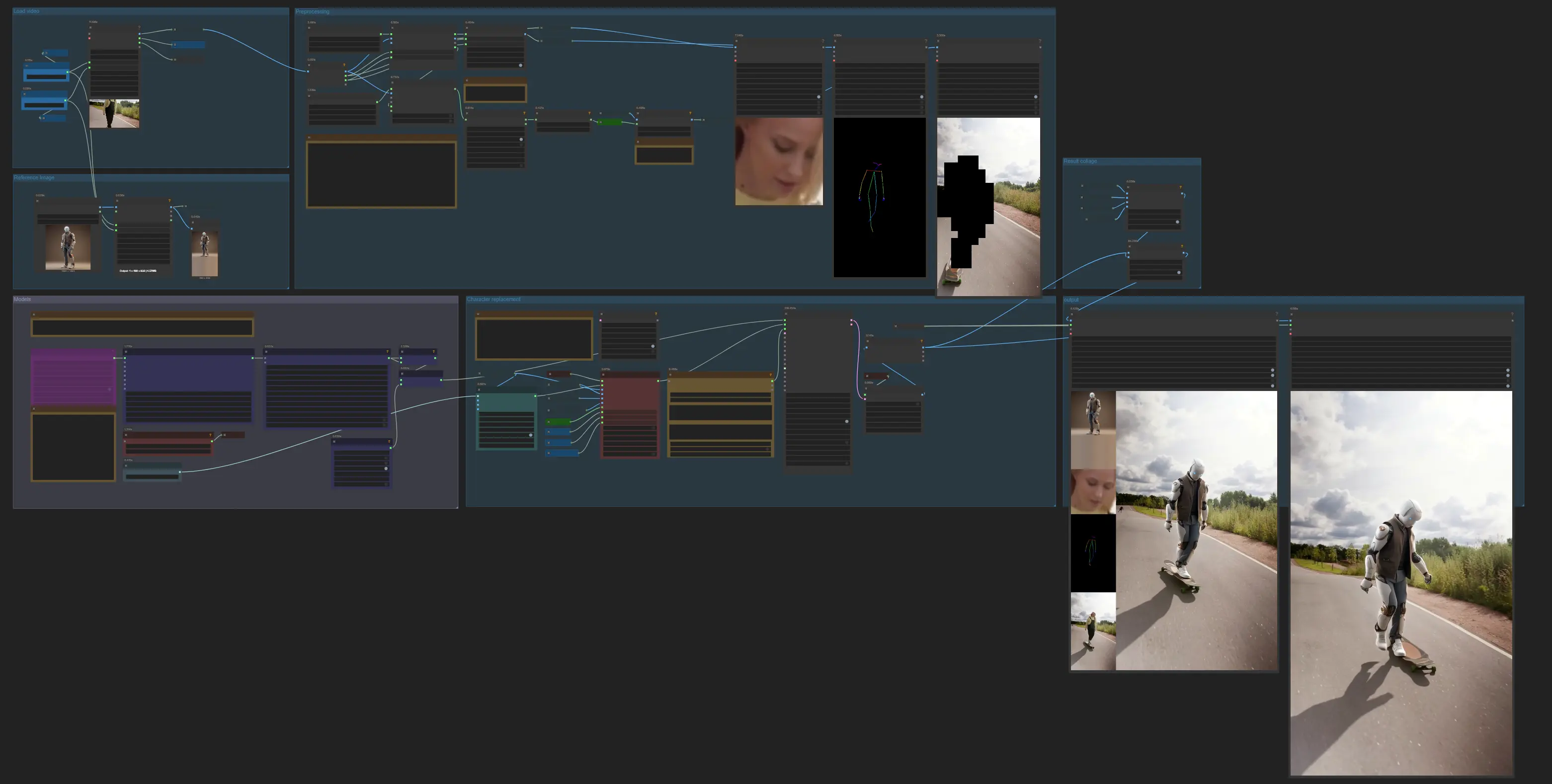

Tauschen Sie jeden vor der Kamera sprechenden Charakter in Ihren eigenen Charakter aus, während die Bewegung, Ausdrücke und Mundformen an das Original-Audio angepasst bleiben. Dieser ComfyUI-Workflow, basierend auf Wan 2.2 Animate: Charaktere austauschen & Lip-Sync, erkennt Körperhaltung und Gesichtsrahmen aus einem Eingabevideo, zielt sie auf ein einzelnes Referenzbild ab und rendert ein kohärentes, sprachsynchrones Ergebnis.

Der Workflow eignet sich für Editoren, Kreative und Forscher, die eine zuverlässige Charakterersetzung für Interviews, Reels, VTubing, Folien oder synchronisierte Kurzfilme wünschen. Stellen Sie einen Quellclip und ein sauberes Referenzbild bereit; die Pipeline rekonstruiert Pose und Lippenartikulation auf dem neuen Charakter und mischt den Original-Soundtrack in den endgültigen Export.

Wichtige Modelle im ComfyUI Wan 2.2 Animate: Charaktere austauschen & Lip-Sync-Workflow#

- Wan 2.2 Animate 14B (FP8 skaliert): Der Kernvideogenerator, der den neu ausgerichteten Charakter über die Frames hinweg mithilfe von Pose-, Gesichts- und Kontextsignalen synthetisiert. Model hub

- Wan 2.1 VAE (bf16): Kodiert/Dekodiert Video-Latente, die von Wan während des Samplings und der Ausgabe verwendet werden. Weights

- UMT5‑XXL Text Encoder (bf16): Erstellt Texteingaben für leichte Aufforderungen oder Shot-Beschreibungen. Weights

- CLIP Vision H: Extrahiert robuste Bildmerkmale aus dem Referenzporträt, um die Identität zu bewahren. Weights

- Lightx2v I2V 14B LoRA: Verbessert Bild-zu-Video-Stabilität und Treue bei der Steuerung mit Referenzrahmen. LoRA

- Wan22 Relight LoRA: Hilft, konsistente Schattierungen und Beleuchtung über die Aufnahme hinweg beizubehalten. LoRA

- YOLOv10m (ONNX): Schnelle Personen-/Gesichtserkennung vor der Pose-Schätzung. Model

- ViTPose WholeBody Large (ONNX): Hochwertige Skelett-Schlüsselpunkte für vollständige Körperbewegungsübertragung. Model

- Segment Anything 2.1: Segmentierung für saubere Vordergrundmasken, die den Austausch leiten. Repo

Verwendung des ComfyUI Wan 2.2 Animate: Charaktere austauschen & Lip-Sync-Workflows#

Der Graph durchläuft sieben Gruppen: Eingaben laden, eine Referenz erstellen, Pose/Gesicht und Masken vorverarbeiten, Generationsmodelle laden, Charakteraustausch durchführen, Diagnosen vorschauen, dann mit Audio exportieren.

Video laden#

Importieren Sie Ihren Quellclip mit VHS_LoadVideo (#63). Der Knoten bietet optionale Breite/Höhe zum Ändern der Größe und gibt Videoframes, Audio und Frame-Anzahl für die nachgelagerte Verwendung aus. Halten Sie den Clip nahe am Sprechteil, wenn Sie eine schnellere Verarbeitung wünschen. Das Audio wird an den Exporteur weitergeleitet, damit das endgültige Video mit dem Original-Soundtrack übereinstimmt.

Referenzbild#

Stellen Sie ein einziges, sauberes Porträt des Zielcharakters bereit. Das Bild wird mit ImageResizeKJv2 (#64) auf Ihre Arbeitsauflösung skaliert und als kanonische Referenz gespeichert, die von CLIP Vision und dem Generator verwendet wird. Bevorzugen Sie ein scharfes, nach vorne gerichtetes Bild unter ähnlicher Beleuchtung wie bei Ihrer Quellaufnahme, um Farb- und Schattendrift zu reduzieren.

Vorverarbeitung#

OnnxDetectionModelLoader (#178) lädt YOLO und ViTPose, dann analysiert PoseAndFaceDetection (#172) jedes Frame, um vollständige Körper-Schlüsselpunkte und pro-Frame-Gesichtsausschnitte zu erzeugen. Sam2Segmentation (#104) erstellt eine Vordergrundmaske mit entweder erkannten Begrenzungsrahmen oder Schlüsselrahmenpunkten; wenn ein Hinweis fehlschlägt, wechseln Sie zum anderen für eine bessere Trennung. Die Maske wird mit GrowMaskWithBlur (#182) verfeinert und mit BlockifyMask (#108) blockiert, um dem Generator eine stabile, eindeutige Subjektregion zu geben. Optionale Überlagerungen (DrawViTPose (#173) und DrawMaskOnImage (#99)) helfen Ihnen, die Pose-Abdeckung und Maskenqualität vor der Erstellung visuell zu überprüfen.

Modelle#

WanVideoModelLoader (#22) lädt Wan 2.2 Animate 14B, und WanVideoVAELoader (#38) stellt die VAE bereit. Identitätsmerkmale aus dem Referenzporträt werden von CLIPVisionLoader (#71) und WanVideoClipVisionEncode (#70) kodiert. Stil und Stabilität werden mit WanVideoLoraSelectMulti (#171) abgestimmt, während WanVideoSetLoRAs (#48) und WanVideoSetBlockSwap (#50) LoRAs und Block-Swap-Einstellungen auf das Modell anwenden; diese Tools stammen aus der Wan Wrapper-Bibliothek. Siehe ComfyUI‑WanVideoWrapper für Implementierungsdetails.

Charakteraustausch#

WanVideoTextEncodeCached (#65) akzeptiert eine kurze beschreibende Eingabeaufforderung, wenn Sie Aussehen oder Stimmung der Aufnahme beeinflussen möchten. WanVideoAnimateEmbeds (#62) fügt das Referenzbild, pro-Frame-Pose, Gesichtsausschnitte, Hintergrund und Maske in Bild-Einbettungen zusammen, die die Identität bewahren, während Bewegung und Mundformen angepasst werden. WanVideoSampler (#27) rendert dann die Frames; sein Scheduler und seine Schritte steuern den Schärfe-Bewegungs-Ausgleich. Die dekodierten Frames von WanVideoDecode (#28) werden an Größen-/Anzahlprüfer übergeben, damit Sie die Dimensionen vor dem Export bestätigen können.

Ergebnis-Collage#

Für eine schnelle QA verkettet der Workflow die wichtigsten Eingaben mit ImageConcatMulti (#77, #66) zu einem einfachen Vergleichsstreifen der Referenz, Gesichtsausschnitte, Pose-Visualisierung und einem Rohrahmen. Verwenden Sie es, um Identitätshinweise und Mundformen direkt nach einem Testlauf zu überprüfen.

Ausgabe#

VHS_VideoCombine (#30) erzeugt das endgültige Video und mischt das Original-Audio für perfektes Timing. Zusätzliche Exporteure sind enthalten, damit Sie bei Bedarf Zwischenprodukte oder alternative Schnitte speichern können. Für beste Ergebnisse bei längeren Clips exportieren Sie zuerst einen kurzen Test, dann iterieren Sie bei LoRA-Mixen und Masken, bevor Sie sich für ein vollständiges Rendering entscheiden.

Wichtige Knoten im ComfyUI Wan 2.2 Animate: Charaktere austauschen & Lip-Sync-Workflow#

VHS_LoadVideo (#63) Lädt Frames und das Original-Audio in einem Schritt. Verwenden Sie es, um eine Arbeitsauflösung einzustellen, die zu Ihrem GPU-Budget passt, und um die Frame-Anzahl zu bestätigen, die nachgelagerte Knoten verbrauchen werden. Von ComfyUI‑VideoHelperSuite.

PoseAndFaceDetection (#172) Führt YOLO und ViTPose aus, um Personenboxen, vollständige Körper-Schlüsselpunkte und pro-Frame-Gesichtsausschnitte zu extrahieren. Gute Schlüsselpunkte sind das Rückgrat einer glaubwürdigen Bewegungstransfer und werden direkt für die Lippenartikulation wiederverwendet. Von ComfyUI‑WanAnimatePreprocess.

Sam2Segmentation (#104) Erstellt eine Vordergrundmaske um das Subjekt herum, indem entweder Begrenzungsrahmen oder Schlüsselrahmen-Punkthinweise verwendet werden. Wenn Haare oder Hände fehlen, wechseln Sie den Hinweis-Typ oder erweitern Sie die Unschärfe-/Wachstumseinstellungen, bevor Sie blockieren. Von ComfyUI‑segment‑anything‑2.

WanVideoLoraSelectMulti (#171) Ermöglicht das Mischen von LoRAs wie Lightx2v und Wan22 Relight, um Bewegungsstabilität, Lichtkonsistenz und Identitätsstärke auszubalancieren. Erhöhen Sie das Gewicht eines LoRA für mehr Einfluss, aber achten Sie auf Überstilisierung bei Gesichtern. Von ComfyUI‑WanVideoWrapper.

WanVideoAnimateEmbeds (#62) Kombiniert das Referenzporträt, Pose-Bilder, Gesichtsausschnitte, Hintergrund-Frames und Maske in eine kompakte Darstellung, die Wan 2.2 Animate konditioniert. Stellen Sie sicher, dass width, height und num_frames mit Ihrem beabsichtigten Export übereinstimmen, um Neusampling-Artefakte zu vermeiden. Von ComfyUI‑WanVideoWrapper.

WanVideoSampler (#27) Erzeugt die endgültigen Frames. Verwenden Sie höhere Schritte und einen stabileren Scheduler, wenn Sie schärfere Details benötigen, oder einen leichteren Zeitplan für schnelle Vorschauen. Für sehr lange Clips können Sie optional Kontextfenster-Steuerungen einführen, indem Sie WanVideoContextOptions (#110) verdrahten, um zeitliche Konsistenz über Fenster hinweg zu wahren.

VHS_VideoCombine (#30) Exportiert das fertige Video und mischt das Original-Audio, sodass die Lippenbewegungen synchron bleiben. Die Option "Trim-to-Audio" hält die Dauer mit dem Soundtrack im Einklang. Von ComfyUI‑VideoHelperSuite.

Optionale Extras#

- Verwenden Sie eine scharfe, frontale Referenz mit neutralen Lippen für den saubersten Identitätstransfer; vermeiden Sie starkes Make-up oder Verdeckungen.

- Wenn die Segmentierung Haare oder Accessoires verpasst, versuchen Sie,

Sam2Segmentation-Hinweise zwischen Begrenzungsrahmen und Schlüsselrahmenpunkten zu wechseln, dann vergrößern Sie die Maske leicht, bevor Sie blockieren. - Lightx2v LoRA verbessert die I2V-Stabilität; Wan22 Relight LoRA hilft, inkonsistente Beleuchtung anzupassen. Kleine Gewichtsänderungen können Flimmern ohne Überbacken eines Looks beheben.

- Block-Swap kann Identitätsdrift bei langen Aufnahmen reduzieren; wenn Gesichter im Laufe der Zeit weich werden, aktivieren Sie es in

WanVideoSetBlockSwap(#50) und testen Sie erneut. - Halten Sie die Arbeitsauflösung proportional zur Quelle, um Verzerrungen des Seitenverhältnisses zu vermeiden; vergrößern Sie nur, wenn das Referenzbild detailliert genug ist, um es zu unterstützen.

- Für fähige Laufzeiten kann das Aktivieren von Torch-Compile und effizienter Aufmerksamkeit in den Wrapper-Knoten das Sampling beschleunigen; siehe ComfyUI‑WanVideoWrapper für Anleitungen.

Dieser Wan 2.2 Animate: Charaktere austauschen & Lip-Sync-Workflow liefert konsistente Bewegungstransfers und sprachsynchronisierte Mundformen mit minimalem Aufwand, sodass hochwertige Charakteraustausche innerhalb von ComfyUI schnell und wiederholbar sind.

Danksagungen#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir bedanken uns herzlich bei @MDMZ für den Aufbau des gesamten Workflows, Kijai für WAN 2.2 Animate und verwandte ComfyUI-Knoten, Wan-AI für Wan2.2-Animate-Assets einschließlich YOLOv10m-Erkennung und Comfy-Org für das Wan 2.1 Clip Vision-Modell für ihre Beiträge und Wartung. Für autoritative Details, beziehen Sie sich bitte auf die Originaldokumentation und die unten verlinkten Repositories.

Ressourcen#

- Workflow-Tutorial

- Youtube: ComfyUI-Tutorial von @MDMZ

Hinweis: Die Nutzung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen, die von ihren Autoren und Betreuern bereitgestellt werden.