本指南提供了使用 "Wonder3D" 模型創建3D內容的全面介紹,利用 "ComfyUI 3D Pack" 節點的高級功能來簡化工作流程並提高輸出質量。

第1部分: ComfyUI 3D Pack#

1.1. ComfyUI 3D Pack 介紹#

ComfyUI 3D Pack 是一個廣泛的節點套件,使 ComfyUI 能夠使用先進的算法和模型來處理3D輸入,如網格和 UV 紋理。它集成了先進的3D處理算法,如3DGS(高斯噴射)和 NeRF(神經輻射場),以及最先進的模型,包括 Hunyuan3D、StableFast3D、InstantMesh、CRM、TripoSR 等。

使用 ComfyUI 3D Pack,使用者可以在直觀的 ComfyUI 介面中導入、操作和生成高品質的3D內容。它支持多種3D文件格式,如 OBJ、PLY、GLB,便於集成現有的3D模型。該包還包括強大的網格處理工具,以編輯、清理和優化3D幾何。

其中一個關鍵亮點是 NeRF 技術的集成,允許從2D影像進行逼真的3D重建。3DGS 節點支持點雲渲染和風格化。InstantMesh 和 TripoSR 模型允許對3D網格進行高分辨率升級和超分辨率。CRM(卷積重建模型)可以從多視角影像中恢復3D形狀和 CCM(色彩校正圖)。

ComfyUI 3D Pack 由 MrForExample 開發,所有的功勞歸於 MrForExample。詳細信息請參見 ComfyUI 3D Pack。

1.2. ComfyUI 3D Pack: 已準備好在 RunComfy 上運行#

現在 ComfyUI 3D Pack 已完全設置好,可以在 RunComfy 網站上使用。使用者不需要安裝任何額外的軟件或依賴項。所有所需的模型、算法和工具都已預配置並優化,以便在基於 Web 的 ComfyUI 環境中高效運行。

第2部分: 使用 Wonder3D 模型與 ComfyUI 3D Pack 節點#

2.1. 什麼是 Wonder3D?#

Wonder3D 是一種尖端的方法,用於從單視角影像高效生成高品質的帶紋理網格。它利用跨域擴散模型的力量來生成多視角法線圖及其對應的彩色影像。Wonder3D 旨在解決單視角3D重建任務中的保真度、一致性、泛化性和效率挑戰。

Wonder3D 由香港大學、清華大學、VAST、賓夕法尼亞大學、上海科技大學、MPI 信息學和德克薩斯農工大學的研究團隊開發,Xiaoxiao Long 和 Yuan-Chen Guo 為同等貢獻的第一作者。所有功勞歸於他們的貢獻;更多信息請參見他們的項目頁面 here。

2.2. Wonder3D 背後的技術#

Wonder3D 的核心在於其創新的跨域擴散模型。該模型旨在捕捉多視角間法線圖和彩色影像的聯合分佈。為此,Wonder3D 引入了一個域切換器和一個跨域注意機制。域切換器允許無縫生成法線圖或彩色影像,而跨域注意機制促進了兩個域之間的信息交換,增強了一致性和質量。

Wonder3D 的另一個關鍵組件是其幾何感知的法線融合算法。該算法即使在存在不準確的情況下,也能從生成的多視角2D表示中穩健地提取高品質的表面。通過利用法線圖和彩色影像中編碼的豐富表面細節,Wonder3D 能夠重建乾淨且細緻的幾何結構。

2.3. Wonder3D 的優點/潛在限制#

Wonder3D 提供了多個優於現有單視角重建方法的優勢。它在保持良好效率的同時實現了高水平的幾何細節,使其適用於各種應用。跨域擴散模型使 Wonder3D 能夠很好地泛化到不同的物件類別和風格。跨域注意機制強制的多視角一致性導致連貫且合理的3D重建。

然而,像任何方法一樣,Wonder3D 可能有一些限制。生成的網格質量取決於訓練數據和擴散模型捕捉底層3D結構的能力。高度複雜或模糊的形狀可能會帶來挑戰。此外,Wonder3D 的當前實現重點在於單個物件,擴展到處理多個物件或整個場景可能是未來研究的一個領域。

2.4. 如何使用 Wonder3D 工作流#

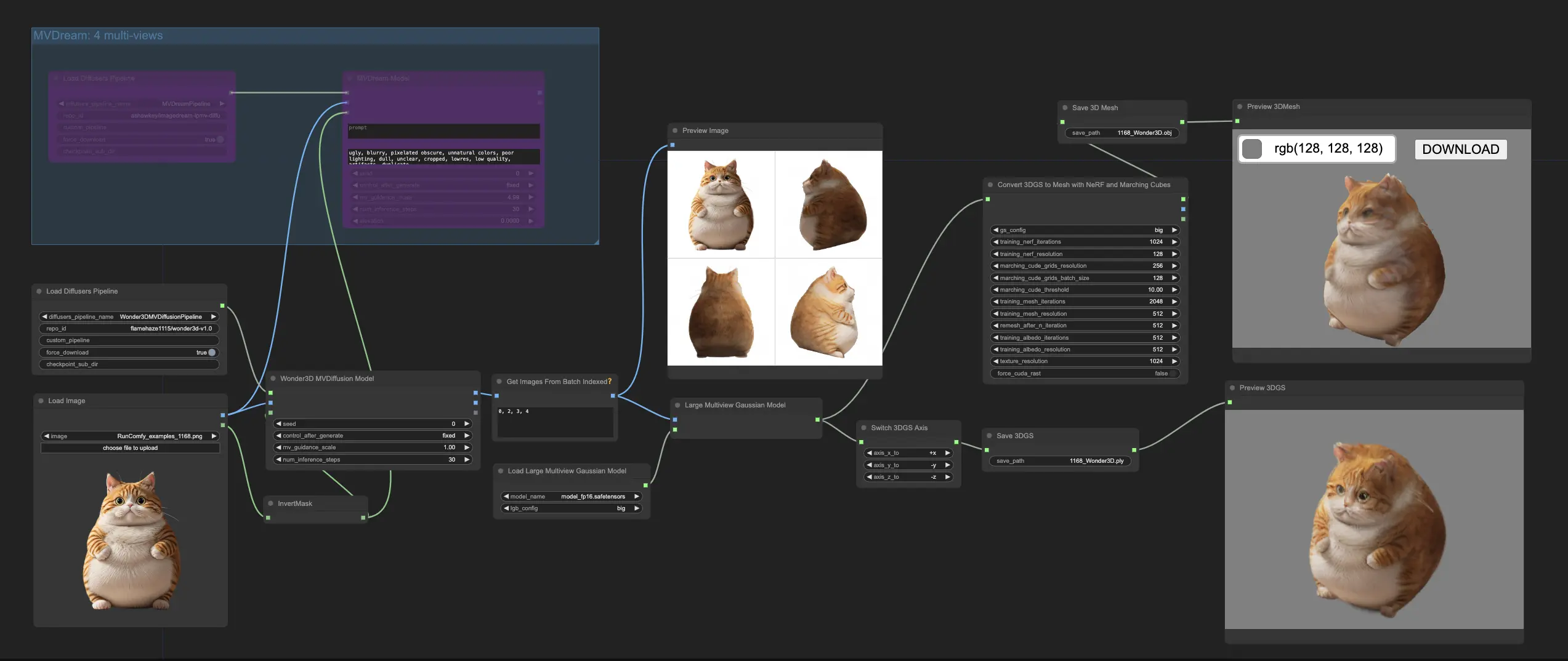

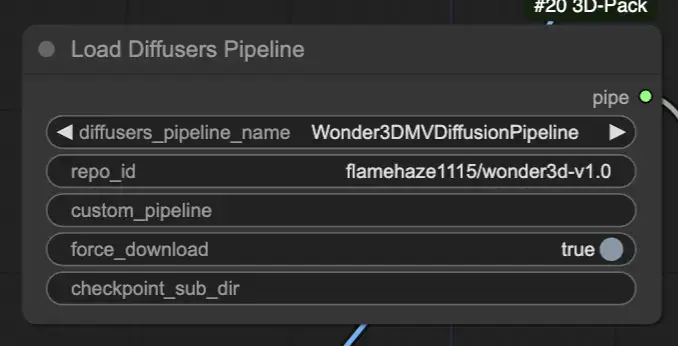

使用 "[Comfy3D] Load Diffusers Pipeline" 節點加載預訓練的 Wonder3D 擴散管道,這會導入必要的模型檢查點和配置。

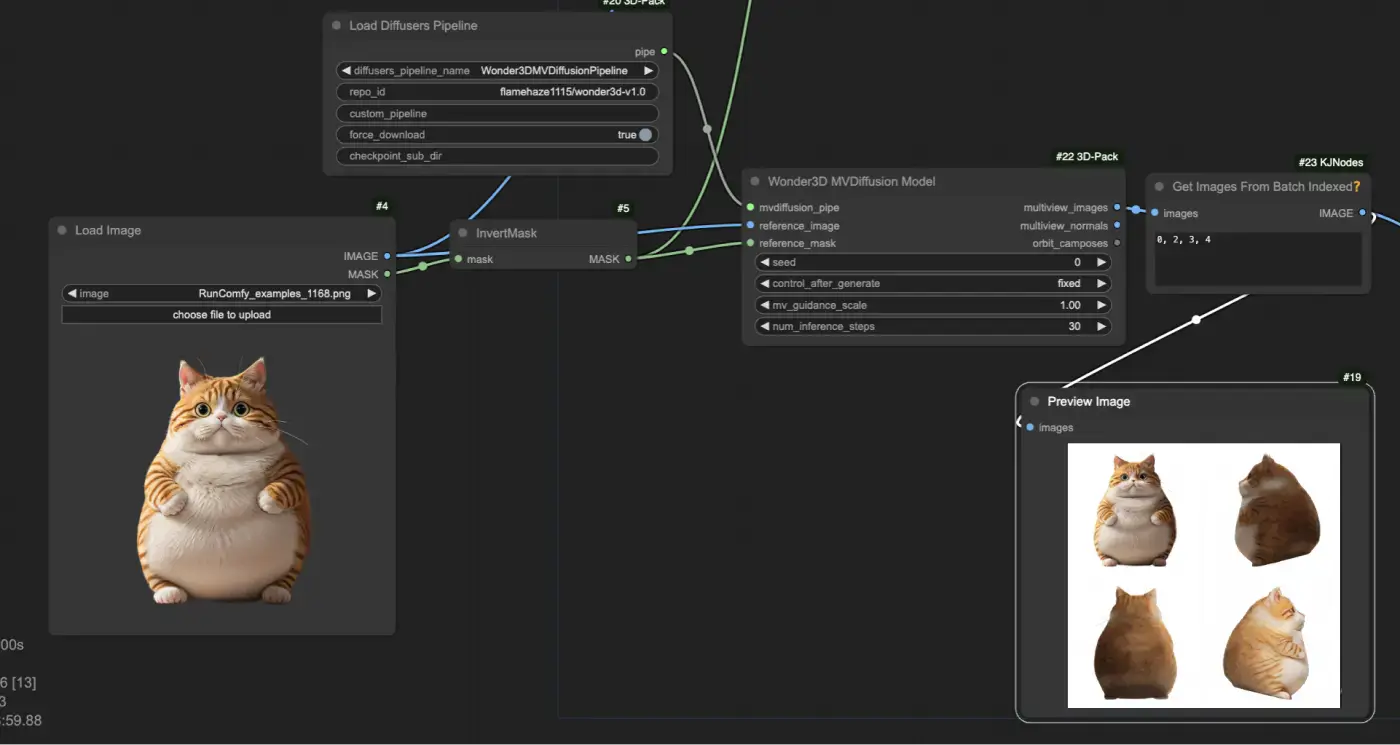

使用 "LoadImage" 和 "InvertMask" 節點提供輸入影像及其對應的遮罩。然後將輸入影像和遮罩饋入 "[Comfy3D] Wonder3D MVDiffusion Model" 節點,該節點生成多視角法線圖和彩色影像。

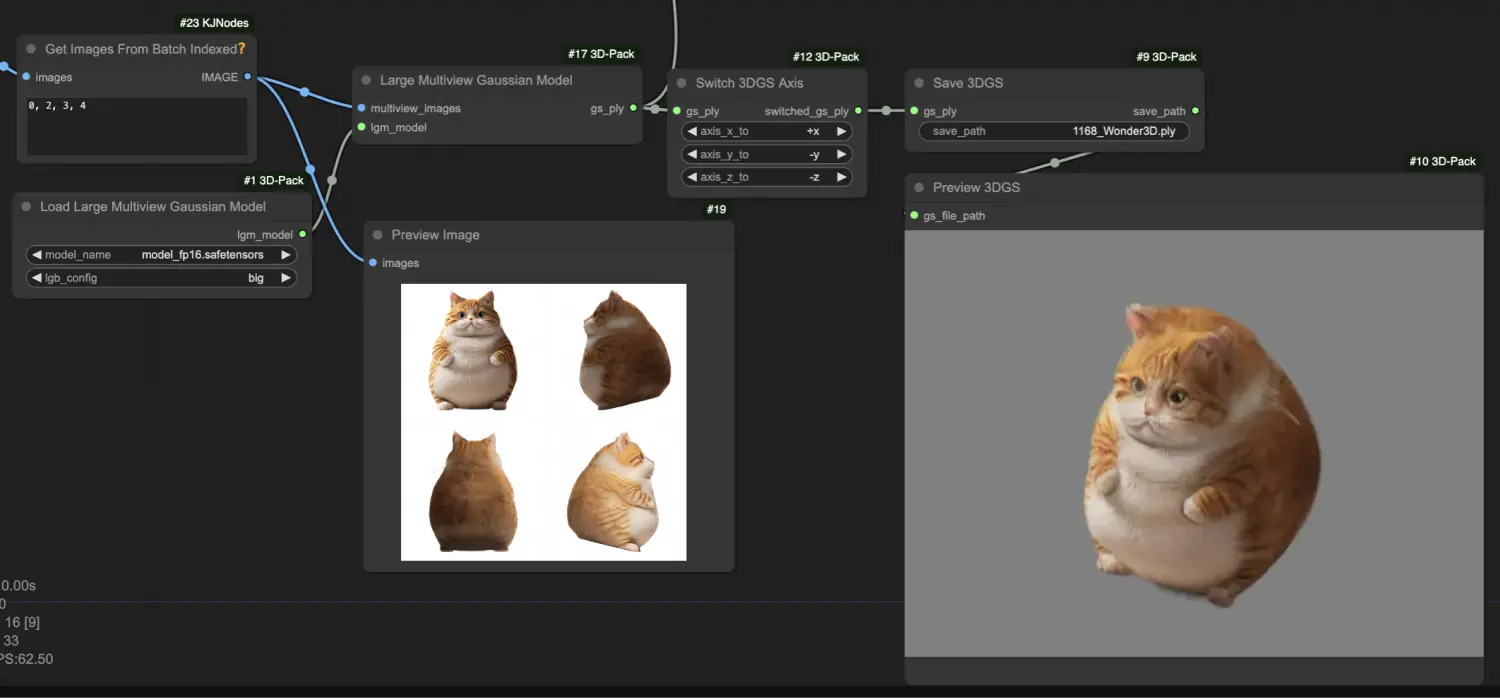

使用 "[Comfy3D] Large Multiview Gaussian Model" 節點處理生成的多視角影像,將其轉換為3D高斯噴射(3DGS)表示,以點雲格式捕捉物件的幾何細節。

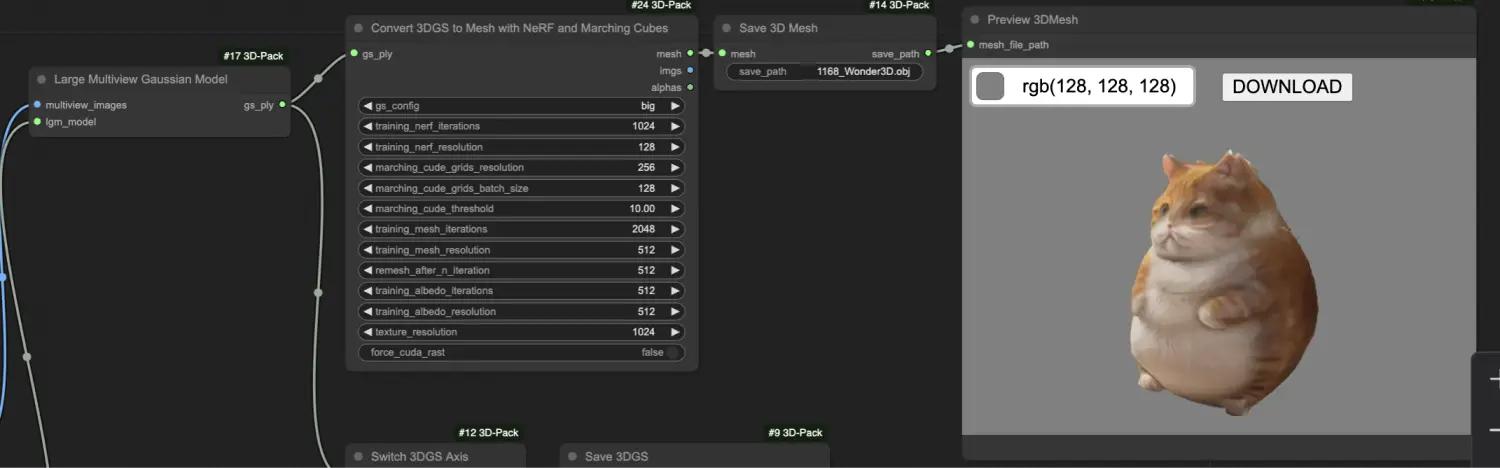

使用 "[Comfy3D] Convert 3DGS to Mesh with NeRF and Marching Cubes" 節點將3DGS表示轉換為帶紋理的網格,該節點使用神經輻射場(NeRF)和行進立方體算法提取高品質網格。