Wan 2.1 Fun | ControlNet 视频生成#

Wan 2.1 Fun 引入了一种直观而强大的方法,用于使用 Wan 2.1 Fun 模型进行受控 AI 内容创作。 构建在一个 ControlNet 启发的框架上,Wan 2.1 Fun 确保与标准 ControlNet 预处理模块的兼容性。通过从输入素材中提取 Depth、Canny 或 OpenPose 通道,这个 ControlNet-based ComfyUI 工作流允许用户以精确的方式影响输出的结构、运动和风格,而不只是依赖文本提示。

Wan 2.1 Fun 将结构化的视觉数据引入流程——保持运动精确性,增强风格化,并实现更为明确的转换。无论您是在构建动态动画、姿态驱动的表演,还是在实验抽象运动艺术,Wan 2.1 Fun 都能将艺术控制直接置于您的手中,同时利用 Wan 2.1 Fun 模型和 ControlNet 原则的表现力。

为什么选择 Wan 2.1 Fun?#

Wan 2.1 Fun 工作流程提供了一种灵活的方式,通过 ControlNet 风格的视觉条件引导 AI 运动和结构:

- 使用 Depth、Canny 或 OpenPose 进行结构化控制

- 构建在一个 ControlNet 启发的系统上,实现引导转换

- 兼容多种 ControlNet 预处理器,包括第三方扩展

- 通过 ControlNet 原则实现更清晰的空间一致性、形态和动态流动

- 无需复杂的提示工程或训练

- 轻量且响应迅速,具备高视觉保真度

- 适合动作设计、风格化编舞或表演驱动的运动合成

如何使用 Wan 2.1 Fun ControlNet 工作流程#

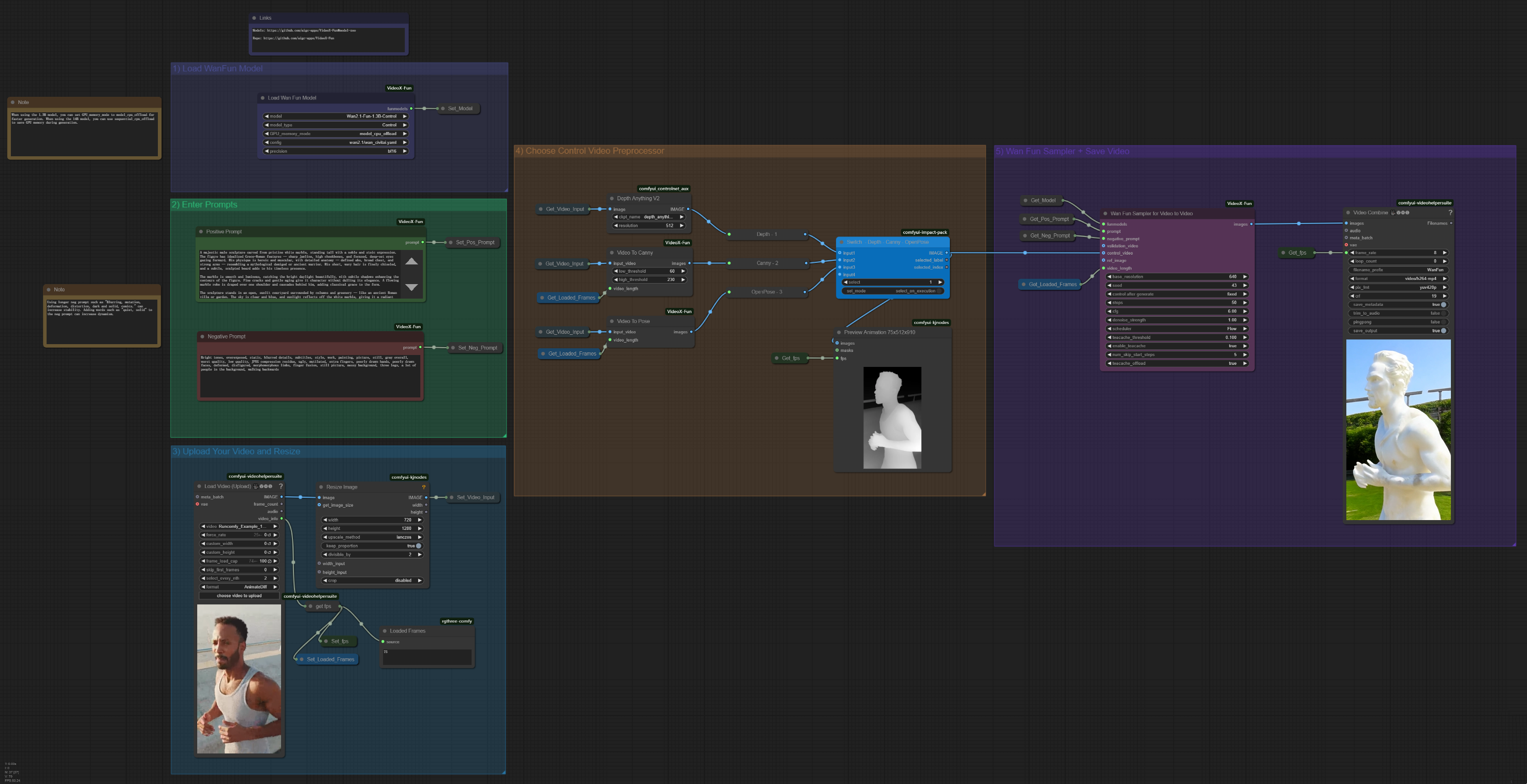

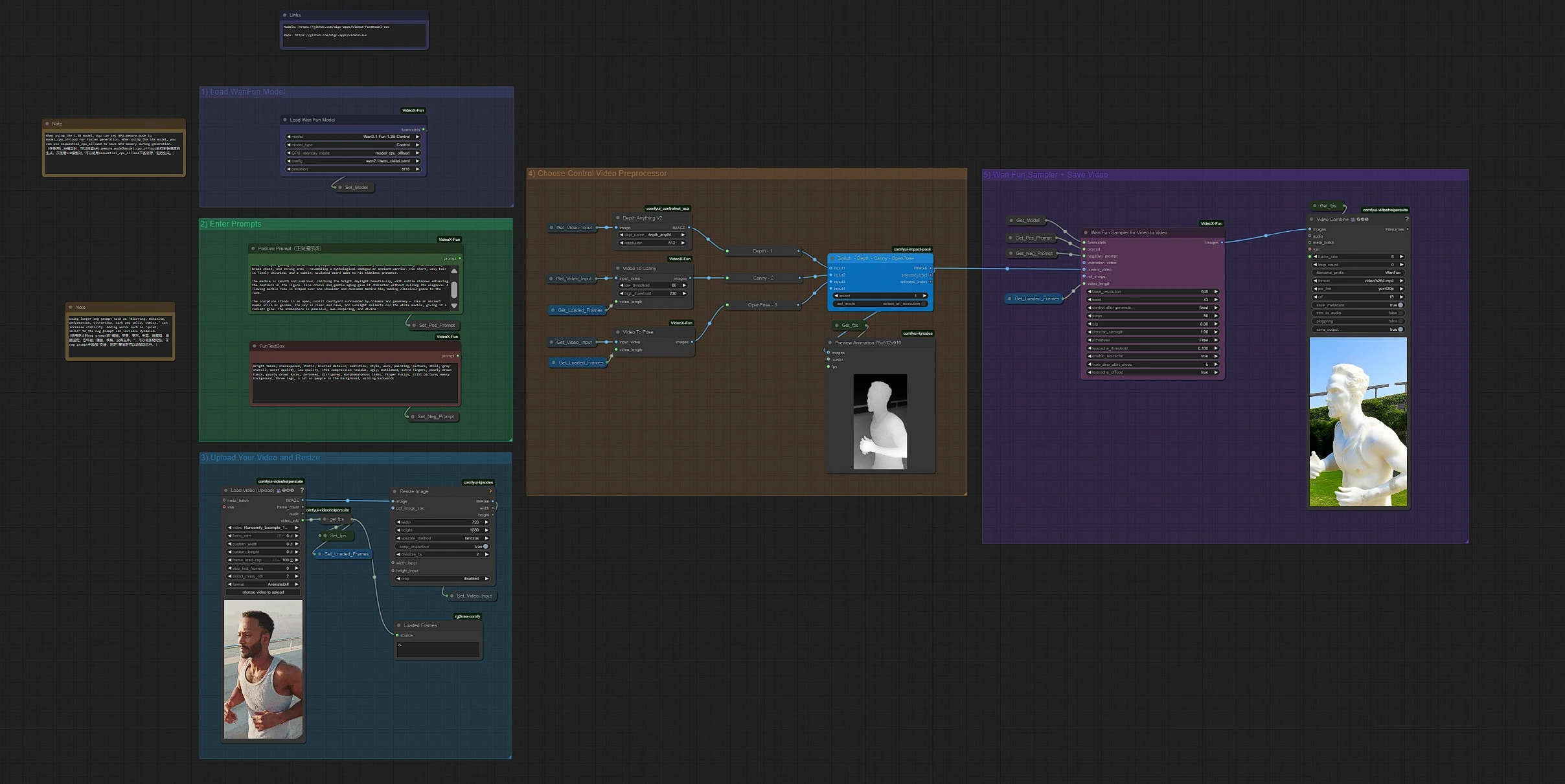

Wan 2.1 Fun 概览#

Load WanFun Model(紫色): 模型加载器Enter Prompts(绿色): 正面和负面提示Upload Your Video and Resize(青蓝色): 用户输入 – 参考素材和调整大小Choose Control Video Preprocessor(橙色): ControlNet 节点,用于深度、Canny 或 OpenPoseWan Fun Sampler + Save Video(粉色): 采样与输出

快速开始步骤:#

- 选择你的 Wan 2.1 Fun 模型 (

Wan2.1-Fun-Control (1.3B / 14B)) - 输入你的正面和负面提示

- 上传参考素材

- 通过

Queue Prompt运行工作流程 - 从最后一个节点或

Outputs文件夹中检索结果

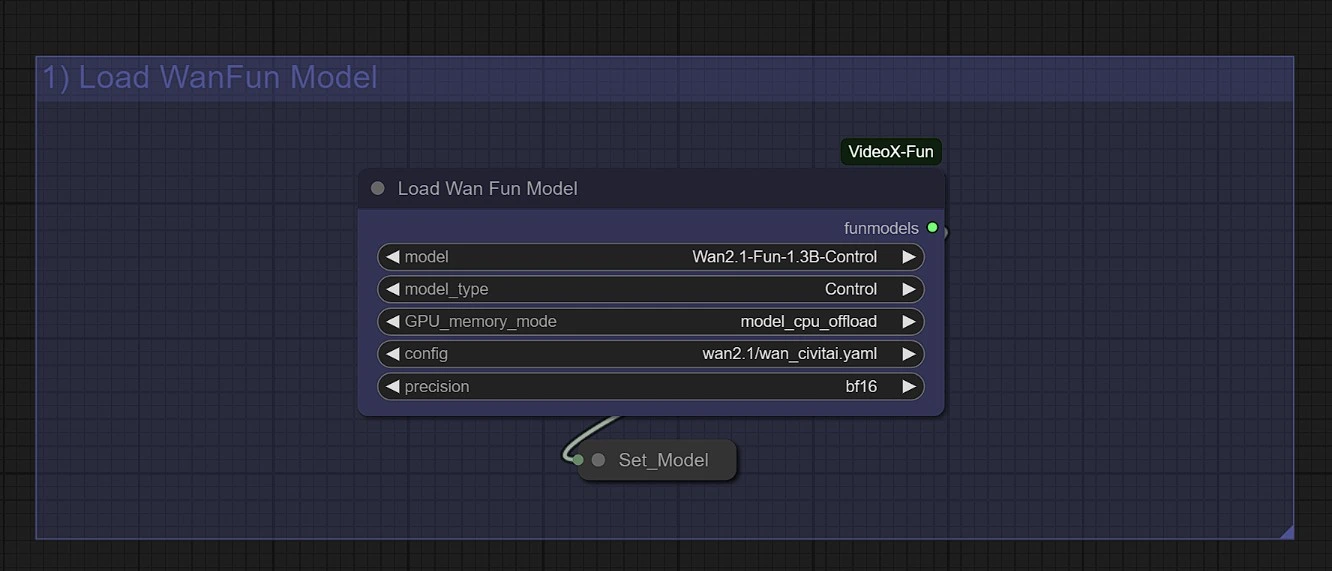

1 - 加载 WanFun 模型#

选择适合 ControlNet 风格调节的 Wan2.1-Fun-Control 变体:

- 使用

model_cpu_offload以更平稳地运行 1.3B - 使用

sequential_cpu_offload以降低 14B 的 GPU 负载

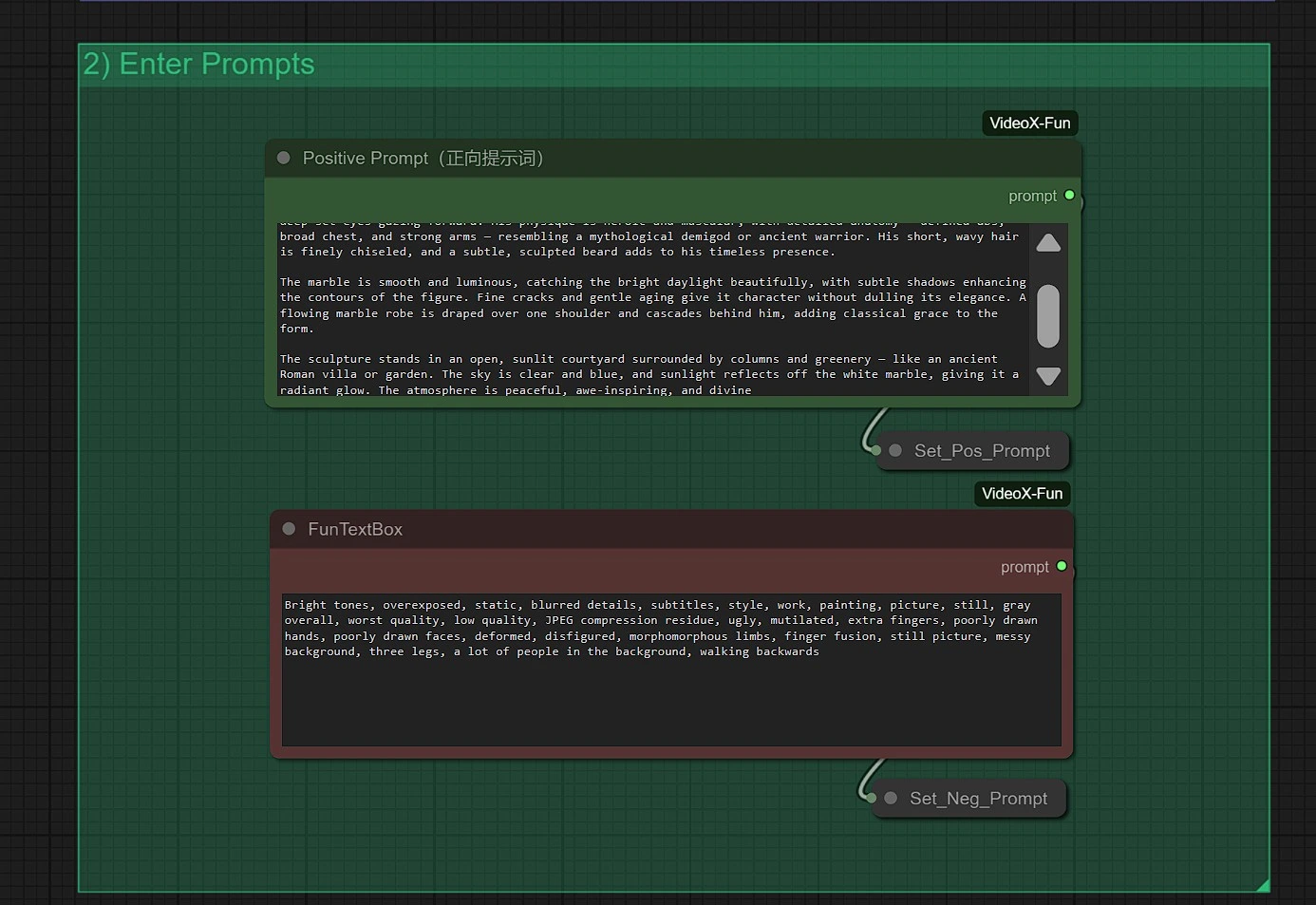

2 - 输入提示#

- 正面提示:

- 描述运动风格、氛围或视觉纹理

- 生动而描述性的提示增强创意控制

- 负面提示:

- 为提高输出稳定性,尝试使用词语如

"Blurring, mutation, deformation, distortion, dark and solid, comics." - 为了更具动态性的运动,添加词语如

"quiet, solid"

- 为提高输出稳定性,尝试使用词语如

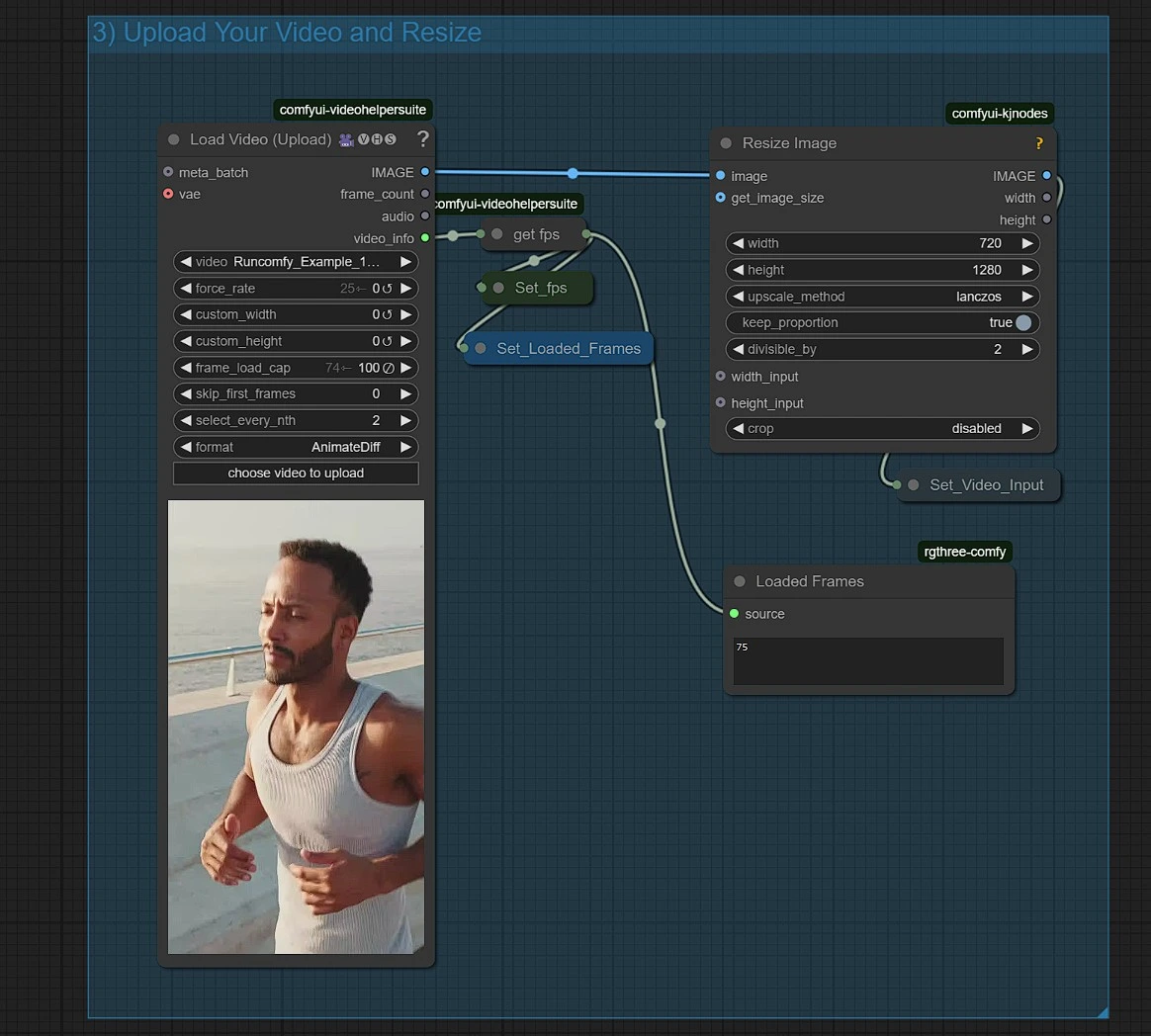

3 - 上传您的视频并调整大小#

上传您的源素材。为获得 Wan 2.1 Fun 的最佳效果,请适当调整大小以满足所需的帧尺寸。

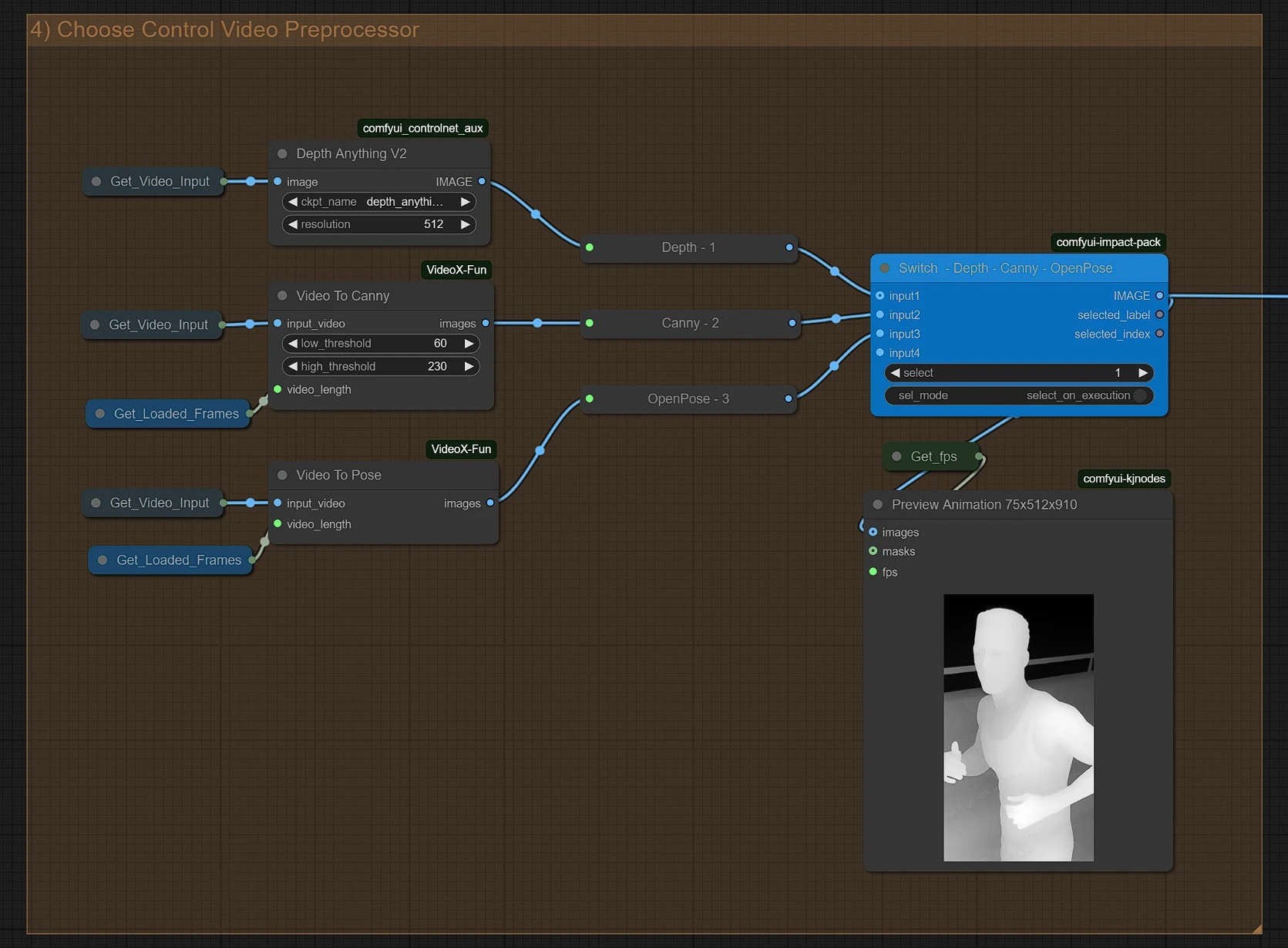

4 - 选择控制视频预处理器#

此部分激活 Wan 2.1 Fun 的 ControlNet 基础预处理系统:

Depth: 捕捉空间布局为深度图Canny: 提取强边缘轮廓和结构OpenPose: 识别关节、肢体和姿态以进行运动驱动的工作

这些指南使 Wan 2.1 Fun 工作流程遵循视觉线索,而不仅仅依赖提示。 所有模块均符合 ControlNet 预处理标准,允许您通过自定义节点扩展功能。

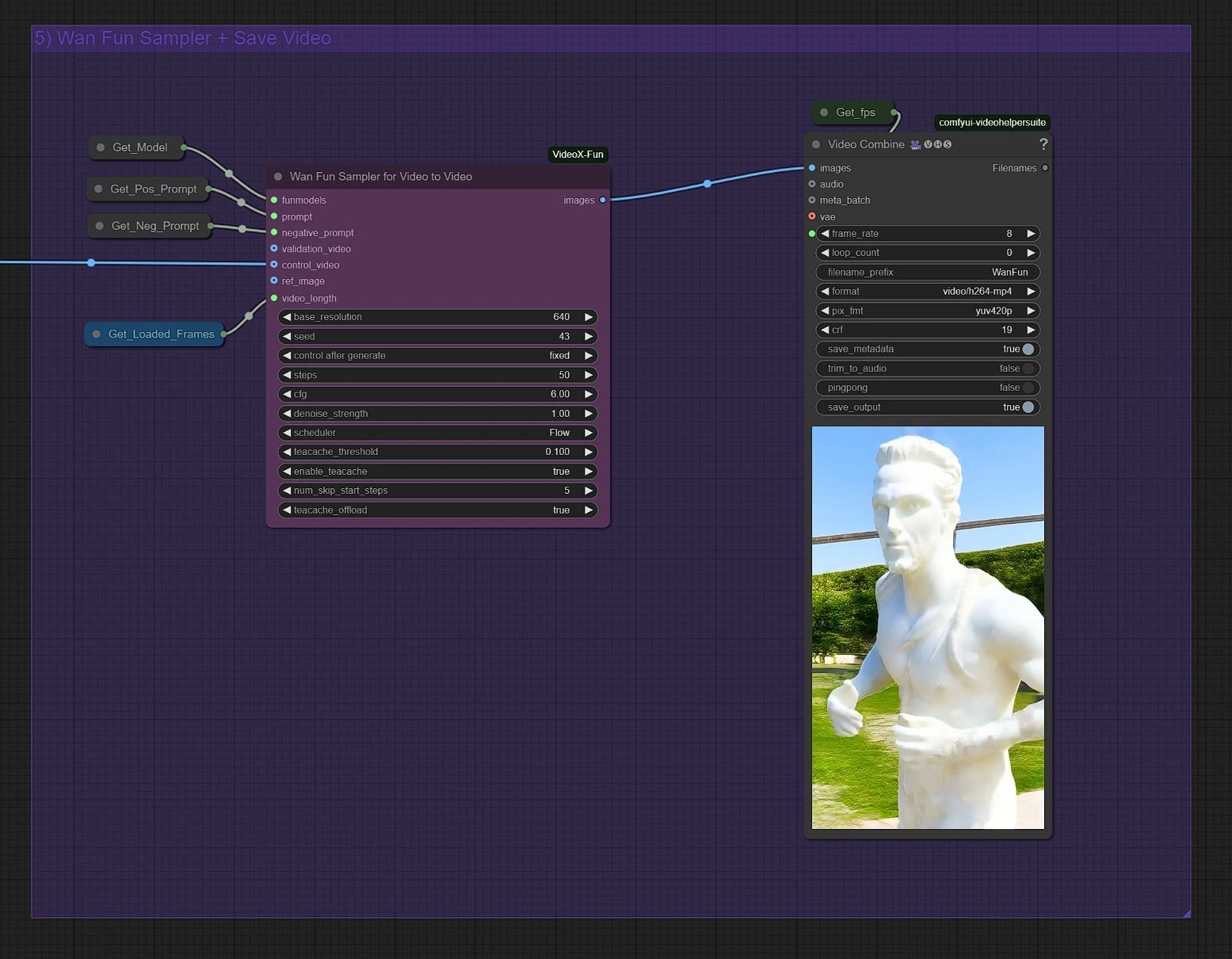

5 - Wan Fun 采样器 + 保存输出#

Wan 2.1 Fun 采样器 针对清晰度和创意一致性进行了调优。 如有需要,可自定义配置。输出会自动保存到指定文件夹。

致谢#

Wan 2.1 Fun 工作流程由 bubbliiiing 和 hkunzhe 开发,他们对 AI 基础的运动控制和风格化做出的贡献使得高级 ControlNet 集成成为可能。此项目应用了 Wan 2.1 Fun 模型的表现力深度,结合深度、Canny 和 OpenPose 输入,实现 AI 辅助视觉制作中的构图和动态精度。 我们感谢他们为创意社区提供这些工具。