Animation IA fluide, contrôle instantané et effets pro pour créateurs

Animation IA fluide, contrôle instantané et effets pro pour créateurs

Transformez vos photos en vidéos réalistes avec synchronisation des lèvres

Animez vos images en vidéos fluides grâce à Pikaframes et ses transitions avancées.

Effets fluides, précision des mouvements et rendu cinématographique

Animez vos images avec un rendu fluide et une fidélité remarquable.

Créez des vidéos cinématiques avec mouvements de caméra et plans préconçus.

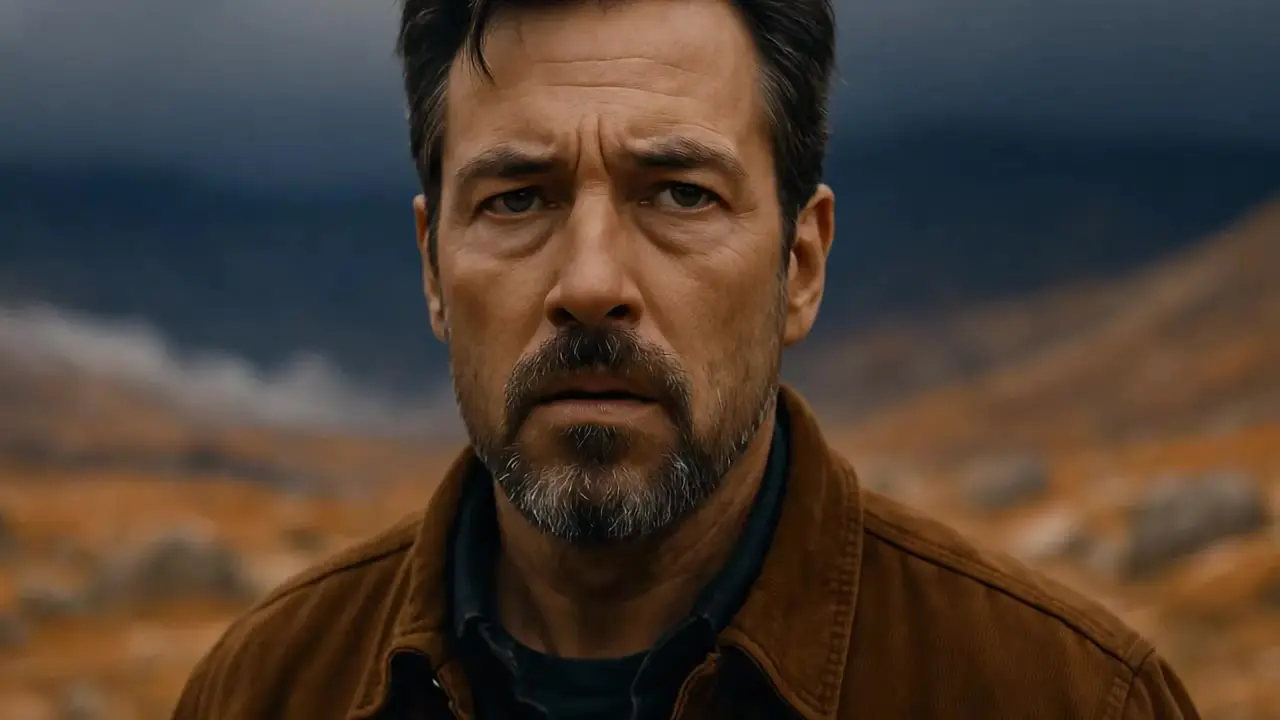

Runway Gen-4 est la dernière version du modèle d’intelligence artificielle de génération vidéo développé par Runway. Par rapport aux précédentes versions comme Gen-2 ou Gen-3 Alpha, Runway Gen-4 se distingue par une meilleure capacité à maintenir la cohérence visuelle au sein d’un même clip, en gardant par exemple un personnage ou un objet stable malgré des changements d’angle de caméra ou de scène. Le modèle intègre également des améliorations notables dans le rendu des mouvements et la fluidité générale des séquences. Bien que Runway Gen-4 génère des vidéos plus naturelles que les versions antérieures, la qualité du résultat dépend toujours de la complexité de l’entrée et du prompt, et il peut subsister des incohérences occasionnelles.

Runway Gen-4 nécessite deux types d’entrées : une image, qui sert de base visuelle et de première image de la vidéo, ainsi qu’un prompt textuel décrivant l’action ou le mouvement souhaité. À l’heure actuelle, Runway Gen-4 ne peut pas générer de vidéos à partir de texte seul, ce qui limite sa flexibilité par rapport à certains outils de type texte-vers-vidéo. Les prompts peuvent contenir jusqu’à 1 000 caractères. En pratique, les descriptions portant sur le mouvement ou la direction de la caméra donnent généralement de meilleurs résultats, puisque l’image d’entrée détermine déjà l’apparence visuelle. Il est possible d'utiliser à la fois des photos et des images générées par IA, mais la qualité du rendu dépend fortement de la clarté du prompt et de l’image utilisée.

Runway Gen-4 permet de générer des vidéos de 5 ou 10 secondes à 24 images par seconde. La résolution standard est de 1280×720 pixels (720p) avec un format d’image en 16:9, mais d’autres formats sont également disponibles, comme le format vertical (9:16) ou carré (1:1). Si Runway Gen-4 offre une qualité d’image supérieure aux versions précédentes, la durée limitée et la résolution peuvent se révéler contraignantes pour des projets narratifs complexes ou à visée commerciale. Pour produire des séquences plus longues, il faut encore assembler manuellement plusieurs clips courts.

Runway Gen-4 est particulièrement adapté au développement de concepts, à l’expérimentation visuelle et au prototypage. Il peut être utilisé pour du storyboard, la création de clips musicaux, des projets d’art visuel, ou tout autre workflow créatif où des séquences courtes et stylisées suffisent. Son rendu rapide et expressif fait de Runway Gen-4 un outil attractif pour les créateurs explorant des idées visuelles.

Runway Gen-4 présente des avancées notables par rapport aux modèles précédents tels que Gen-2 et Gen-3 Alpha, en particulier sur la cohérence visuelle dans un même clip et la fluidité des mouvements générés. Runway Gen-4 est également meilleur pour interpréter les prompts des utilisateurs, offrant des résultats plus fidèles aux actions ou aux mouvements de caméra décrits, ce qui améliore considérablement l’expérience créative.

Malgré ses avancées, Runway Gen-4 comporte plusieurs limites à prendre en compte. D’abord, la durée des clips est restreinte à 5 ou 10 secondes, ce qui oblige à assembler plusieurs séquences pour obtenir un contenu plus long, nécessitant temps et planification. Ensuite, Runway Gen-4 exige une image de départ, ce qui rend impossible la génération purement textuelle et oblige l’utilisateur à fournir cette base visuelle. La cohérence entre plusieurs clips reste difficile à maintenir, même si Runway Gen-4 offre une bonne stabilité dans un seul clip. Enfin, comme d'autres modèles génératifs, il peut produire des artefacts visuels inattendus, des objets déformés ou interpréter partiellement les prompts. Les scènes complexes peuvent exiger plusieurs essais avant d’obtenir un résultat satisfaisant.

Actuellement, Runway Gen-4 est capable de préserver l’apparence d’un personnage au sein d’un clip court. Cependant, il n’offre pas encore de solution fiable pour maintenir cette cohérence sur plusieurs séquences. Pour améliorer la continuité, les créateurs peuvent utiliser des images de référence cohérentes d’une scène à l’autre. Néanmoins, même avec cette précaution, obtenir un rendu stable à travers plusieurs clips avec Runway Gen-4 reste un défi. En attendant des fonctionnalités dédiées, il faudra compter sur des ajustements manuels et un travail de post-production pour assurer la cohérence narrative des vidéos.

RunComfy is the premier ComfyUI platform, offering ComfyUI online environment and services, along with ComfyUI workflows featuring stunning visuals. RunComfy also provides AI Models, enabling artists to harness the latest AI tools to create incredible art.