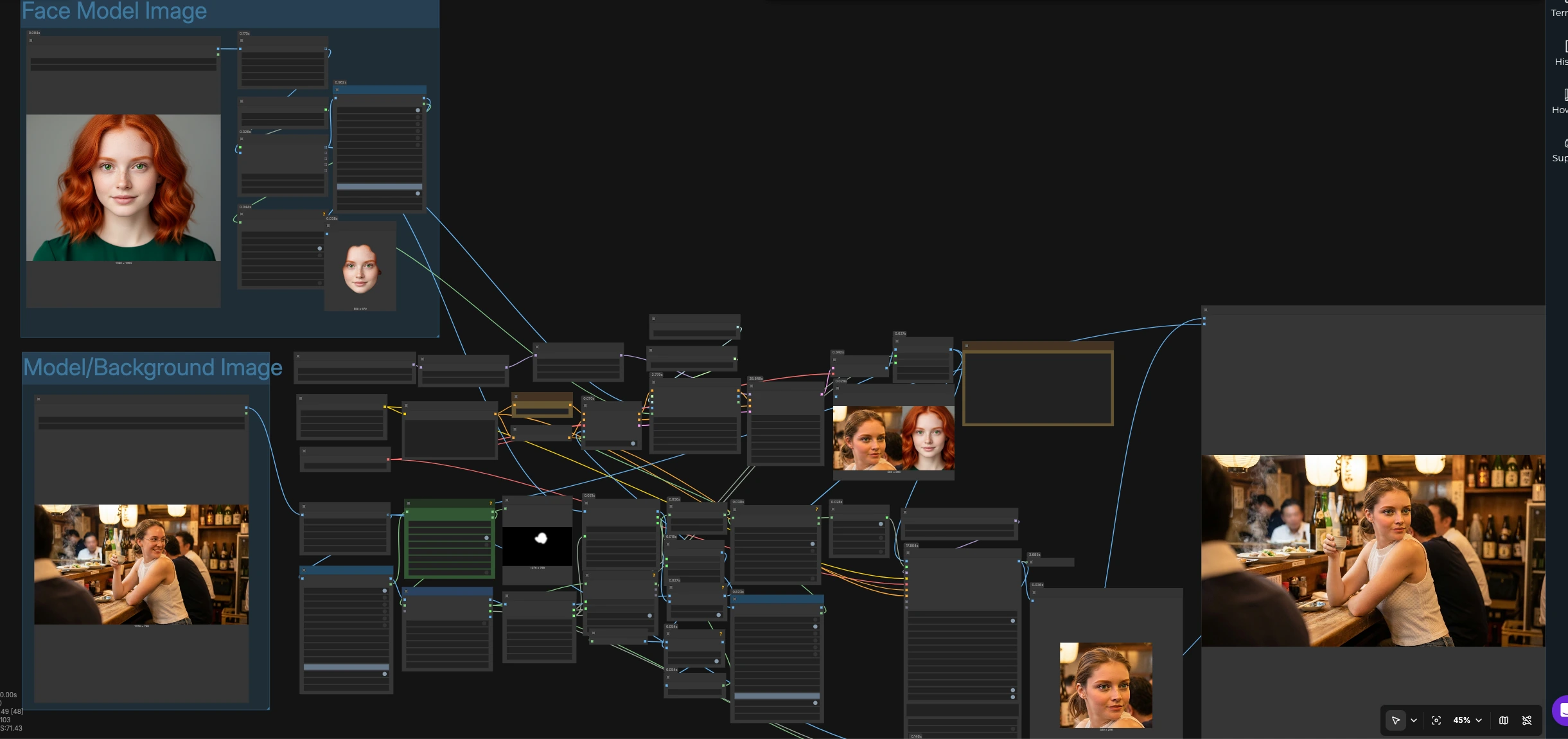

FLUX Redux ACE Face Swap ComfyUI Workflow#

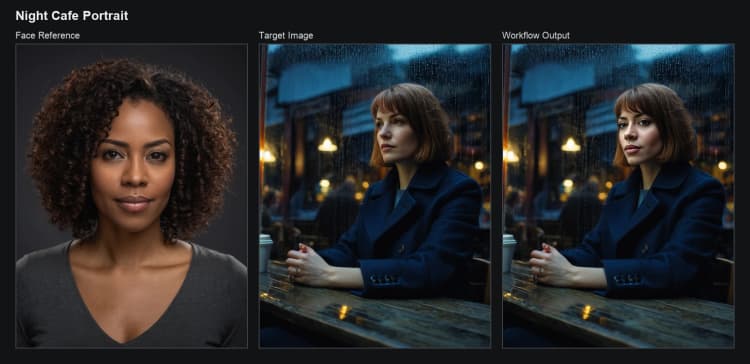

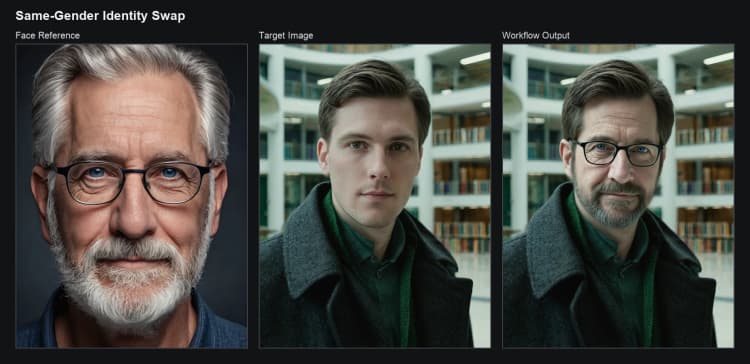

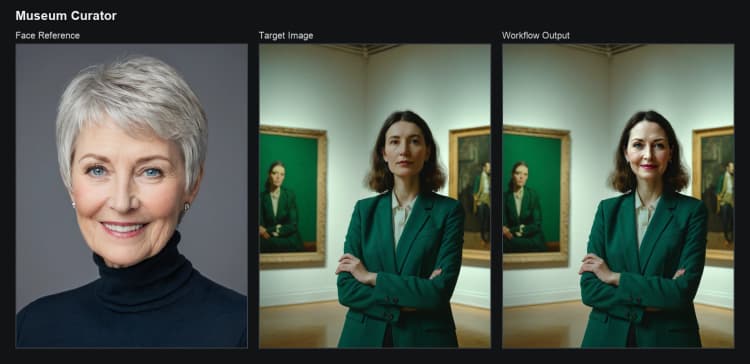

FLUX Redux ACE Face Swap ist ein referenzgeführter Gesichtsaustausch-Workflow für ComfyUI, der FLUX.1 Fill-Inpainting mit FLUX.1 Redux Identitäts-/Stilführung kombiniert. Stellen Sie eine saubere Gesichtsreferenz und ein Ziel-/Hintergrundbild bereit, und der Workflow überträgt die Identität, während Pose, Kleidung, Beleuchtung, Komposition und Szene erhalten bleiben.

Entwickelt für Ersteller, die wiederholbare, fotorealistische Gesichtsersetzungen benötigen, bewältigt die FLUX Redux ACE Face Swap-Pipeline Erkennung, intelligentes Maskieren, Inpaint-Konditionierung, Redux-basierte visuelle Führung und einen abschließenden Detaildurchgang. Sie können die Ergebnisse mit einer kurzen Eingabeaufforderung steuern oder sie leer lassen für eine reine Identitätsübertragung.

Schlüsselmodelle im Comfyui FLUX Redux ACE Face Swap-Workflow#

- Black Forest Labs FLUX.1‑Redux‑dev. Adapter, der Stil- und Identitätshinweise aus einem Bild extrahiert, um Bearbeitungen zu leiten; hier verwendet, um das Referenzgesicht über Generationen hinweg konsistent zu halten. Model card

- Black Forest Labs FLUX.1‑Fill‑dev. Rectified-Flow-Transformer, spezialisiert auf Inpainting; füllt den maskierten Gesichtsbereich aus, während er Ihrer Eingabeaufforderung und Redux-Anleitung folgt. Model card

- Black Forest Labs FLUX.1‑dev Text-Encoder und Autoencoder. Die CLIP‑L und T5‑XXL Text-Encoder und das AE, die für latente Kodierung/Dekodierung in der FLUX-Familie verwendet werden. Model card

- InsightFace Gesichtsanalysenmodelle. Robuste Gesichtserkennung und -ausrichtung zur Lokalisierung des Referenzgesichts für die Führung. GitHub

- CLIP Vision (SigLIP, ViT patch14 @ 384). Visions-Encoder, der vom Redux-Guidance-Schritt verwendet wird, um Bildmerkmale zu vergleichen und Identitäts-/Stilhints zu stabilisieren. Model card

So verwenden Sie den Comfyui FLUX Redux ACE Face Swap-Workflow#

Der Workflow läuft in zwei koordinierten Tracks: ein Referenzgesicht-Track, um Identitätshinweise zu extrahieren, und ein Zielbild-Track, um einen editierbaren Gesichtsbereich vorzubereiten. Sie konvergieren in FLUX-Inpainting mit Redux-Anleitung, dann ein pro-Region-Detaildurchgang und endgültige Wiederherstellung.

Referenzgesicht-Setup

- Legen Sie Ihre Gesichtsreferenz in

LoadImage(#19) ab. Die Pipeline beschränkt die Größe für Stabilität, dann findenFaceAnalysisModels(#39) undFaceBoundingBox(#38) das Gesicht.LayerMask: PersonMaskUltra V2(#72) erstellt eine saubere Gesichtsmaske undGrowMaskWithBlur(#44) glättet die Kanten für eine natürliche Mischung. - Dieses Referenzbild und die Maske speisen

ReduxAdvanced(#40) zusammen mit CLIP-Vision. Redux extrahiert visuelle Merkmale, die Identität, Haarlinie und lokalen Stil definieren und eine Konditionierung erzeugen, die den Austausch leiten wird.

Zielbild-Setup

- Legen Sie das Ziel-/Hintergrundbild in

LoadImage(#86) ab. Der Workflow segmentiert das Subjekt mitLayerMask: PersonMaskUltra V2(#69), erweitert und reinigt die Maske überGrowMaskWithBlur(#70), dann isoliertCropByMask V2(#64) einen präzisen Bearbeitungsbereich. - Der Zielausschnitt wird (

ImageResize+(#32)) und das Referenzgesicht wird entsprechend angepasst (ImageResize+(#10)). Zwei Hilfsknoten (ImageConcanate(#21) und (#11)) montieren eine gepaarte Leinwand und ein entsprechendes Maskenbild, das den editierbaren Bereich für Inpainting definiert.

Identitätsbewusste Inpaint-Führung

CLIPTextEncode(#26) akzeptiert eine optionale Eingabeaufforderung, um Stil oder Szene zu beeinflussen (zum Beispiel: „Beleuchtung und Hintergrund erhalten, natürliche Mischung“).FluxGuidance(#27) undConditioningZeroOut(#35) formen positive/negative Konditionierung für Inpainting.InpaintModelConditioning(#16) verwandelt den Zielausschnitt, die Maske und VAE in ein Latent mit ausgerichteter Konditionierung. Diese Konditionierung, kombiniert mit Redux-Konditionierung vonReduxAdvanced(#40), bildet die „ACE“ Führung, die die Referenzidentität beibehält und gleichzeitig die Zielkomposition respektiert.

Generieren und verfeinern

KSampler(#28) führt FLUX.1‑Fill‑dev durch den maskierten Bereich, um das Gesicht zu ersetzen, während es den Redux-Hinweisen folgt. Das dekodierte Ergebnis wird zurück in den Arbeitsbereich zugeschnitten (ImageCrop(#17)) für eine qualitativ hochwertige Verfeinerung.DetailerForEach(#50) verwendet SEGS von der Zielmaske (MaskToSEGS(#52)), um einen regionsweisen Verbesserungsgang mit dem FLUX-Modell anzuwenden, der Haut, Augen und Haarränder für einen überzeugend integrierten Austausch verbessert.

Wiederherstellen und speichern

RestoreCropBox(#66) setzt den verfeinerten Gesichtsbereich wieder in den ursprünglichen Zielrahmen mit der ursprünglichen Zuschneidebox ein, um eine nahtlose Mischung sicherzustellen.PreviewImage(#80) undImage Comparer (rgthree)(#77) helfen Ihnen, A/B-Unterschiede zu überprüfen, undSaveImage(#81) schreibt die endgültige Ausgabe.

Schlüssel-Knoten im Comfyui FLUX Redux ACE Face Swap-Workflow#

ReduxAdvanced (#40)

- Zentral für Identitätskonsistenz, verbraucht dieser Knoten das Referenzbild, seine Maske und CLIP-Vision-Merkmale mit dem FLUX.1‑Redux‑dev Stilmodell. Erhöhen Sie seinen Einfluss, wenn der Austausch von der Referenz abweicht; verringern Sie ihn, wenn die Beleuchtung oder das Make-up des Ziels mehr Freiheit benötigt. Verwenden Sie den maskierten Modus für reine Gesichtsanleitung oder erweitern Sie die Maske, um die Haarlinie einzuschließen, wenn nötig. Repo, Redux model

InpaintModelConditioning (#16)

- Baut das Latent-, Masken- und Konditionierungspaket für FLUX.1‑Fill‑dev. Für saubere Kanten halten Sie eine weiche Maske mit ein paar Pixeln Unschärfe; spannen Sie sie an, wenn der Austausch das Haar oder Accessoires nicht berühren darf. Wenn die Eingabeaufforderung optional ist, verlassen Sie sich auf Redux-Anleitung; fügen Sie eine kurze Eingabeaufforderung nur hinzu, wenn Sie Stil- oder Szenenrichtung benötigen.

KSampler (#28)

- Treibt den tatsächlichen Gesichtsaustausch mit FLUX.1‑Fill‑dev unter Verwendung des Latents von

InpaintModelConditioningund der Redux-erweiterten positiven Konditionierung. Verwenden Sie moderates Rauschen, um Pose und Beleuchtung zu respektieren; erhöhen Sie es nur, wenn das Zielgesicht eine stärkere Neuzeichnung benötigt. Samenverriegelung hilft, ein gewähltes Identitätsmatch über Aufnahmen hinweg zu reproduzieren. Fill model

DetailerForEach (#50)

- Führt einen regionsweisen Verbesserungsgang auf dem generierten Ausschnitt durch. Es verwendet SEGS, die von der Zielmaske abgeleitet sind, um sich auf wichtige Gesichtsbereiche zu konzentrieren. Erhöhen Sie die Detailstärke für Hauttextur und Augenklarheit; verringern Sie sie für eine weichere, beauty-grade Mischung. Impact Pack

FaceBoundingBox (#38)

- Erkennt und isoliert das Referenzgesicht. Wenn der Workflow die falsche Region in Aufnahmen mit mehreren Personen erfasst, erhöhen Sie die Vertrauen-Schwelle oder schneiden Sie Ihre Referenz vorab für Klarheit zu. ComfyUI_FaceAnalysis, InsightFace

LayerMask: PersonMaskUltra V2 (#69)

- Erzeugt Personen-/Gesichtsmasken für beide Referenz- und Zieltracks. Vergrößern Sie die Maske leicht für sichereres Mischen; verkleinern Sie sie, um Haarlinienüberlauf oder Ohrringe zu vermeiden. Saubere Masken hier übersetzen direkt in weniger Artefakte später. Repo

LayerUtility: RestoreCropBox (#66)

- Setzt das verfeinerte Gesicht wieder in den ursprünglichen Rahmen mit der gespeicherten Zuschneidebox ein. Passen Sie das Federn in diesem Stadium nur an, wenn Sie einen sichtbaren Rand zwischen dem bearbeiteten Bereich und dem Hintergrund sehen.

Optionale Extras#

- Verwenden Sie eine scharfe, frontale Referenz mit neutralem Ausdruck und ähnlicher Beleuchtung wie das Ziel für die beste Identitätsübertragung.

- Halten Sie die Eingabeaufforderungen kurz und beschreibend; lassen Sie FLUX Redux ACE Face Swap die Identität tragen, während FLUX.1 Fill die Komposition respektiert.

- Wenn Sie ein spezifisches Porträt-Aussehen bevorzugen, tauschen Sie Ihr eigenes LoRA vor dem Sampling ein; subtile Stärken mischen sich normalerweise am besten.

- Für schnellere Iterationen während des Prototypings, aktivieren Sie einen Caching- oder Beschleunigungsknoten, der mit Ihrer Einrichtung kompatibel ist, und wechseln Sie dann zu Vollqualitätseinstellungen für die Endversionen.

- Haben Sie immer die Rechte und Zustimmung für die Gesichter, die Sie verarbeiten, und folgen Sie den FLUX.1 [dev] Lizenzbedingungen auf den oben verlinkten Modellkarten.

Danksagungen#

Dieser Workflow implementiert und baut auf den folgenden Arbeiten und Ressourcen auf. Wir danken RunningHub für die RunningHub-Workflow-Quelle, Black Forest Labs für das FLUX.1-Redux-dev Modell und Black Forest Labs für das FLUX.1-Fill-dev Modell für ihre Beiträge und Wartung. Für autoritative Details verweisen Sie bitte auf die Originaldokumentation und die unten verlinkten Repositories.

Ressourcen#

- RunningHub/RunningHub workflow source

- Docs / Release Notes: runninghub.ai post

- black-forest-labs/FLUX.1-Redux-dev

- Hugging Face: black-forest-labs/FLUX.1-Redux-dev

- black-forest-labs/FLUX.1-Fill-dev

- Hugging Face: black-forest-labs/FLUX.1-Fill-dev

Hinweis: Die Nutzung der referenzierten Modelle, Datensätze und Codes unterliegt den jeweiligen Lizenzen und Bedingungen der jeweiligen Autoren und Betreuer.