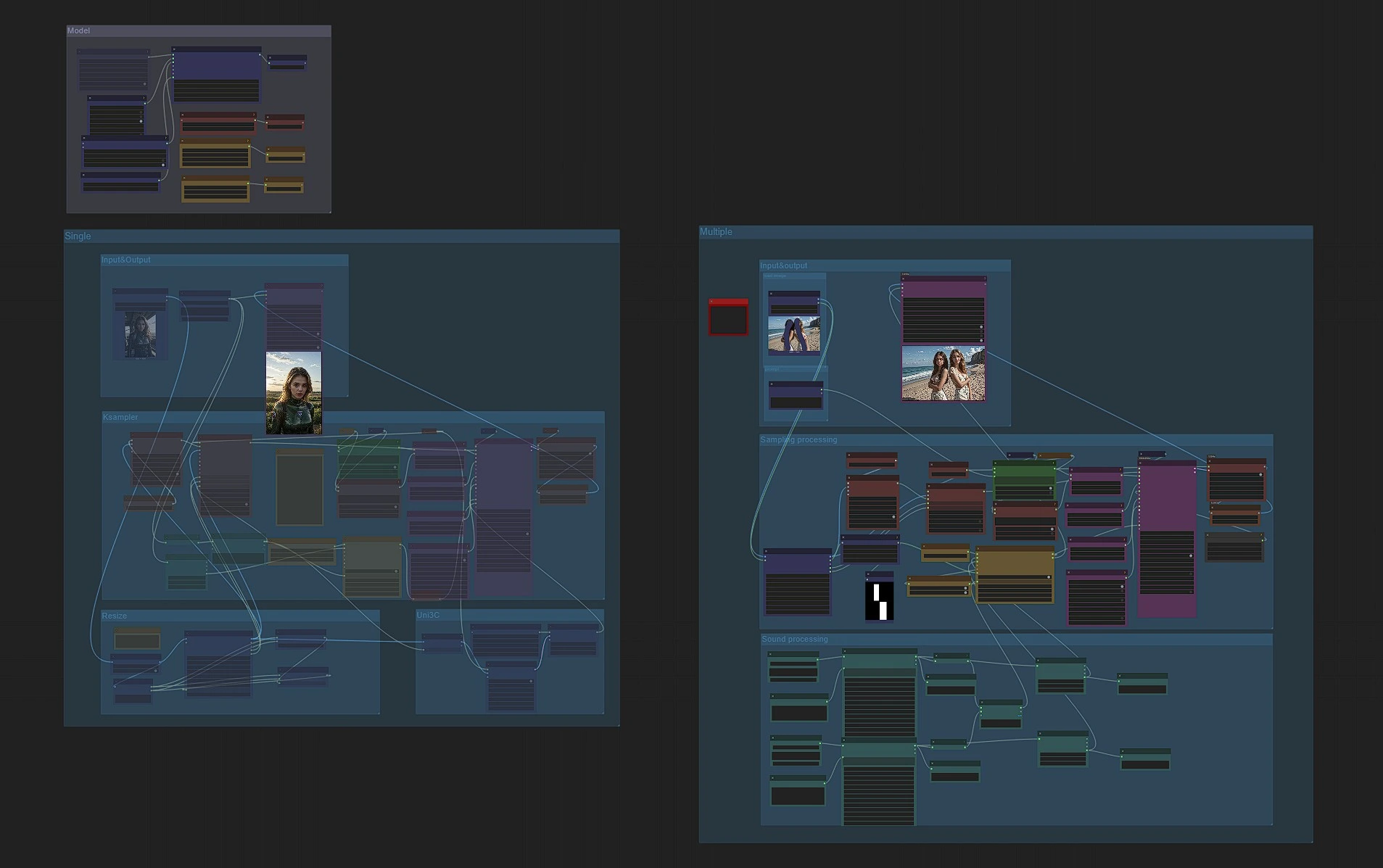

ComfyUI MultiTalk: Mehrpersonen- und Einzelpersonen-Sprechvideo#

Hinweis: Dies ist die aufgerüstete Mehrpersonen-Version unseres ComfyUI MultiTalk Einzelpersonen Workflows. Es unterstützt jetzt Mehrpersonen-Gesprächsvideoerzeugung und beinhaltet weiterhin den Einzelpersonenmodus aus unserer vorherigen Version.

Der Workflow ist ideal für soziale Inhalte, Produkterklärungen, Charakterdialoge und schnelle Previz. Er kombiniert MultiTalk Audio-Einbettungen mit Videodiffusion, sodass Lippen, Kiefer und subtile Gesichtsausdrücke der Sprache folgen. Nutzen Sie ihn als Drop-in-Pfad für sowohl Meigen MultiTalk Mehrsprecher-Szenen als auch schlanke Einzelsprecher-Clips.

Schlüsselmodelle im ComfyUI MultiTalk Workflow#

Wan 2.1 Video-Diffusionsmodell

Steuert die Kern-Text- und Bild-konditionierte Videogenerierung. Es behandelt das Erscheinungsbild der Szene, Kamera und Bewegung und akzeptiert zusätzliche Anleitungen für Gesprächsdynamik.

Wav2Vec 2.0

Extrahiert robuste Sprachrepräsentationen, die MultiTalk in sprech-spezifische Einbettungen umwandelt. Referenz: facebook/wav2vec2-base-960h.

MultiTalk (MeiGen-AI)

Forschungsmethode für audiogesteuertes Mehrpersonen-Gesprächsvideo. Referenzimplementierung: MeiGen-AI/MultiTalk.

ComfyUI Wan Video Wrapper

ComfyUI-Integration, die Wan 2.1-Ladung, Encoder und den Videosampler sowie den MultiTalk Einbettungsknoten bereitstellt. Referenz: kijai/ComfyUI-WanVideoWrapper.

Index-TTS (optional)

Text-zu-Sprache mit Stimmreferenz für die Erzeugung von sauberen Dialogspuren innerhalb des Workflows. Referenz: chenpipi0807/ComfyUI-Index-TTS.

Verwendung des ComfyUI MultiTalk Workflows#

Dieser Workflow läuft von Anfang bis Ende: Sie bereiten Sprecher und Audio vor, setzen eine kurze Szenenaufforderung und rendern dann. Er unterstützt sowohl Mehrpersonen- als auch Einzelpersonen-Setups. Gruppen im Graphen halten alles organisiert; die wichtigsten werden unten beschrieben.

Eingang & Ausgang#

Laden Sie Identitätsbilder für Ihre Sprecher-Gesichter und Vorschau-Masken, dann muxen Sie die endgültigen Frames mit Audio. Die LoadImage-Knoten akzeptieren Ihre Porträts, während VHS_VideoCombine die gerenderten Frames mit dem ausgewählten Audiotrack zu einem MP4 zusammenstellt. Sie können Audio mit PreviewAudio während der Einrichtung abspielen, um Pegel und Dauer zu bestätigen.

Modell#

Get_WanModel, Get_WanTextEncoder und WanVideoModelLoader initialisieren Wan 2.1 zusammen mit den Text- und VAE-Komponenten. Betrachten Sie dies als Maschinenraum: Sobald geladen, kann der Videosampler Bild-, Text- und Gesprächseinbettungen akzeptieren. Sie müssen hier selten etwas ändern, außer sicherzustellen, dass die richtigen Wan-Gewichte ausgewählt sind.

Sprecher-Audio (zwei Wege)#

Sie können Ihre eigenen Dialogspuren mitbringen oder sie synthetisieren:

- Audio mitbringen: Verwenden Sie

LoadAudioum die Zeilen jedes Sprechers zu importieren. Wenn ein Clip mit Musik oder Geräuschen gemischt ist, leiten Sie ihn durchAudioSeparationund leiten Sie die saubereVocals-Ausgabe weiter. - Audio generieren: Verwenden Sie

Speaker 1 - TextundSpeaker 2 - TextmitIndexTTSNode, um Stimmen aus getippten Zeilen zu synthetisieren und optionalreference_audiofür den gewünschten Klangcharakter anzugeben.

MultiTalk Audio-Einbettungen#

MultiTalkWav2VecEmbeds wandelt Sprache in MultiTalk Einbettungen um, die Timing- und Artikulationshinweise für jeden Sprecher erfassen. Füttern Sie es mit einem Audiostream für Einzelpersonen oder zwei Streams für Mehrpersonen-Dialoge. Wenn Ihre Szene gesichtsspezifische Zielvorgaben benötigt, stellen Sie saubere Gesichtsmasken als ref_target_masks bereit, damit jede Stimme die richtige Person steuert.

Aufforderung und Textkontext#

Eine kurze Szenenaufforderung über Prompt und WanVideoTextEncodeSingle setzt die visuelle Stimmung und Umgebung. Halten Sie Aufforderungen kurz und beschreibend (Ort, Ton, Beleuchtung). Der Text-Encoder generiert semantische Anleitungen, die Wan zusammen mit Identitäts- und Gesprächssignalen verwendet.

Uni3C und Resize#

Die Uni3C-Gruppe bereitet globale Kontexteinbettungen vor, die helfen, Identität, Rahmung und Komposition im Laufe der Zeit zu stabilisieren. Die Resize-Gruppe stellt sicher, dass Quellbilder und Masken auf modellfreundliche Dimensionen skaliert werden, damit der Sampler konsistente Eingaben erhält.

KSampler und Abtastverarbeitung#

WanVideoSampler ist der Punkt, an dem alles zusammenkommt: Identitätsbildeinbettungen, Texteingebettungen und MultiTalk Audio-Einbettungen kombinieren sich, um die endgültigen Frames zu erzeugen. Die nachgelagerte Sampling processing-Gruppe wendet alle Nachbearbeitungsschritte an, die für Glätte und Konsistenz erforderlich sind, bevor sie an den Videokombinierer übergeben wird.

Masken für Mehrpersonen#

Für Mehrpersonen-Clips zeichnen Sie eine Maske pro Gesicht im ComfyUI-Maskeneditor. Halten Sie Masken getrennt, damit sie sich nie berühren. Wenn Sie nur eine Maske und einen Audiotrack bereitstellen, verhält sich der Workflow automatisch als Einzelpersonen MultiTalk-Setup.

Schlüssel-Knoten im ComfyUI MultiTalk Workflow#

MultiTalkWav2VecEmbeds (#79/#162)#

Wandelt einen oder mehrere Dialogspuren in MultiTalk Gesprächseinbettungen um. Beginnen Sie mit einem Audioeingang für Einzelpersonen oder zwei für Mehrpersonen; fügen Sie Masken hinzu, wenn Sie eine spezifische Gesichtsführung benötigen. Passen Sie nur an, was wichtig ist: Anzahl der Frames, um die geplante Clip-Länge zu erreichen, und ob ref_target_masks für eine präzise Sprecher-zu-Gesicht-Ausrichtung bereitgestellt werden sollen.

AudioSeparation (#88/#160/#161)#

Optionales Aufräumen für laute Eingaben. Leiten Sie Ihren lauten Clip in diesen Knoten und leiten Sie die Vocals-Ausgabe weiter. Verwenden Sie es, wenn Feldaufnahmen Hintergrundmusik oder Gespräche enthalten; überspringen Sie es, wenn Sie bereits saubere Sprachspuren haben.

IndexTTSNode (#163/#164)#

Wandelt Speaker 1 - Text und Speaker 2 - Text in Dialogaudio um. Geben Sie ein kurzes reference_audio an, um Ton und Tempo zu klonen, und dann Textzeilen. Halten Sie Sätze kurz und natürlich für bestes Lippen-Timing in MultiTalk.

WanVideoTextEncodeSingle (#18)#

Codiert Ihre Szenenaufforderung für Wan 2.1. Bevorzugen Sie einfache, konkrete Beschreibungen von Ort, Beleuchtung und Stil. Vermeiden Sie lange Listen; ein oder zwei Sätze reichen für den Sampler.

Danksagungen#

Originalforschung: MultiTalk wird von MeiGen-AI mit Zusammenarbeit führender Forscher auf dem Gebiet entwickelt. Das Originalpapier "Let Them Talk: Audio-Driven Multi-Person Conversational Video Generation" präsentiert die bahnbrechende Forschung hinter dieser Technologie. ComfyUI-Integration: Die ComfyUI-Implementierung wird von Kijai durch das ComfyUI-WanVideoWrapper-Repository bereitgestellt, wodurch diese fortschrittliche Technologie der breiteren kreativen Gemeinschaft zugänglich gemacht wird.

Basistechnologie: Basierend auf dem Wan2.1 Video-Diffusionsmodell und integriert Audiobearbeitungstechniken aus Wav2Vec, was eine Synthese von Spitzentechnologie in der KI-Forschung darstellt.

Links und Ressourcen#

- Originalforschung: MeiGen-AI MultiTalk Repository

- Projektseite: https://meigen-ai.github.io/multi-talk/

- ComfyUI-Integration: ComfyUI-WanVideoWrapper