FLUX是由Black Forest Labs开发的新图像生成模型。FLUX-ControlNet-Depth和FLUX-ControlNet-Canny模型由XLabs AI团队创建。此ComfyUI FLUX ControlNet工作流程也是由XLabs AI团队创建。更多详情,请访问**x-flux-comfyui**。所有功劳归于他们的贡献。

关于FLUX#

FLUX模型已预加载在RunComfy上,命名为flux/flux-schnell和flux/flux-dev。

- 启动RunComfy中型机器时:选择检查点

flux-schnell, fp8和clipt5_xxl_fp8以避免内存不足问题。 - 启动RunComfy大型或以上机器时:选择大型检查点

flux-dev, default和高clipt5_xxl_fp16。

更多详情,请访问:ComfyUI FLUX | 新的艺术图像生成

🌟以下FLUX-ControlNet工作流程专为[FLUX.1 [dev]](https://github.com/black-forest-labs/flux)模型设计。🌟

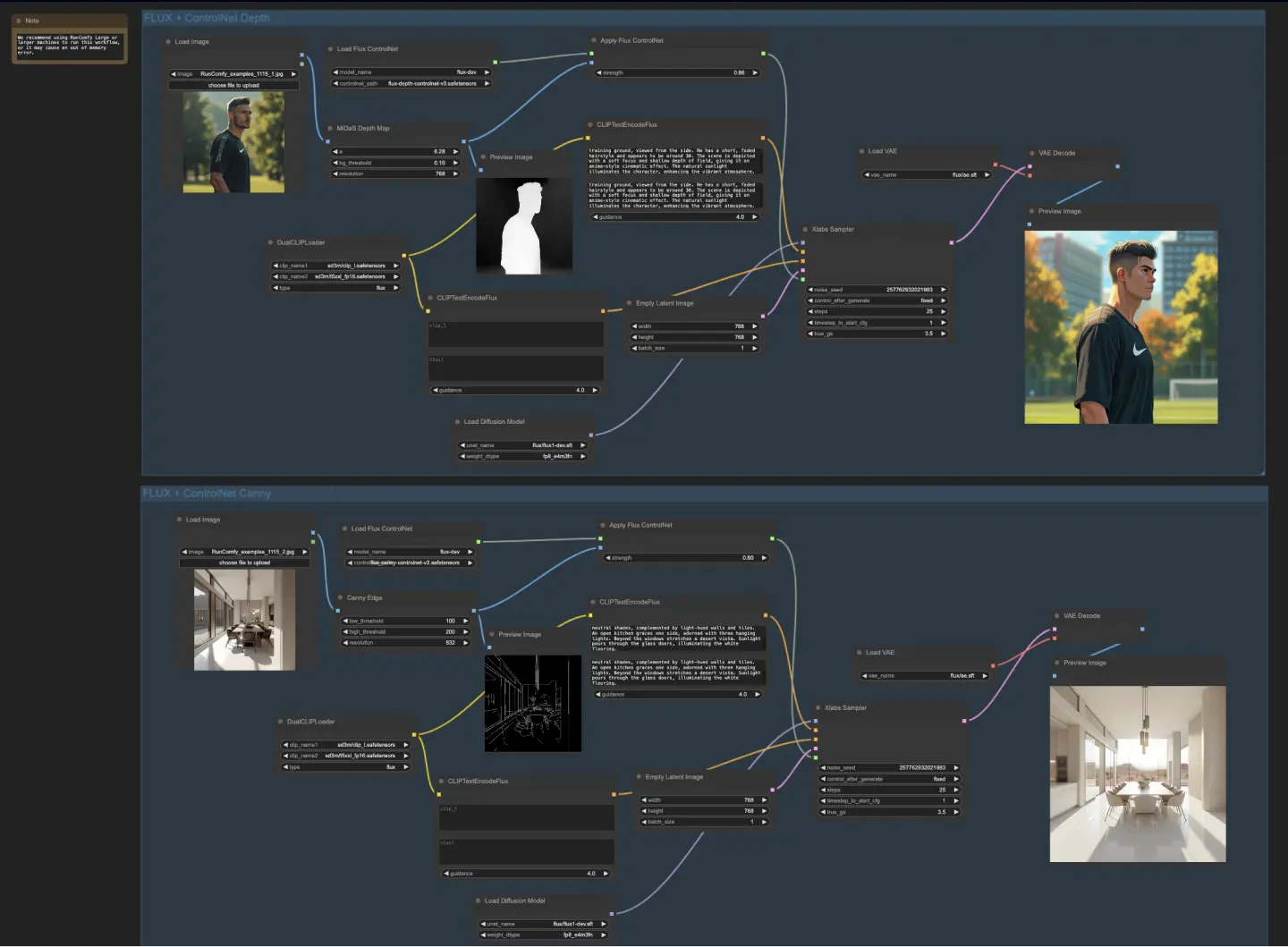

关于FLUX-ControlNet工作流程(FLUX-ControlNet-Depth-V3和FLUX-ControlNet-Canny-V3)#

我们提供了两个出色的FLUX-ControlNet工作流程:FLUX-ControlNet-Depth和FLUX-ControlNet-Canny,每个都提供独特的能力来增强您的创作过程。

1. 如何使用ComfyUI FLUX-ControlNet-Depth-V3工作流程#

首先使用"LoadFluxControlNet"节点加载FLUX-ControlNet Depth模型。选择"flux-depth-controlnet.safetensors"模型以获得最佳深度控制。

- flux-depth-controlnet

- flux-depth-controlnet-v2

- flux-depth-controlnet-v3:ControlNet在1024x1024分辨率上训练,并适用于1024x1024分辨率,具有更好和更逼真的版本

将此节点的输出连接到"ApplyFluxControlNet"节点。还将您的深度图像连接到此节点的图像输入。深度图应为灰度图像,其中较近的物体较亮,较远的物体较暗,使FLUX-ControlNet能够准确解释深度信息。

您可以使用深度估计模型从输入图像生成深度图。在这里,使用"MiDaS-DepthMapPreprocessor"节点将加载的图像转换为适合FLUX-ControlNet的深度图。关键参数:

- 阈值 = 6.28(影响边缘敏感度)

- 深度比例 = 0.1(深度图值的缩放量)

- 输出大小 = 768(深度图分辨率)

在"ApplyFluxControlNet"节点中,强度参数决定生成图像受FLUX-ControlNet深度条件的影响程度。较高的强度将使输出更接近深度结构。

2. 如何使用ComfyUI FLUX-ControlNet-Canny-V3工作流程#

过程与FLUX-ControlNet-Depth工作流程非常相似。首先使用"LoadFluxControlNet"加载FLUX-ControlNet Canny模型。然后将其连接到"ApplyFluxControlNet"节点。

- flux-canny-controlnet

- flux-canny-controlnet-v2

- flux-canny-controlnet-v3:ControlNet在1024x1024分辨率上训练,并适用于1024x1024分辨率,具有更好和更逼真的版本

使用"CannyEdgePreprocessor"节点将输入图像转换为Canny边缘图,使其优化用于FLUX-ControlNet。关键参数:

- 低阈值 = 100(边缘强度阈值)

- 高阈值 = 200(边缘的滞后阈值)

- 大小 = 832(边缘图分辨率)

将生成的Canny边缘图连接到"ApplyFluxControlNet"节点。同样,使用强度参数控制边缘图对FLUX-ControlNet生成的影响程度。

3. 适用于ComfyUI FLUX-ControlNet-Depth-V3和ComfyUI FLUX-ControlNet-Canny-V3#

在两个FLUX-ControlNet工作流程中,CLIP编码的文本提示用于驱动图像内容,而FLUX-ControlNet条件控制图像的结构和几何形状,基于深度图或边缘图。

通过结合不同的FLUX-ControlNets、输入模式(如深度和边缘)并调整其强度,您可以对FLUX-ControlNet生成的图像的语义内容和结构进行细粒度控制。

许可:controlnet.safetensors受[FLUX.1 [dev]](https://huggingface.co/black-forest-labs/FLUX.1-dev/blob/main/LICENSE.md)非商业许可证约束

许可#

查看许可证文件:

flux/model_licenses/LICENSE-FLUX1-dev

flux/model_licenses/LICENSE-FLUX1-schnell

FLUX.1 [dev]模型由Black Forest Labs. Inc.根据FLUX.1 [dev]非商业许可证授权。版权所有Black Forest Labs. Inc.

在任何情况下,Black Forest Labs, Inc.均不对因使用此模型而引起的任何索赔、损害或其他责任负责,无论是在合同诉讼、侵权行为或其他方面。