1. FLUX 是什麼#

FLUX 是由 Black Forest Labs 開發的新圖像生成模型,他們是 Stable Diffusion 的創始者之一。FLUX 標誌著 AI 生成藝術領域的一個重大進步。這個先進的模型有三種不同的變體:

- FLUX.1 [pro]:FLUX.1 系列的頂峰,提供圖像生成的頂級性能。

- FLUX.1 [dev]:一個開放權重、指導蒸餾模型,設計用於非商業用途。它提供與 FLUX.1 [pro] 類似的質量和提示遵從性,但效率更高。

- FLUX.1 [schnell]:最快的模型變體,優化用於本地開發和個人使用,並在 Apache 2.0 許可下提供。

FLUX.1 模型在提示遵從性、視覺質量、圖像細節和輸出多樣性方面表現出色。它們能夠以卓越的精確度處理文本,忠實地遵循複雜的場景組成指示,並比以前的模型更準確地生成手部圖像。

2. FLUX.1 的特別之處#

FLUX.1 重新定義了 AI 生成藝術的可能性。以下是其突出特點:

- 文本準確性:FLUX 能夠輕鬆處理難以辨認的單詞和重複字母,這使得它在文本精確性至關重要的設計中成為理想選擇。

- 複雜組成:FLUX 擅長解讀和執行物體放置和場景組成的詳細指示,從精緻提示中生成準確的場景。

- 真實手部:歷史上,生成真實的手部一直是 AI 藝術模型的挑戰。FLUX 在這方面取得了重大進展,生成手部的手指數量和位置更準確。雖然不是完美無瑕,但相較於之前的模型有顯著改善。

- 效率:FLUX 的 dev 和 schnell 變體提供與 pro 版本相似的質量,同時在大小和速度上更有效率,便於更快的迭代和實驗。

- 多樣性:FLUX 能夠生成廣泛的藝術風格,從照片寫實到畫意再到插畫,開啟了藝術表達的新途徑。

3. 如何使用 ComfyUI FLUX#

ComfyUI FLUX 由 comfyanonymous 發佈。感謝他們對社區的貢獻。

FLUX 模型可以無縫整合到 ComfyUI 框架中,用於直觀的 AI 藝術創作。FLUX.1 [dev] 和 FLUX.1 [schnell] 的所有必要模型文件都已預載在 RunComfy 平台上。只需遵循以下關鍵步驟來運行工作流程:

步驟 1. 配置 UNETLoader 節點:選擇 flux1-dev.sft 或 flux1-schnell。

步驟 2. 配置 DualCLIPLoader 節點:為了降低記憶體使用,使用 sd3m/t5xxl_fp8_e4m3fn.safetensors;為了提高記憶體,使用 sd3m/t5xxl_fp16.safetensors。

🌟重要🌟:根據機器大小選擇適當的模型和 clip。

在啟動 RunComfy 中型機器時,請參考以下圖像設置:checkpoint (flux_schnell,fp8) 和 clip (t5_xxl_fp8),否則可能會導致記憶體不足錯誤。

![FLUX.1 [schnell]](https://cdn.runcomfy.net/workflow_assets/1111/readme02.webp)

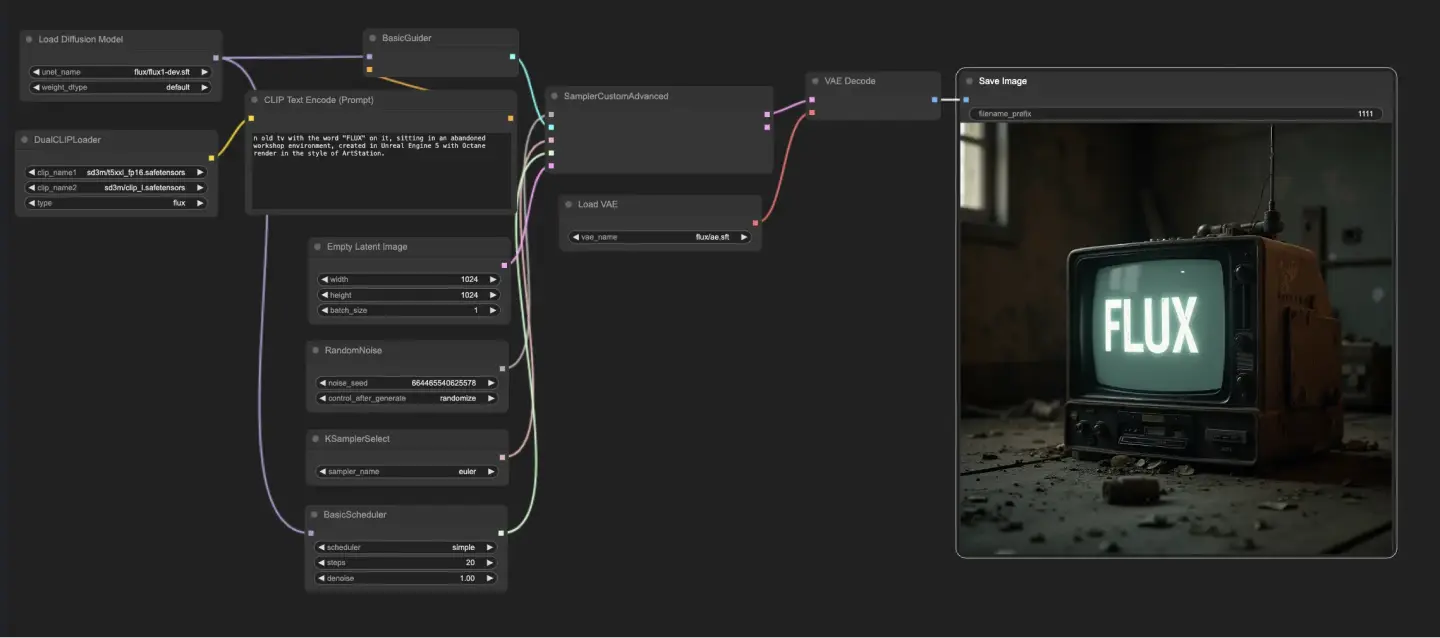

在啟動 RunComfy 大型或以上機器時,您可以選擇大機器和 clip,參考此圖像設置:checkpoint (flux_dev,default) 和 clip (t5_xxl_fp16)

![FLUX.1 [dev]](https://cdn.runcomfy.net/workflow_assets/1111/readme01.webp)

步驟 3. 配置 VAELoader 節點:FLUX 所需的模型已預載。

步驟 4. 設置 CLIPTextEncode 節點:在節點屬性中輸入您想要的文本提示以引導圖像生成過程。

步驟 5. 調整 EmptyLatentImage 節點(可選):此節點創建一個空的潛在圖像,作為生成過程的起點。

步驟 6. 配置 SamplerCustomAdvanced 節點:此節點處理噪聲、指導器、採樣器、sigmas 和 latent_image 輸入以生成去噪的輸出。

步驟 7. 調整 KSamplerSelect 節點(可選):通過調整此節點的屬性選擇特定的採樣器算法(例如 "euler")。

步驟 8. 生成圖像:繼續生成您想要的圖像。

許可#

查看許可文件:

flux/model_licenses/LICENSE-FLUX1-dev

flux/model_licenses/LICENSE-FLUX1-schnell

FLUX.1 [dev] 模型由 Black Forest Labs. Inc. 根據 FLUX.1 [dev] 非商業許可授權。版權所有 Black Forest Labs. Inc.

在任何情況下,BLACK FOREST LABS, INC. 均不對因使用此模型而產生的任何索賠、損害或其他責任承擔責任,無論是基於合同、侵權或其他原因。