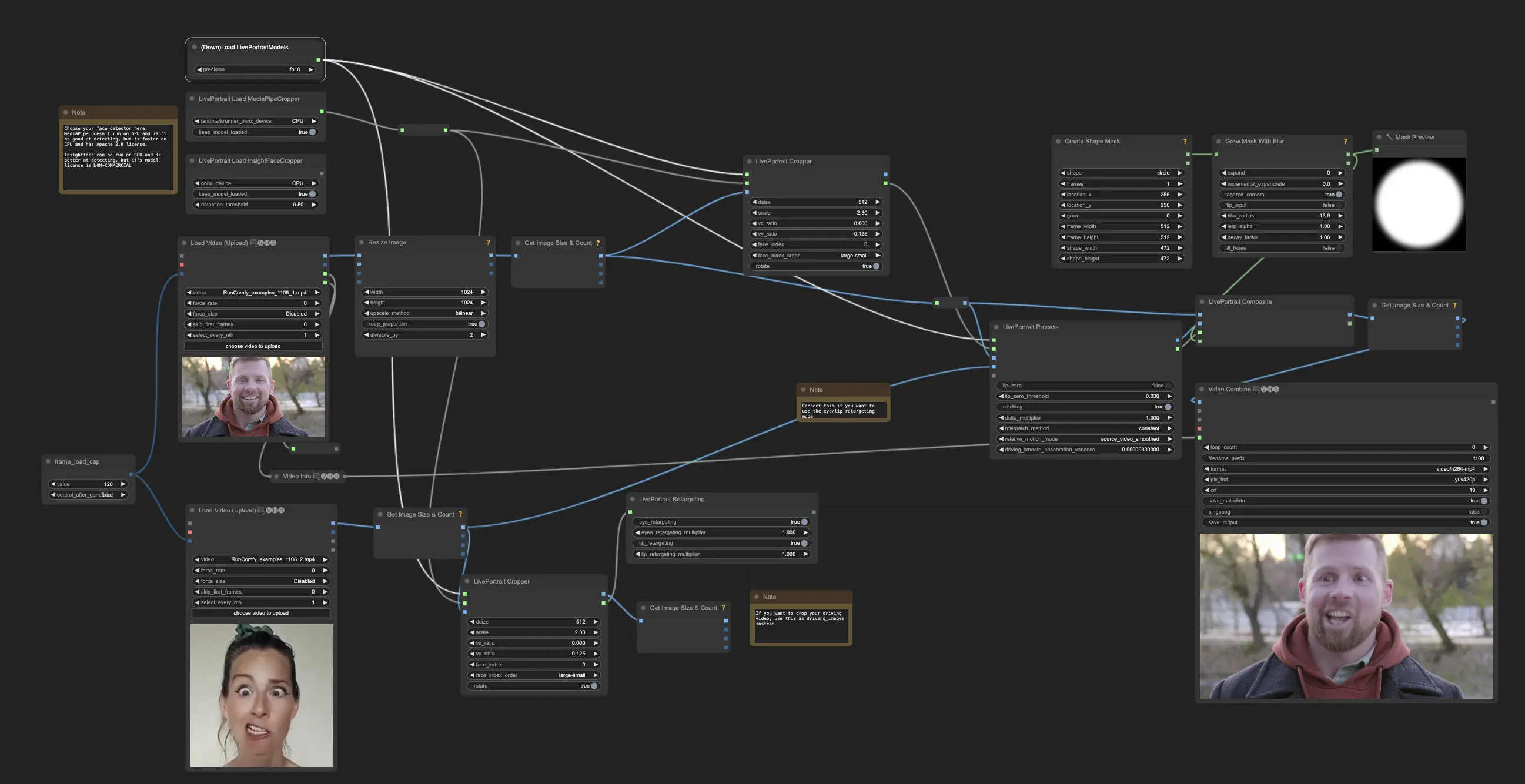

Grazie al nodo e al workflow di kijai's ComfyUI-LivePortraitKJ, creare animazioni LivePortrait realistiche in ComfyUI è ora più facile. Di seguito è riportata un'analisi dei componenti chiave e dei parametri del suo workflow.

Si prega di leggere prima la descrizione di LivePortrait Img2Vid per comprendere i passaggi del workflow. Dopo esserti familiarizzato con il processo LivePortrait Img2Vid, noterai alcune piccole differenze tra i workflow LivePortrait Vid2Vid e Img2Vid.

La Differenza Tra ComfyUI LivePortrait Vid2Vid e Img2Vid#

1. Carica video utilizzando "VHS_LoadVideo" invece di immagini#

- In questo workflow LivePortrait Img2Vid, carichi un'immagine statica come sorgente utilizzando il nodo "LoadImage". Tuttavia, nel workflow Vid2Vid, devi caricare un video come sorgente. Regola il "frame_load_cap" per controllare quanti frame vengono caricati.

- Ridimensiona il video sorgente a una risoluzione più alta come 1024x1024 per una qualità migliore. Dopo aver caricato il video sorgente con "VHS_LoadVideo", utilizza il nodo "ImageResizeKJ" per ingrandire i frame a una risoluzione come 1024x1024. Questo aiuterà a mantenere nitidezza e dettaglio nel risultato finale. Quando lavori con i video, è consigliato utilizzare una risoluzione più alta per la sorgente rispetto al workflow Img2Vid. Mentre 512x512 è spesso sufficiente per immagini statiche, i video beneficiano di risoluzioni più alte per preservare dettaglio e qualità.

- I frame del video di guida possono ancora essere ridimensionati a una risoluzione inferiore come 480x480 per risparmiare tempo di elaborazione, poiché forniscono solo informazioni di movimento.

2. Utilizza la modalità di movimento relativo "source_video_smoothed" per risultati Vid2Vid LivePortrait più fluidi#

- Il nodo "LivePortraitProcess" ha un parametro "relative_motion_mode" che controlla come il movimento viene trasferito dal video di guida alla sorgente. Per Vid2Vid, è consigliato utilizzare la modalità "source_video_smoothed".

- In questa modalità, il movimento LivePortrait viene smussato nel tempo basandosi sul video di input, il che aiuta a creare risultati più coerenti e stabili nel tempo. Questo è particolarmente importante per i video, dove salti improvvisi o tremolii nel movimento possono essere più evidenti rispetto a immagini singole.

- Altre modalità di movimento come "relative" o "single_frame" possono funzionare meglio per Img2Vid, ma "source_video_smoothed" è tipicamente la scelta migliore per Vid2Vid.

3. Collega FPS e audio del video sorgente a "VHS_VideoCombine" per mantenere la sincronizzazione audio per Vid2Vid LivePortrait#

- Quando crei il video di output finale con il nodo "VHS_VideoCombine", è importante mantenere la sincronizzazione audio con i frame video. Questo comporta due connessioni chiave:

- Innanzitutto, collega l'audio del video sorgente all'input "audio" di "VHS_VideoCombine" utilizzando un nodo "Reroute". Questo assicurerà che l'audio originale venga utilizzato nel video di output.

- In secondo luogo, collega il frame rate (FPS) del video sorgente all'input "frame_rate" di "VHS_VideoCombine". Puoi ottenere l'FPS utilizzando il nodo "VHS_VideoInfo", che estrae i metadati dal video sorgente. Questo assicurerà che il video di output corrisponda alla tempistica della sorgente.

- Gestendo attentamente l'audio e il frame rate, puoi creare un output Vid2Vid LivePortrait che mantenga una corretta sincronizzazione e tempistica, cruciale per un risultato realistico e guardabile.